A Responsabilidade Humana por Trás da Inteligência Artificial em Conflitos: Reflexões Após o Bombardeio na Escola do Irã

O Contexto do Bombardeio e a Reação à Inteligência Artificial

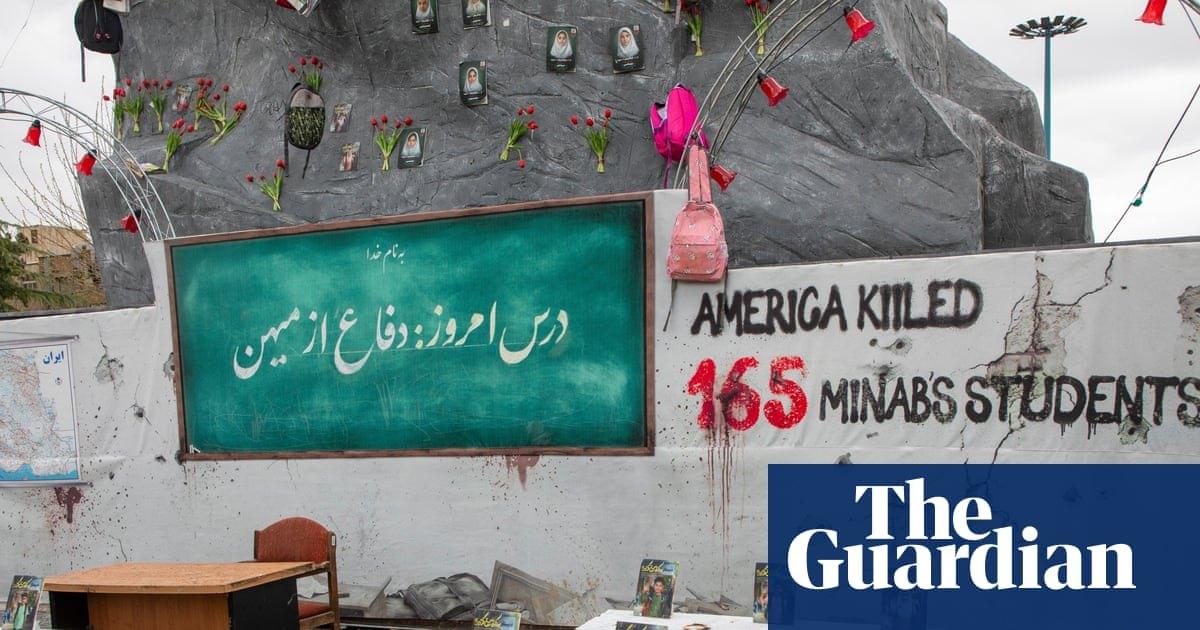

Recentemente, a tragédia do bombardeio da escola primária Shajareh Tayyebeh, em Teerã, chocou o mundo. Em meio ao luto, a responsabilidade pelo ataque foi atribuída, em parte, a uma suposta falha da inteligência artificial (IA) envolvida no sistema de armamento. Contudo, como destacam Anthony Lawton e a Dra. Felicity Mellor em carta ao The Guardian, a análise crítica deve ir além da tecnologia e focar na responsabilidade humana que está por trás das decisões e da concepção desses sistemas.

A Linguagem que Desresponsabiliza: De "Erro da IA" à Ausência do Sujeito Humano

O termo "erro da IA" tem sido utilizado para explicar falhas em sistemas automatizados, mas essa expressão pode ocultar a verdadeira origem do problema: os seres humanos. Ao deslocar a responsabilidade dos agentes humanos para os sistemas tecnológicos, a linguagem contemporânea cria uma zona cinzenta onde a responsabilidade moral se perde.

Historicamente, em contextos de guerra, termos como "danos colaterais" ou "desabrigados" já serviram para suavizar o impacto das ações humanas. Hoje, a automação e o uso de IA parecem ser o novo eufemismo, funcionando como uma espécie de álibi que dificulta a atribuição clara de culpa.

Humanos no Comando: Projetando, Autorizando e Executando Decisões

Mesmo diante de cadeias complexas de comando e análise, são os seres humanos que projetam, autorizam e executam as decisões que levam a consequências graves, como o bombardeio de uma escola. A tecnologia, por mais avançada que seja, não age de forma autônoma com agência moral. Reconhecer isso é fundamental para a manutenção da responsabilidade cívica e para o controle ético do uso da IA em contextos sensíveis como o militar.

O Perigo da Personificação da IA e a Necessidade de Responsabilização

Outro ponto destacado na carta é a tendência de atribuir características humanas à IA, como se ela pudesse "mentir", "enganar" ou "confessar". Essa antropomorfização pode desviar o foco da verdadeira origem dos problemas: as decisões humanas e as políticas das empresas que desenvolvem essas tecnologias.

Para exemplificar, a Dra. Mellor compara a situação a uma empresa que libera veículos de alta velocidade sem freios eficazes: não diríamos que os veículos "conspiraram" para causar acidentes, mas que os responsáveis pela empresa agiram com negligência.

Implicações para o Controle Público e a Ética na Tecnologia

Se a linguagem pública não nomear claramente os responsáveis humanos, torna-se impossível exercer a devida fiscalização e responsabilização. A automação pode acelerar os conflitos, mas também promove uma mudança mais sutil: a substituição do eufemismo pela automatização como justificativa para ações questionáveis.

Essa reflexão é crucial para o debate sobre o uso ético da IA, especialmente em cenários de guerra, onde as decisões têm impacto direto sobre vidas humanas inocentes.