ATLAS: Desvendando as Leis de Escala para Modelos Multilíngues em IA Generativa

A evolução dos modelos de inteligência artificial (IA) tem sido marcada por avanços significativos em capacidade, eficiência e aplicabilidade. Entre esses avanços, os modelos multilíngues ganham destaque por sua habilidade de compreender e gerar texto em diversos idiomas, ampliando o alcance global da IA. Um estudo recente do Google Research, intitulado ATLAS: Practical scaling laws for multilingual models, traz insights valiosos sobre as leis de escala práticas para esses modelos, oferecendo um guia para o desenvolvimento eficiente e eficaz de sistemas multilíngues na área de IA generativa.

Introdução aos Modelos Multilíngues e suas Desafios

Modelos multilíngues são sistemas de IA treinados para processar múltiplos idiomas simultaneamente. Eles são essenciais para aplicações globais, como assistentes virtuais, tradução automática e análise de sentimentos em diferentes culturas. Contudo, desenvolver esses modelos envolve desafios únicos, como equilibrar a capacidade do modelo para diferentes línguas, lidar com a escassez de dados em idiomas menos representados e otimizar recursos computacionais.

O que são Leis de Escala em Modelos de IA?

Leis de escala são relações matemáticas que descrevem como o desempenho de um modelo de IA melhora à medida que aumentamos seus recursos, como número de parâmetros, dados de treinamento e poder computacional. Entender essas leis permite prever o retorno sobre o investimento em expansão do modelo, ajudando pesquisadores e engenheiros a tomar decisões mais informadas.

Principais Descobertas do Estudo ATLAS

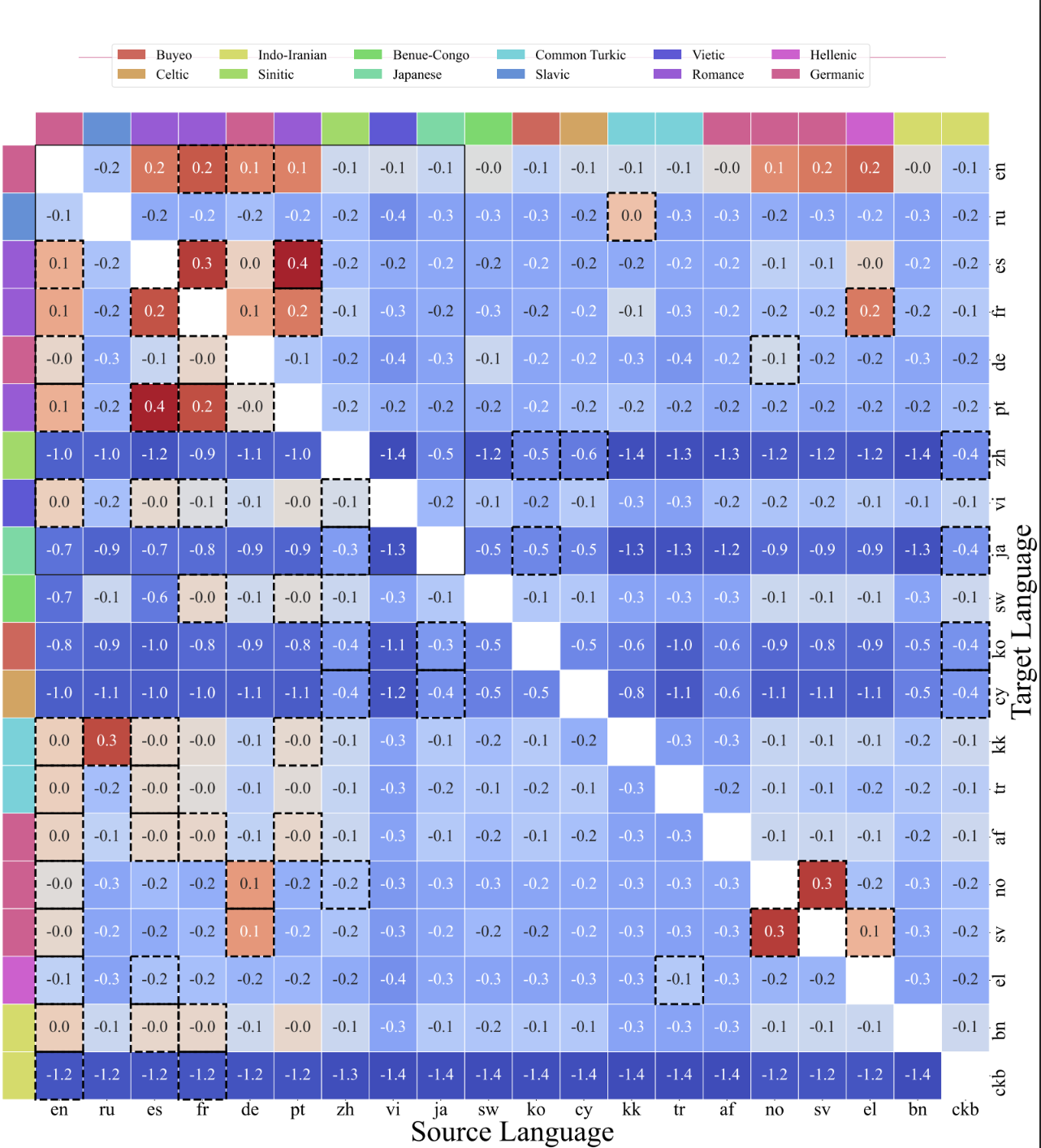

O estudo ATLAS propõe uma abordagem prática para entender as leis de escala em modelos multilíngues, destacando:

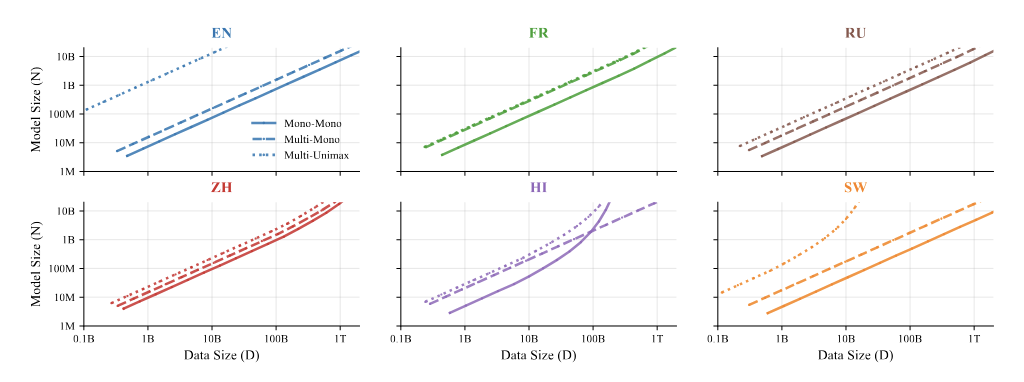

- Equilíbrio entre parâmetros e dados: Para maximizar o desempenho em múltiplos idiomas, é crucial ajustar o tamanho do modelo e a quantidade de dados de forma proporcional, especialmente considerando a diversidade linguística.

- Importância dos dados multilíngues: A qualidade e a representatividade dos dados de treinamento impactam diretamente a capacidade do modelo de generalizar para diferentes idiomas, incluindo aqueles com poucos recursos.

- Eficiência computacional: O estudo apresenta métricas para otimizar o uso de recursos, garantindo que o aumento do tamanho do modelo traga ganhos reais sem desperdício.

- Generalização e transferência: Modelos treinados com dados multilíngues podem transferir conhecimento entre idiomas, melhorando o desempenho em línguas menos representadas.

Implicações para o Futuro da IA Generativa Multilíngue

As descobertas do ATLAS têm impacto direto no desenvolvimento de IA generativa, especialmente em aplicações que exigem compreensão e produção de texto em múltiplos idiomas. Com essas leis de escala, é possível:

- Projetar modelos mais robustos, capazes de atender a uma base global de usuários.

- Reduzir custos de treinamento ao evitar superdimensionamento desnecessário.

- Promover inclusão digital, ampliando o suporte a idiomas menos representados.

- Facilitar a pesquisa colaborativa, ao fornecer um framework comum para avaliação e comparação de modelos multilíngues.

Conclusão

O estudo ATLAS do Google Research representa um avanço significativo na compreensão das dinâmicas que regem o desenvolvimento de modelos multilíngues em IA generativa. Ao oferecer leis de escala práticas, ele abre caminho para uma nova geração de sistemas mais eficientes, inclusivos e poderosos, capazes de atender à diversidade linguística do mundo com maior precisão e relevância. Para pesquisadores, desenvolvedores e entusiastas da inteligência artificial, essas descobertas são um convite para repensar estratégias e impulsionar a inovação em escala global.

Fique ligado no blog "IA em Foco" para mais análises e conteúdos exclusivos sobre as tendências que estão moldando o futuro da inteligência artificial.