ChatGPT é trapaça? O debate antigo do ghostwriting ressurge com a inteligência artificial

Desde o surgimento do ChatGPT e outras ferramentas de inteligência artificial generativa, instituições educacionais e o público em geral têm se deparado com um dilema ético que, na verdade, não é tão novo: o uso de terceiros para produzir textos em nome de outra pessoa, prática conhecida como ghostwriting (escrita fantasma).

Ghostwriting: uma prática centenária e controversa

O ghostwriting existe há mais de um século, tendo sido registrado pela primeira vez em 1908, quando um jornal americano relatou o caso de um escritor anônimo que ajudou uma mulher da alta sociedade a publicar um livro. Hoje, essa colaboração é comum entre celebridades ou profissionais que não dispõem do tempo ou da habilidade para escrever suas próprias obras, contratando escritores profissionais para redigir o conteúdo em seu nome.

Apesar de ser uma prática paga e consensual, o ghostwriting gera desconforto e dilemas éticos porque envolve a apropriação dos textos por quem não os escreveu diretamente. Muitas vezes, o nome do ghostwriter sequer aparece na capa ou nos créditos, o que pode ser visto como uma forma de engano.

ChatGPT e a nova onda de questionamentos éticos

Com o avanço dos chatbots de inteligência artificial, como o ChatGPT, o debate sobre autoria e originalidade ganhou uma nova dimensão. Diferentemente do ghostwriting tradicional, que é um serviço contratado e remunerado, o uso do ChatGPT está acessível a um público muito mais amplo, incluindo estudantes, educadores e profissionais.

Algumas universidades, como a University of Southern California, estabeleceram diretrizes que permitem o uso da IA como ferramenta de edição, mas proíbem a apresentação integral de textos gerados por IA como trabalho próprio, exigindo a divulgação do uso da ferramenta e a verificação da veracidade do conteúdo.

Essa postura reflete a preocupação com a integridade acadêmica e a transparência, que também permeia os contratos de ghostwriting, nos quais o escritor fantasma garante a originalidade do texto e assume responsabilidade por eventuais erros ou plágios.

Entre colaboração e engano: o limite ético da autoria

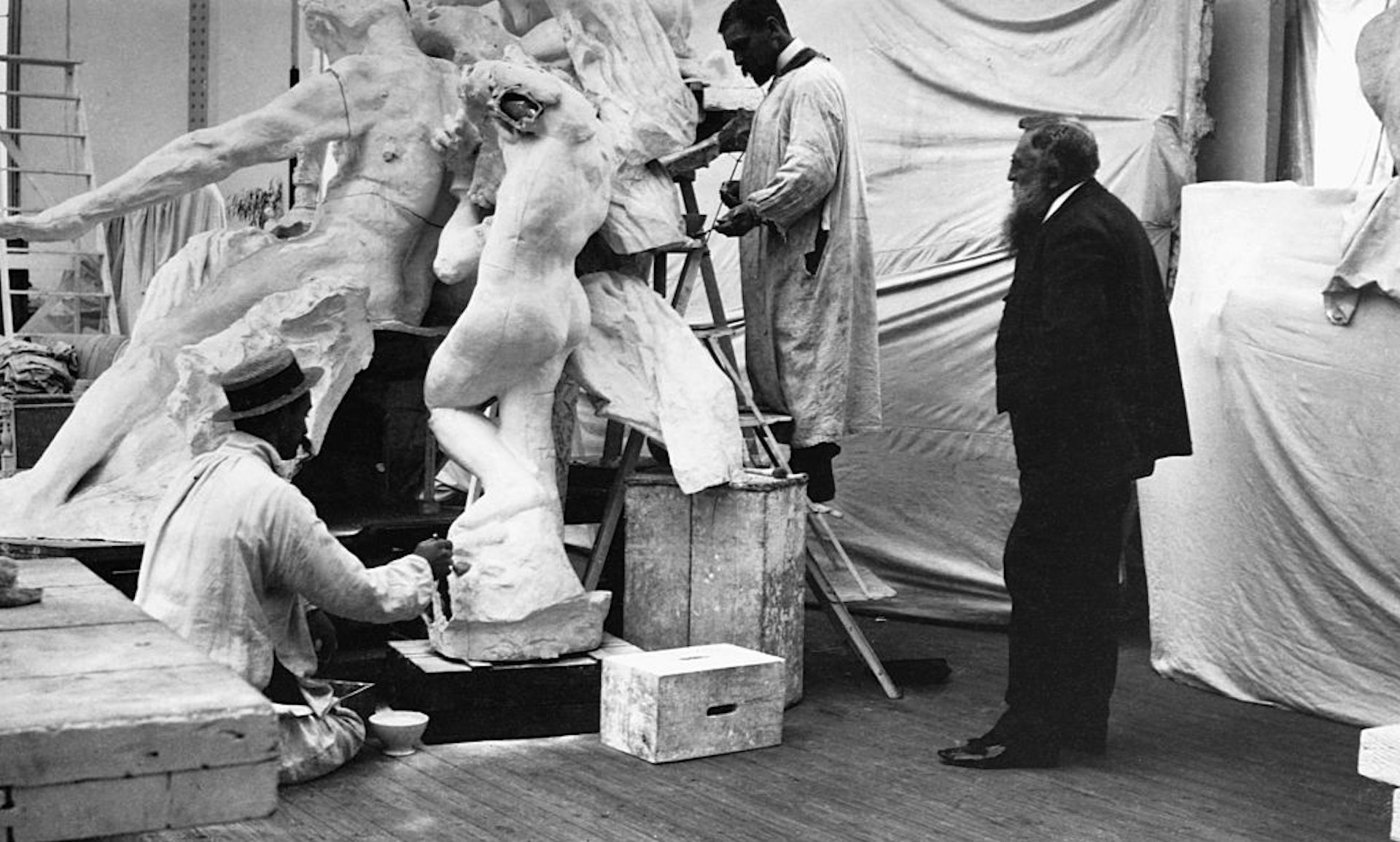

O uso de assistentes na produção intelectual é antigo e aceito em diversas áreas: editores auxiliam autores, artistas contam com assistentes em seus estúdios e roteiros de TV são escritos em equipes colaborativas. O que muda é a forma como essa colaboração é reconhecida e a medida em que ela compromete a autoria.

Um exemplo histórico ilustra essa linha tênue: no século XIX, um escultor precisou provar judicialmente sua autoria após acusações de que seus assistentes teriam feito as esculturas por ele assinadas. O juiz determinou que uma certa ajuda mecânica era aceitável, mas que ultrapassar esse limite seria desonesto.

Hoje, a questão se traduz em como as instituições e o público percebem o uso do ChatGPT e do ghostwriting: enquanto alguns veem como uma forma legítima de auxílio, outros consideram uma forma de fraude intelectual.

Implicações práticas e culturais

A aceitação do ghostwriting como prática cultural pode ter aberto caminho para o uso massificado de ferramentas de IA para a produção textual, democratizando o acesso a um tipo de "escrita assistida" antes restrito a poucos com recursos financeiros.

No entanto, essa democratização traz desafios para a educação, a ética profissional e a relação de confiança entre autor e leitor. Como equilibrar a colaboração tecnológica e humana sem comprometer a autenticidade e a responsabilidade pelo conteúdo?

Referências e recursos

- Artigo original no The Conversation AI (em inglês)

- Políticas da University of Southern California sobre uso de IA

- Associação de Ghostwriters esclarece sobre a prática

O debate sobre autoria, colaboração e ética na escrita persiste, agora ampliado pelas possibilidades e desafios trazidos pela inteligência artificial. Entender essa história e suas nuances é fundamental para refletirmos sobre o futuro da produção textual na era digital.