Cloudflare e ETH Zurich lançam estratégias de cache otimizadas para tráfego de IA

Desafios do tráfego de IA para sistemas de cache tradicionais

A Cloudflare, em parceria com a ETH Zurich, divulgou recentemente um conjunto de estratégias inovadoras para otimizar o cache em redes de entrega de conteúdo (CDNs) diante do crescente impacto do tráfego gerado por crawlers de inteligência artificial. Segundo engenheiros da Cloudflare, atualmente o tráfego de bots de IA ultrapassa 10 bilhões de requisições semanais, apresentando padrões de acesso que divergem significativamente do comportamento humano e provocam desafios operacionais inéditos.

Esses crawlers de IA emitem requisições em grande volume e de forma paralela, frequentemente acessando URLs raramente visitadas ou escaneando sites sequencialmente para alimentar serviços como a geração aumentada por recuperação (RAG, na sigla em inglês). Ao contrário dos usuários humanos, esses bots não reutilizam cache via navegador nem mantêm continuidade de sessão, o que reduz drasticamente a eficiência dos caches tradicionais.

Impactos práticos no desempenho e estabilidade

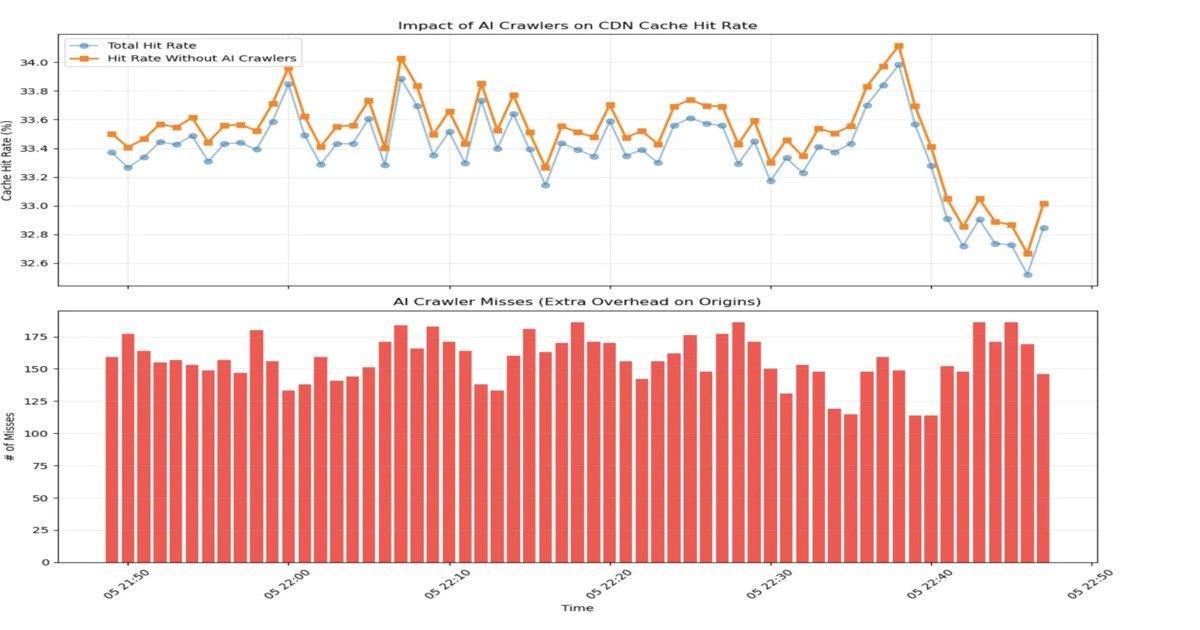

Estudos da Cloudflare demonstram que o comportamento iterativo dos agentes de IA eleva a taxa de acessos únicos a níveis entre 70% e 100%, provocando uma alta rotatividade no conteúdo armazenado nos caches e prejudicando algoritmos clássicos como least recently used (LRU). Essa situação resulta em maior número de cache misses, sobrecarga nos servidores de origem e aumento da latência nas respostas tanto em CDNs quanto em bancos de dados.

Especialistas do setor, como Amy Lee, CFO da Aerospike, ressaltam que o tráfego de IA não afeta apenas o cache na borda da rede, mas também rompe os padrões de cache em bancos de dados, tornando os acessos imprevisíveis e desafiando arquiteturas otimizadas para cargas humanas.

Novas estratégias de cache com consciência de IA

Para mitigar esses desafios, Cloudflare e ETH Zurich propõem uma série de abordagens específicas para o tráfego de IA, entre as quais:

- Separação de tráfego: dividir o cache em camadas distintas para usuários humanos e bots de IA;

- Novos algoritmos de substituição: testar políticas como least frequently used (LFU) e first in, first out (FIFO) para melhor adaptação ao padrão de acesso dos crawlers;

- Políticas adaptativas baseadas em aprendizado de máquina: aplicar modelos que ajustem dinamicamente o comportamento do cache conforme o tipo de tráfego;

- Modelos de controle de acesso: implementar feeds estruturados ou modelos de cobrança por crawling para regular o volume de acessos de IA e preservar a eficiência do cache.

Essas soluções visam equilibrar a performance para usuários humanos e serviços de IA, mantendo a estabilidade dos sistemas e a eficiência do cache.

Quem pode se beneficiar e como acessar

As estratégias apresentadas são particularmente relevantes para provedores de CDN, operadores de grandes plataformas web, serviços que hospedam conteúdo dinâmico e bancos de dados de alta escala que enfrentam volumes crescentes de crawling automatizado de IA. Embora as propostas estejam em fase de desenvolvimento e experimentação inicial, elas indicam o caminho para arquiteturas de cache futuras que suportem essa nova realidade.

Para acompanhar as atualizações e obter materiais complementares, os interessados podem acessar o blog oficial da Cloudflare e o artigo original na InfoQ, que detalha as análises e recomendações técnicas. Além disso, a comunidade técnica pode explorar recursos gratuitos de aprendizado, como minibooks e webinars disponíveis no InfoQ.