Como a Hugging Face Construíu o Servidor MCP para IA em Escala

A Hugging Face, referência mundial em inteligência artificial, recentemente compartilhou detalhes sobre a construção de seu servidor MCP (Model Control Plane), uma infraestrutura essencial para gerenciar modelos de IA em larga escala. Neste artigo, vamos explorar os principais conceitos, desafios e soluções adotadas pela equipe para criar um sistema robusto, eficiente e escalável, capaz de atender às demandas crescentes do ecossistema de IA.

Introdução ao MCP: O Coração da Gestão de Modelos

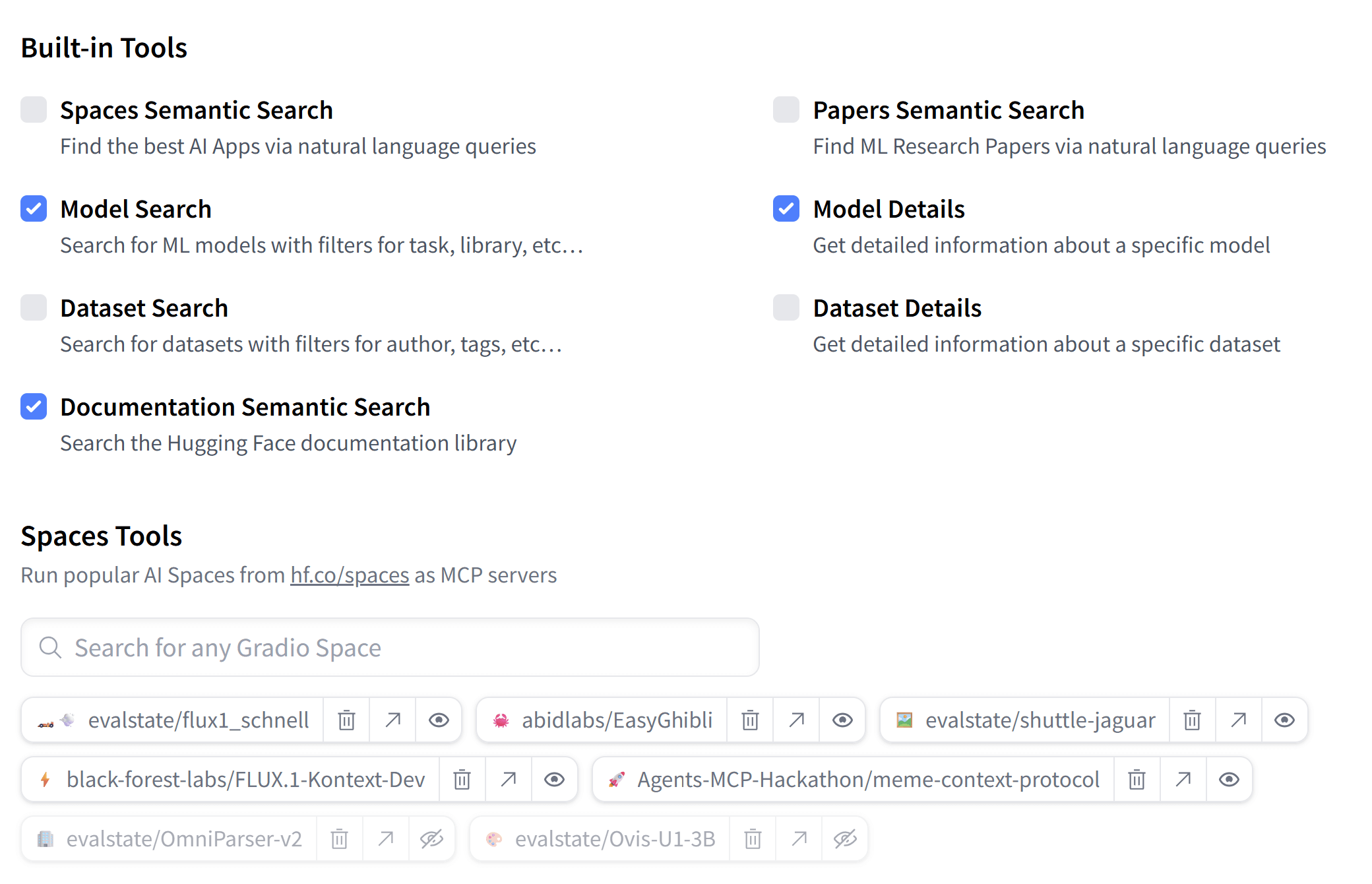

À medida que o uso de modelos de IA cresce exponencialmente, surge a necessidade de uma plataforma que permita controlar, monitorar e orquestrar esses modelos de forma centralizada. O MCP da Hugging Face foi desenvolvido exatamente para isso: servir como um plano de controle que gerencia o ciclo de vida dos modelos, desde o deploy até a atualização contínua.

Desafios na Construção do Servidor MCP

Construir um servidor que gerencie múltiplos modelos de IA em produção envolve diversos desafios técnicos e operacionais. Entre os principais, destacam-se:

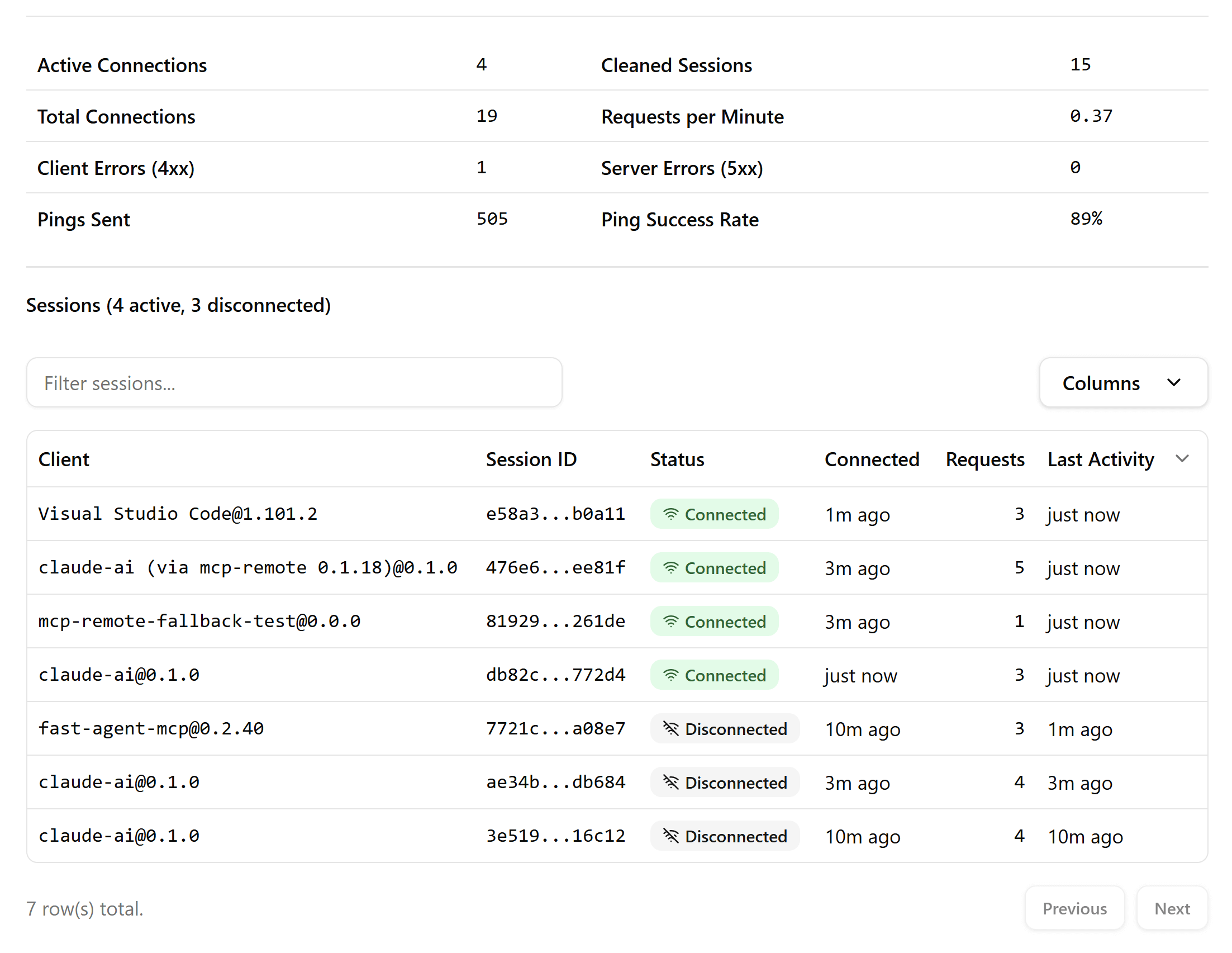

- Escalabilidade: O sistema precisa suportar milhares de requisições simultâneas sem perda de performance.

- Gerenciamento de versões: Controlar diferentes versões dos modelos e garantir que as atualizações sejam feitas sem interrupções.

- Monitoramento e segurança: Rastrear o desempenho dos modelos e proteger os dados e acessos.

- Integração com múltiplas plataformas: Compatibilidade com diversas infraestruturas e frameworks de IA.

Arquitetura do MCP: Um Sistema Modular e Resiliente

Para atender a esses desafios, a Hugging Face adotou uma arquitetura modular que divide responsabilidades em componentes especializados. Alguns pontos-chave incluem:

- Plano de controle centralizado: Responsável por gerenciar o estado dos modelos e coordenar as operações.

- Serviços de orquestração: Automatizam o deploy, rollback e escalonamento dos modelos conforme a demanda.

- Banco de dados distribuído: Armazena informações sobre versões, métricas e configurações de forma consistente e segura.

- APIs RESTful: Facilitam a comunicação entre clientes, desenvolvedores e o MCP, garantindo flexibilidade e extensibilidade.

Implementações Técnicas e Tecnologias Utilizadas

O desenvolvimento do MCP envolveu a escolha criteriosa de tecnologias para garantir desempenho e confiabilidade. Entre as soluções adotadas, destacam-se:

- Kubernetes: Para orquestração de containers e escalabilidade automática.

- gRPC: Comunicação eficiente entre microserviços.

- PostgreSQL: Banco de dados relacional para armazenamento robusto.

- Prometheus e Grafana: Monitoramento e visualização de métricas em tempo real.

Benefícios do MCP para o Ecossistema de IA

Com o MCP, a Hugging Face oferece uma solução que traz diversos benefícios para desenvolvedores, empresas e pesquisadores:

- Agilidade no deploy: Reduz o tempo para colocar modelos em produção.

- Confiabilidade: Minimiza falhas e garante alta disponibilidade.

- Visibilidade: Permite monitorar o desempenho e comportamento dos modelos em tempo real.

- Flexibilidade: Suporta múltiplos frameworks e ambientes.

Conclusão: O Futuro da Gestão de Modelos com o MCP

A construção do servidor MCP pela Hugging Face representa um avanço significativo na gestão de modelos de IA em escala. Ao combinar arquitetura moderna, tecnologias robustas e foco na experiência do usuário, o MCP estabelece um novo padrão para o controle e monitoramento de modelos. À medida que o campo da inteligência artificial evolui, soluções como essa serão fundamentais para garantir que o poder dos modelos seja explorado com eficiência, segurança e transparência.

Se você atua com IA e busca otimizar a implantação e gestão dos seus modelos, acompanhar o desenvolvimento do MCP e suas práticas pode ser um diferencial estratégico para o seu negócio ou pesquisa.