Como Explorar Todas as Camadas dos Grandes Modelos de Linguagem para Aumentar a Precisão

Nos últimos anos, os Grandes Modelos de Linguagem (LLMs) revolucionaram a forma como interagimos com a inteligência artificial, possibilitando avanços significativos em tarefas como tradução automática, geração de texto e compreensão de linguagem natural. Contudo, apesar do sucesso, ainda existem desafios importantes relacionados à precisão e confiabilidade dessas redes neurais complexas.

Introdução: O Desafio da Precisão nos LLMs

Os LLMs são compostos por múltiplas camadas que processam e transformam informações de forma hierárquica. Tradicionalmente, a saída final do modelo, obtida na última camada, é utilizada para gerar respostas ou previsões. No entanto, essa abordagem pode desperdiçar informações valiosas presentes nas camadas intermediárias, que capturam diferentes aspectos do conhecimento e da estrutura da linguagem.

Pesquisadores do Google Research propuseram uma abordagem inovadora que utiliza todas as camadas do modelo para melhorar a precisão das respostas geradas. Este método abre novas possibilidades para o desenvolvimento de sistemas de IA mais robustos e confiáveis.

Entendendo a Estrutura das Camadas nos LLMs

Para compreender a importância da utilização de todas as camadas, é fundamental entender como os LLMs funcionam internamente. Cada camada do modelo atua como um filtro que extrai características específicas do texto de entrada:

- Camadas iniciais: Capturam informações básicas, como sintaxe e relações gramaticais.

- Camadas intermediárias: Extraem padrões semânticos e contextuais mais complexos.

- Camadas finais: Integram o conhecimento para gerar a saída final.

Ao focar apenas na última camada, o modelo pode perder nuances importantes que estão distribuídas ao longo de toda a rede.

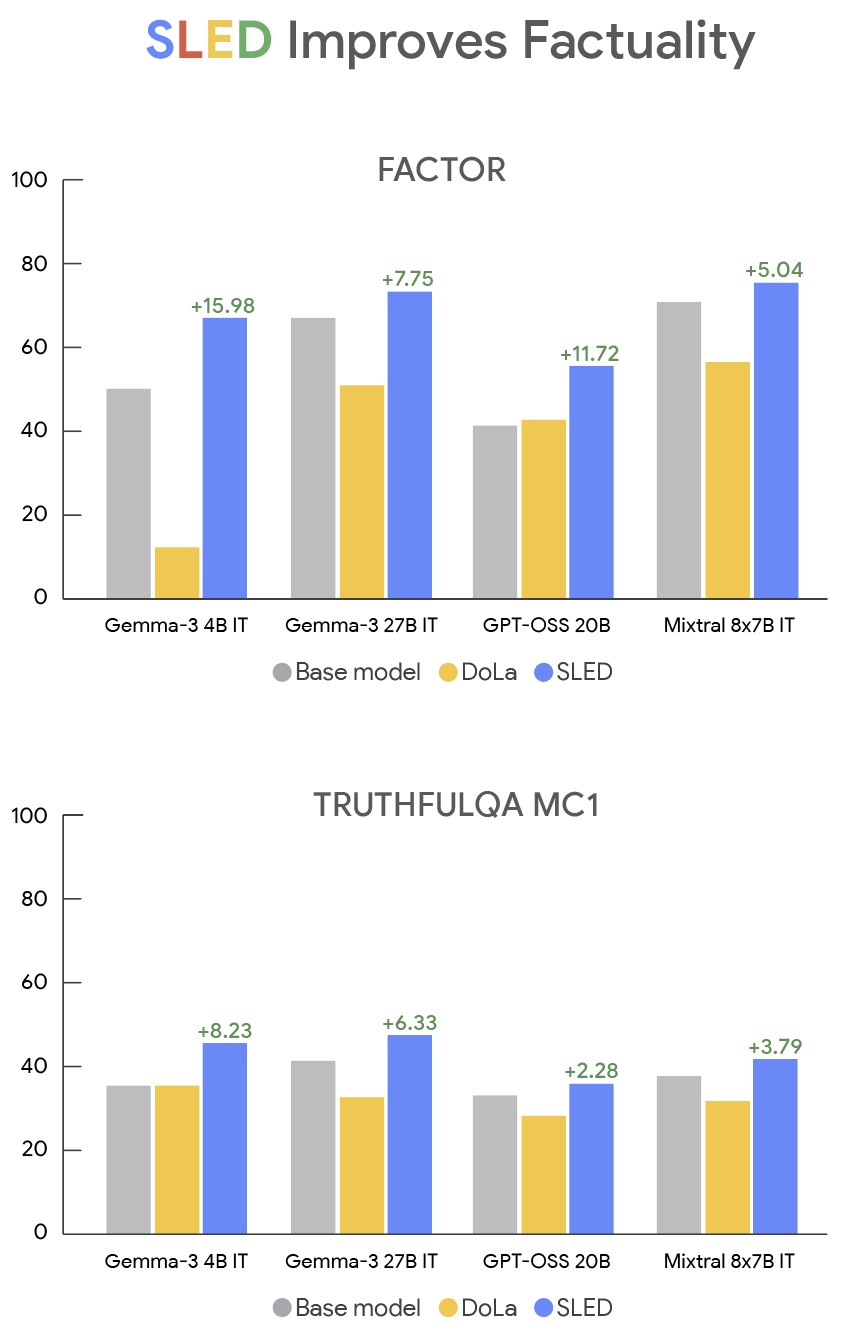

A Abordagem do Google Research: Utilizando Todas as Camadas

O estudo do Google Research propõe um algoritmo que agrega informações de todas as camadas do LLM, combinando seus sinais para produzir uma resposta mais precisa. Essa técnica, conhecida como layer-wise aggregation, permite que o modelo aproveite o conhecimento em diferentes níveis de abstração.

Os principais benefícios dessa abordagem são:

- Melhora na acurácia: A combinação das camadas reduz erros causados por informações perdidas na última camada.

- Robustez: O modelo se torna menos suscetível a ruídos e ambiguidades no texto de entrada.

- Flexibilidade: Pode ser aplicada a diversos tipos de tarefas, desde respostas a perguntas até geração de texto criativo.

Implicações para o Futuro da IA Generativa

Essa inovação tem impacto direto no campo da Inteligência Artificial Generativa, onde a qualidade das respostas é crucial para aplicações comerciais e acadêmicas. Ao utilizar todas as camadas, os LLMs podem entregar resultados mais confiáveis, o que é fundamental para:

- Assistentes virtuais: Respostas mais precisas aumentam a satisfação do usuário.

- Ferramentas de criação de conteúdo: Textos gerados com maior coerência e relevância.

- Pesquisa e análise de dados: Interpretações mais acuradas de grandes volumes de texto.

Desafios e Considerações Técnicas

Apesar dos avanços, a implementação dessa técnica exige maior poder computacional, pois envolve o processamento e a combinação de múltiplas camadas simultaneamente. Além disso, é necessário desenvolver algoritmos eficientes para balancear as contribuições de cada camada, evitando que informações redundantes ou contraditórias prejudiquem o resultado final.

Outro ponto importante é a adaptação dessa abordagem para diferentes arquiteturas de modelos, garantindo que a técnica seja aplicável de forma ampla e não restrita a um único tipo de LLM.

Conclusão: Um Passo à Frente na Evolução dos LLMs

A pesquisa do Google Research nos mostra que explorar o potencial completo das camadas dos Grandes Modelos de Linguagem é uma estratégia promissora para superar limitações atuais em precisão e robustez. Ao integrar informações de todas as camadas, podemos construir sistemas de IA mais inteligentes, capazes de compreender e gerar linguagem com maior fidelidade.

Essa abordagem representa um avanço significativo em algoritmos e teoria da inteligência artificial, abrindo caminho para aplicações mais sofisticadas e confiáveis no futuro próximo.

Fique atento ao blog "IA em Foco" para mais novidades e análises sobre as tendências que estão moldando o futuro da inteligência artificial.