Como Garantir Privacidade na Era da Inteligência Artificial Generativa

Introdução

A inteligência artificial generativa tem revolucionado a forma como interagimos com a tecnologia, criando conteúdos, insights e soluções inovadoras. No entanto, com esse avanço, surgem preocupações legítimas sobre a privacidade dos dados utilizados e gerados por esses sistemas. Recentemente, pesquisadores do Google Research apresentaram avanços significativos para garantir que o uso da IA generativa seja acompanhado de mecanismos robustos de privacidade, oferecendo insights confiáveis sem comprometer informações sensíveis.

O Desafio da Privacidade na IA Generativa

A IA generativa utiliza grandes volumes de dados para aprender padrões e criar novos conteúdos, desde textos até imagens e vídeos. Esse processo, embora poderoso, levanta questões importantes:

- Como proteger dados pessoais durante o treinamento e a inferência?

- De que forma garantir que os modelos não vazem informações sensíveis?

- Como oferecer transparência e controle aos usuários sobre o uso de seus dados?

Essas perguntas são cruciais para a adoção ética e segura da IA generativa em diversas aplicações, desde assistentes virtuais até sistemas de recomendação e criação de conteúdo automatizado.

Avanços do Google Research em Privacidade Provável

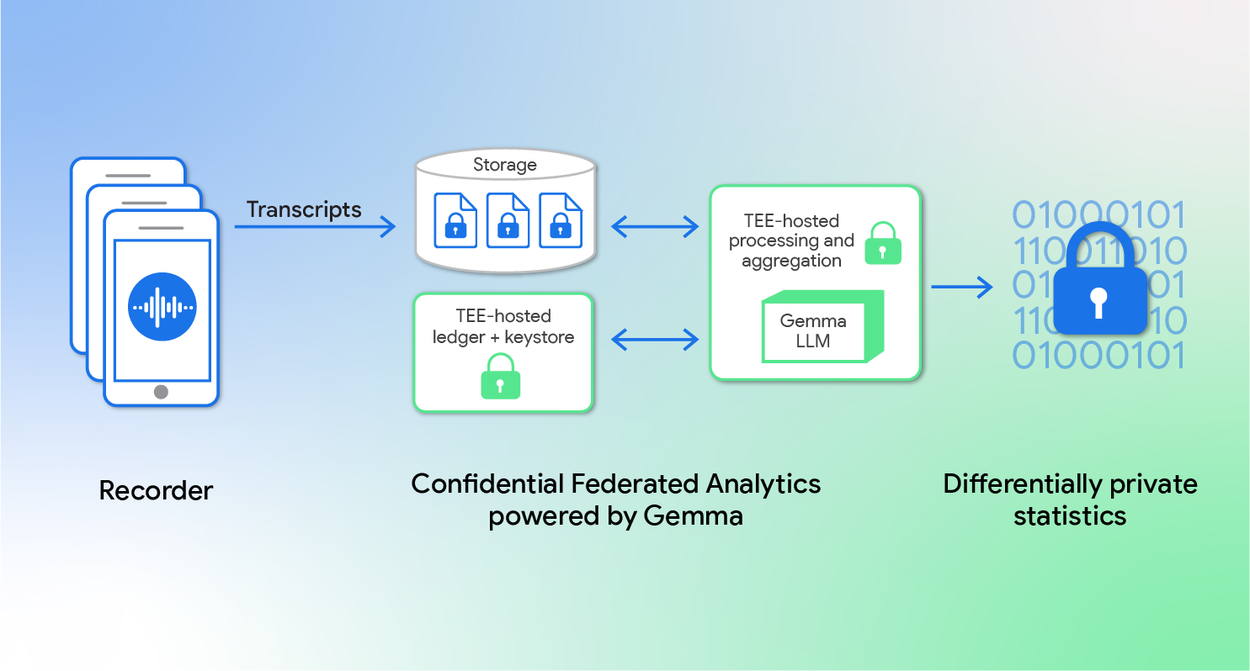

O artigo Toward provably private insights into AI use destaca uma abordagem inovadora para lidar com esses desafios. O foco está em desenvolver técnicas que garantam privacidade diferencial, um conceito matemático que assegura que a saída de um sistema não compromete a privacidade dos dados individuais usados no processo.

Os principais pontos abordados incluem:

- Modelos com garantias formais de privacidade: Ao incorporar mecanismos de ruído controlado e algoritmos específicos, é possível limitar a exposição de dados sensíveis sem sacrificar a utilidade dos insights gerados.

- Monitoramento e prevenção de abusos: Sistemas que detectam e bloqueiam tentativas de extração indevida de informações privadas, protegendo tanto usuários quanto organizações.

- Integração em dispositivos móveis: Garantir que a privacidade seja mantida mesmo em ambientes com recursos limitados, como smartphones, ampliando o alcance e a segurança da IA generativa.

Impactos e Aplicações Práticas

Essas inovações têm potencial para transformar diversos setores:

- Saúde: Análise de dados médicos com privacidade garantida, permitindo avanços em diagnósticos e tratamentos personalizados sem expor informações sensíveis.

- Educação: Ferramentas inteligentes que adaptam conteúdos ao perfil do aluno, respeitando sua privacidade e dados pessoais.

- Setor financeiro: Modelos que avaliam riscos e fraudam com segurança, protegendo dados bancários e transacionais.

Além disso, a adoção dessas práticas fortalece a confiança dos usuários e regulações, facilitando a expansão da IA generativa em escala global.

Conclusão

Garantir a privacidade na era da inteligência artificial generativa é um desafio complexo, mas essencial para o futuro da tecnologia. As pesquisas do Google Research apontam caminhos promissores para que possamos usufruir dos benefícios da IA sem abrir mão da segurança e da ética. A combinação de técnicas matemáticas avançadas, monitoramento contínuo e adaptação a diferentes plataformas cria um cenário mais seguro e transparente para todos os envolvidos.

À medida que a IA generativa se torna parte integrante do nosso cotidiano, investir em privacidade provada não é apenas uma necessidade técnica, mas um compromisso com a proteção dos direitos e da confiança dos usuários.