Como Rodar Modelos de Linguagem Grande no Seu Celular com React Native: Guia Prático e Divertido

Nos últimos anos, os Modelos de Linguagem Grande (LLMs) revolucionaram a forma como interagimos com a tecnologia, trazendo avanços incríveis em processamento de linguagem natural. Tradicionalmente, esses modelos são executados em servidores robustos na nuvem, exigindo muita potência computacional e conexão constante à internet. Mas e se você pudesse rodar um LLM diretamente no seu celular, sem depender da nuvem? Neste artigo, vamos explorar como executar LLMs na borda (edge) usando React Native, tornando essa experiência acessível, prática e até divertida!

O que significa rodar LLMs na borda?

Rodar LLMs na borda significa executar esses modelos diretamente em dispositivos locais, como smartphones, tablets ou dispositivos IoT, em vez de depender de servidores remotos. Isso traz várias vantagens, como:

- Privacidade: Seus dados não precisam sair do dispositivo.

- Baixa latência: Respostas instantâneas sem depender da velocidade da internet.

- Autonomia: Funciona mesmo sem conexão com a internet.

Por que usar React Native para isso?

React Native é uma das tecnologias mais populares para desenvolvimento mobile cross-platform, permitindo criar aplicativos para Android e iOS com uma base única de código em JavaScript. Ao combinar React Native com bibliotecas específicas para IA, podemos integrar LLMs diretamente no app, aproveitando a flexibilidade da plataforma e a facilidade de desenvolvimento.

Benefícios do React Native para LLMs na borda

- Desenvolvimento ágil: código compartilhado entre plataformas.

- Comunidade ativa: vasta gama de plugins e suporte.

- Integração com bibliotecas nativas: permite usar frameworks de IA otimizados.

Passo a passo para rodar um LLM no seu celular

Vamos detalhar um guia simples para você começar a executar LLMs via React Native no seu smartphone.

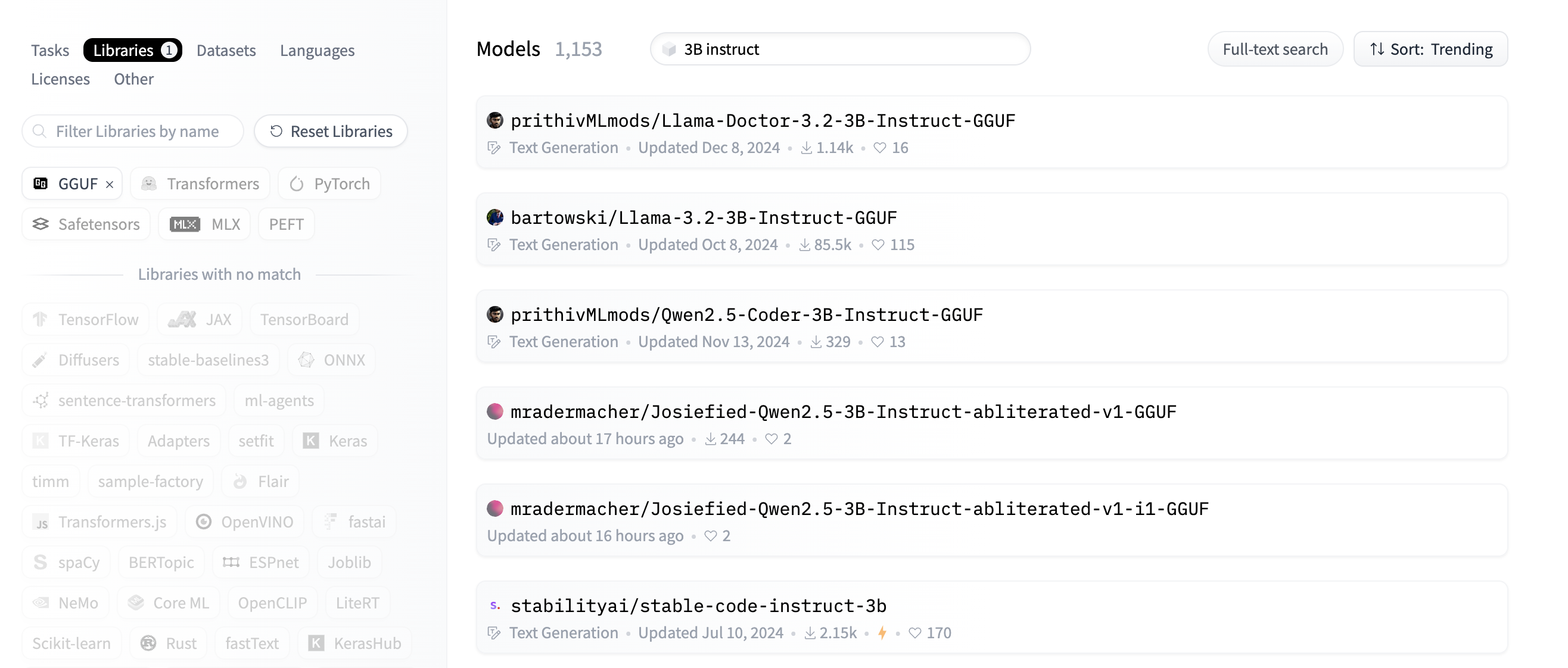

1. Escolha do modelo

Modelos como GPT-J, GPT-Neo ou versões menores do GPT-2 são boas opções para rodar localmente, pois possuem tamanhos mais manejáveis e boa performance.

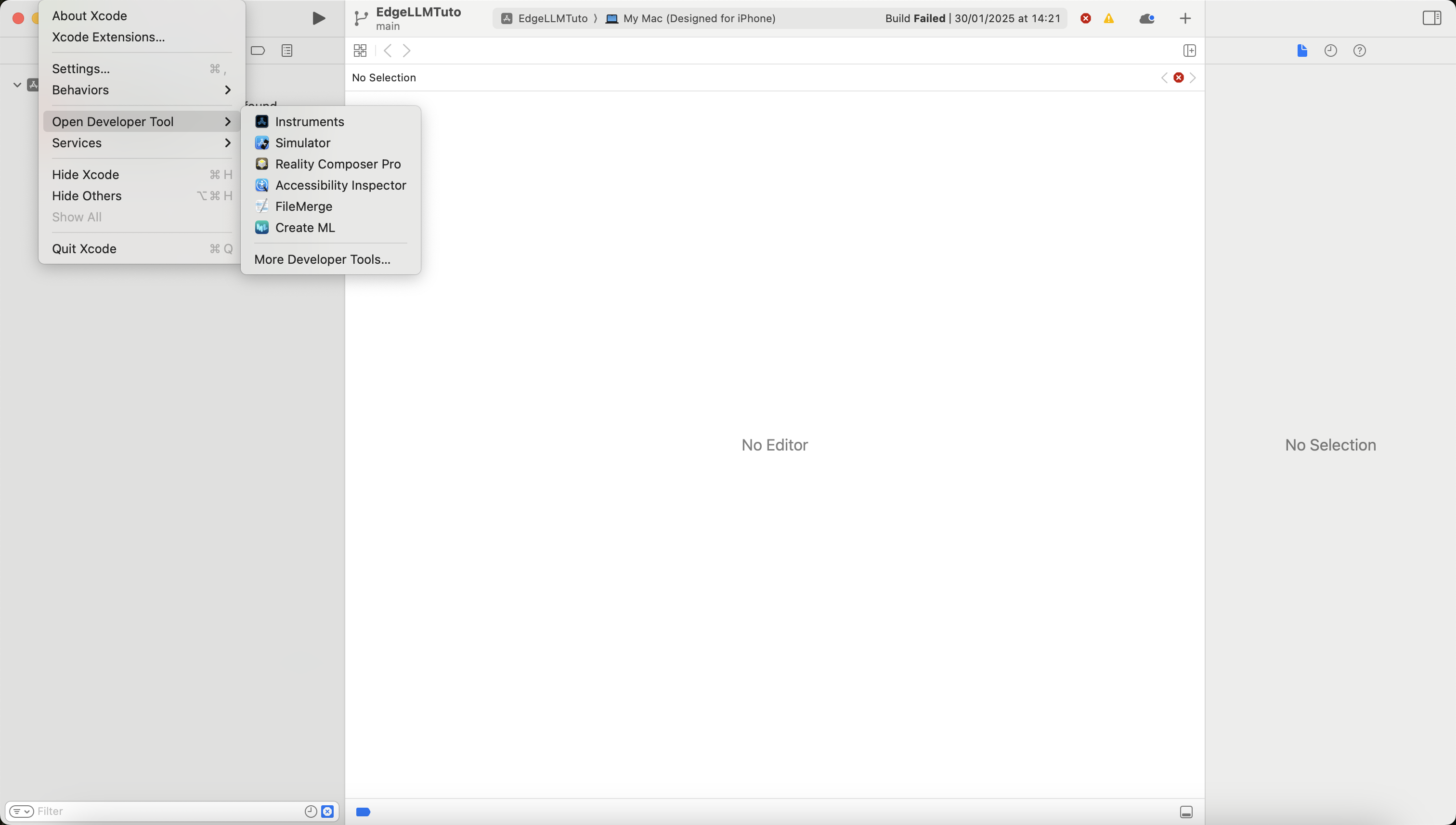

2. Configuração do ambiente React Native

- Instale o Node.js e o React Native CLI.

- Crie um novo projeto com

npx react-native init MeuAppLLM. - Configure o ambiente para Android e/ou iOS conforme a documentação oficial.

3. Integração do modelo

Use bibliotecas como transformers.js ou onnxruntime-react-native para carregar e executar o modelo no dispositivo. Essas ferramentas permitem converter modelos treinados para formatos otimizados e rodar inferência com boa performance.

4. Interface de usuário

Crie componentes para entrada de texto, exibição de respostas e controle do modelo. Aproveite a flexibilidade do React Native para criar uma experiência intuitiva e responsiva.

5. Testes e otimizações

- Teste a aplicação em diferentes dispositivos para garantir compatibilidade.

- Otimize o desempenho usando técnicas como quantização do modelo e carregamento assíncrono.

Desafios e considerações

Apesar das vantagens, rodar LLMs na borda apresenta desafios:

- Limitações de hardware: Smartphones possuem menos memória e poder computacional que servidores.

- Consumo de bateria: Processamento intenso pode drenar a bateria rapidamente.

- Atualização do modelo: Manter o modelo atualizado pode exigir downloads periódicos.

Por isso, é importante balancear o tamanho do modelo e a complexidade das tarefas para garantir uma boa experiência.

Conclusão

Executar Modelos de Linguagem Grande diretamente no seu celular é uma tendência que promete transformar a forma como interagimos com a IA, trazendo mais privacidade, autonomia e rapidez. Com React Native, essa jornada fica ainda mais acessível, permitindo criar aplicativos multiplataforma que aproveitam o poder dos LLMs na borda. Se você é desenvolvedor ou entusiasta, vale a pena explorar essa combinação e experimentar o futuro da inteligência artificial móvel!

Fique ligado no blog "IA em Foco" para mais conteúdos inovadores sobre inteligência artificial e tecnologia!