Como Rodar seu Modelo de Visão e Linguagem em CPUs Intel em 3 Passos Simples

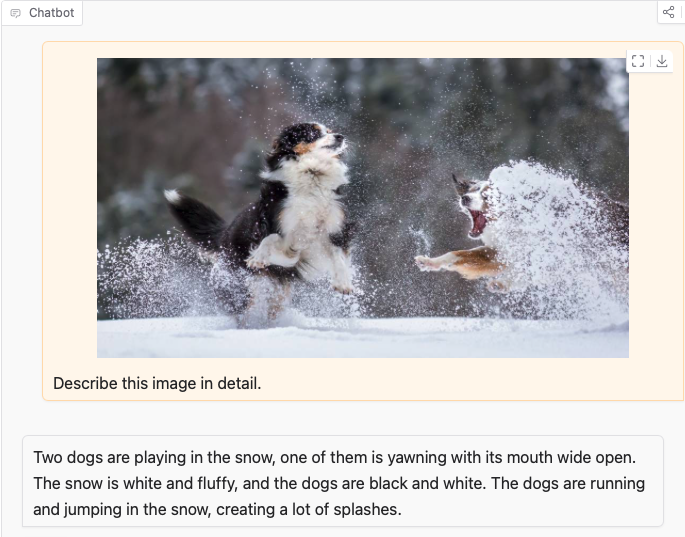

Nos últimos anos, os modelos de Visão e Linguagem (VLMs) têm revolucionado a forma como máquinas interpretam e interagem com o mundo ao seu redor. Desde aplicações em reconhecimento de imagens até geração de legendas automáticas, esses modelos combinam o poder da visão computacional com o processamento de linguagem natural para oferecer soluções inovadoras.

No entanto, a execução desses modelos costuma demandar hardware robusto, como GPUs de última geração, o que pode ser um obstáculo para muitos desenvolvedores e empresas. Pensando nisso, a HuggingFace disponibilizou um método simples e eficiente para rodar VLMs em CPUs Intel, democratizando o acesso a essa tecnologia.

Por que rodar VLMs em CPUs Intel?

Embora GPUs sejam tradicionalmente preferidas para tarefas de aprendizado profundo devido à sua capacidade de processamento paralelo, as CPUs Intel modernas têm avançado significativamente em desempenho e otimizações para IA. Isso significa que é possível executar modelos complexos sem a necessidade de investimentos altos em hardware especializado.

Além disso, rodar modelos em CPUs traz vantagens como:

- Maior acessibilidade: CPUs são mais comuns e presentes em uma variedade maior de dispositivos.

- Facilidade de implantação: Menor complexidade na configuração e manutenção do ambiente.

- Redução de custos: Evita gastos com GPUs caras e infraestrutura associada.

Passo 1: Preparando o ambiente

Antes de começar, é fundamental garantir que seu sistema está pronto para executar o modelo. Isso inclui:

- Instalar o Python 3.8 ou superior

- Configurar um ambiente virtual para isolar dependências

- Atualizar pacotes essenciais como pip e setuptools

Recomenda-se também instalar a biblioteca Intel Extension for PyTorch, que otimiza o desempenho dos modelos em CPUs Intel.

Passo 2: Baixando e configurando o modelo VLM

Com o ambiente pronto, o próximo passo é obter um modelo VLM pré-treinado disponível na HuggingFace. A plataforma oferece diversos modelos otimizados para execução em CPUs, facilitando a integração em projetos.

Para isso, utilize a biblioteca transformers para carregar o modelo e o tokenizador correspondente. Além disso, configure o pipeline para utilizar a extensão Intel, garantindo melhor aproveitamento do hardware.

Passo 3: Executando inferências com eficiência

Finalmente, você pode realizar inferências utilizando seu modelo VLM em CPUs Intel. É importante seguir algumas boas práticas para maximizar a performance:

- Batching: Processar múltiplas entradas simultaneamente para otimizar o uso da CPU.

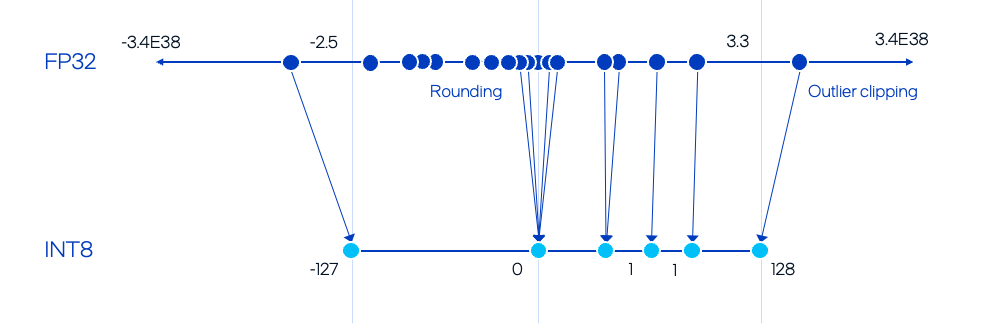

- Quantização: Utilizar modelos quantizados para reduzir o uso de memória e acelerar a inferência.

- Monitoramento: Acompanhar o uso de recursos para ajustar parâmetros conforme necessário.

Com esses cuidados, é possível obter resultados rápidos e precisos, mesmo em hardware convencional.

Conclusão

Rodar modelos de Visão e Linguagem em CPUs Intel nunca foi tão acessível. Com as otimizações certas e um passo a passo claro, desenvolvedores e empresas podem aproveitar o poder da IA sem depender exclusivamente de GPUs. A HuggingFace, ao disponibilizar ferramentas e modelos otimizados, contribui para a democratização dessa tecnologia.

Se você está buscando integrar VLMs em seus projetos, vale a pena experimentar essa abordagem simples e eficiente. Comece hoje mesmo e descubra como a inteligência artificial pode transformar suas soluções, mesmo com recursos limitados.