Como Treinar Modelos de Embeddings Estáticos com Sentence Transformers 400x Mais Rápido

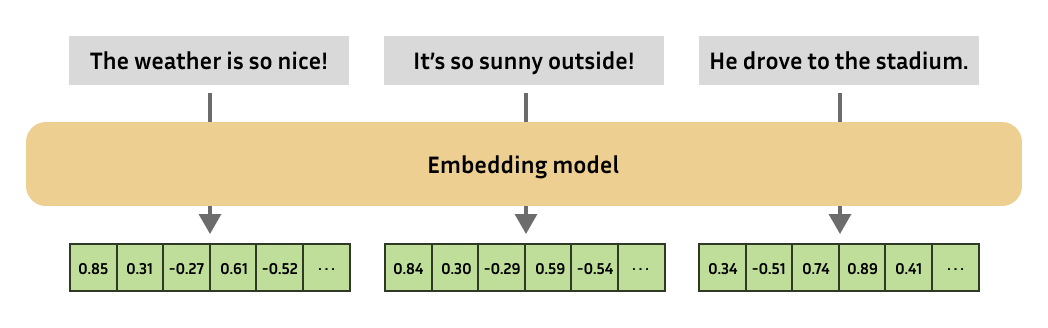

Nos últimos anos, os modelos de embeddings têm se tornado fundamentais para diversas aplicações em Inteligência Artificial, especialmente no processamento de linguagem natural (PLN). Eles transformam palavras, frases e documentos em vetores numéricos que capturam o significado semântico, permitindo que máquinas compreendam e manipulem textos de forma eficiente.

No entanto, o treinamento desses modelos pode ser extremamente demorado e custoso em termos computacionais. Pensando nisso, a HuggingFace, uma das maiores referências em IA, apresentou uma abordagem revolucionária para acelerar o treinamento de modelos de embeddings estáticos utilizando a biblioteca Sentence Transformers. Neste artigo, vamos explorar como essa técnica permite treinar modelos até 400 vezes mais rápido, sem perder qualidade, e o que isso significa para o futuro do PLN.

O que são Embeddings Estáticos e Sentence Transformers?

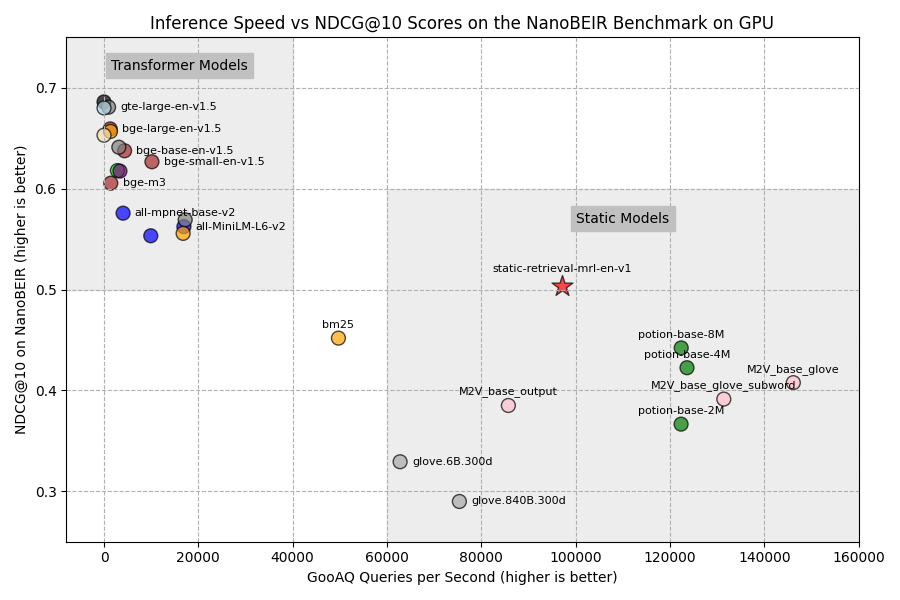

Embeddings estáticos são representações vetoriais fixas para palavras ou frases, onde cada termo tem um único vetor independente do contexto. Exemplos clássicos incluem Word2Vec e GloVe. Apesar de simples, esses embeddings são muito úteis para tarefas que não exigem entendimento contextual profundo.

Já os Sentence Transformers são modelos baseados em arquiteturas Transformer que geram embeddings para sentenças ou textos maiores, capturando nuances semânticas com maior precisão. Eles são amplamente usados para busca semântica, agrupamento de textos, detecção de similaridade, entre outras aplicações.

Por que o Treinamento Tradicional é Lento?

O treinamento de embeddings estáticos tradicionalmente envolve o processamento de grandes corpora de texto, onde o modelo aprende a mapear palavras ou frases para vetores em um espaço semântico. Esse processo pode levar dias ou semanas, dependendo do tamanho dos dados e da infraestrutura disponível.

Além disso, métodos que utilizam arquiteturas complexas, como Transformers, demandam muitos recursos computacionais, tornando o treinamento ainda mais lento e custoso.

A Inovação da HuggingFace: Treinamento 400x Mais Rápido

A HuggingFace propôs uma técnica que combina a eficiência dos embeddings estáticos com a qualidade dos Sentence Transformers, otimizando o processo de treinamento de forma significativa. O segredo está em:

- Uso de embeddings pré-treinados: aproveitando vetores já treinados para acelerar o aprendizado.

- Treinamento estático simplificado: evitando o recalculo constante dos embeddings durante o treinamento.

- Implementação otimizada na biblioteca Sentence Transformers: que permite paralelismo e melhor uso do hardware.

Com essas melhorias, é possível reduzir drasticamente o tempo de treinamento, chegando a uma aceleração de até 400 vezes em relação aos métodos tradicionais.

Benefícios Práticos para Desenvolvedores e Pesquisadores

Essa inovação traz diversas vantagens:

- Redução de custos computacionais: menos tempo de GPU significa menos gastos financeiros.

- Experimentação mais rápida: permite testar diferentes configurações e modelos em menos tempo.

- Facilidade de integração: a biblioteca Sentence Transformers é amplamente utilizada e fácil de incorporar em projetos existentes.

- Manutenção da qualidade: apesar da velocidade, a performance dos embeddings permanece competitiva.

Como Implementar essa Técnica?

Para aproveitar essa abordagem, siga os passos básicos:

- Escolha um modelo pré-treinado compatível com Sentence Transformers.

- Configure o treinamento para embeddings estáticos, evitando atualizações dinâmicas.

- Utilize a infraestrutura de hardware recomendada para maximizar paralelismo.

- Monitore a performance para garantir que a qualidade dos embeddings seja mantida.

Além disso, a HuggingFace disponibiliza documentação e exemplos práticos para facilitar a adoção dessa técnica.

Conclusão

A aceleração no treinamento de modelos de embeddings estáticos com Sentence Transformers representa um avanço significativo para o campo do processamento de linguagem natural. Reduzir o tempo de treinamento em até 400 vezes não só economiza recursos, mas também abre portas para inovações mais rápidas e acessíveis.

Para desenvolvedores, pesquisadores e empresas que trabalham com IA, essa técnica pode transformar a forma como modelos são treinados e aplicados, tornando projetos mais ágeis e eficientes. Fique atento às atualizações da HuggingFace e explore as possibilidades que essa abordagem oferece para o seu próximo projeto em IA.