ConTextual: Novo benchmark para raciocínio multimodal em imagens com textos complexos

O que é o ConTextual?

ConTextual é um novo conjunto de dados e benchmark criado por pesquisadores da Universidade da Califórnia em Los Angeles (UCLA) para avaliar a capacidade de modelos multimodais (LMMs) de realizar raciocínio conjunto sobre textos e imagens em cenas ricas em texto. Diferentemente dos testes tradicionais que avaliam modelos apenas na compreensão de imagens ou textos isoladamente, o ConTextual foca em cenários onde a interação entre texto e contexto visual é fundamental, como mapas, memes, infográficos e interfaces digitais.

Características do dataset e das tarefas

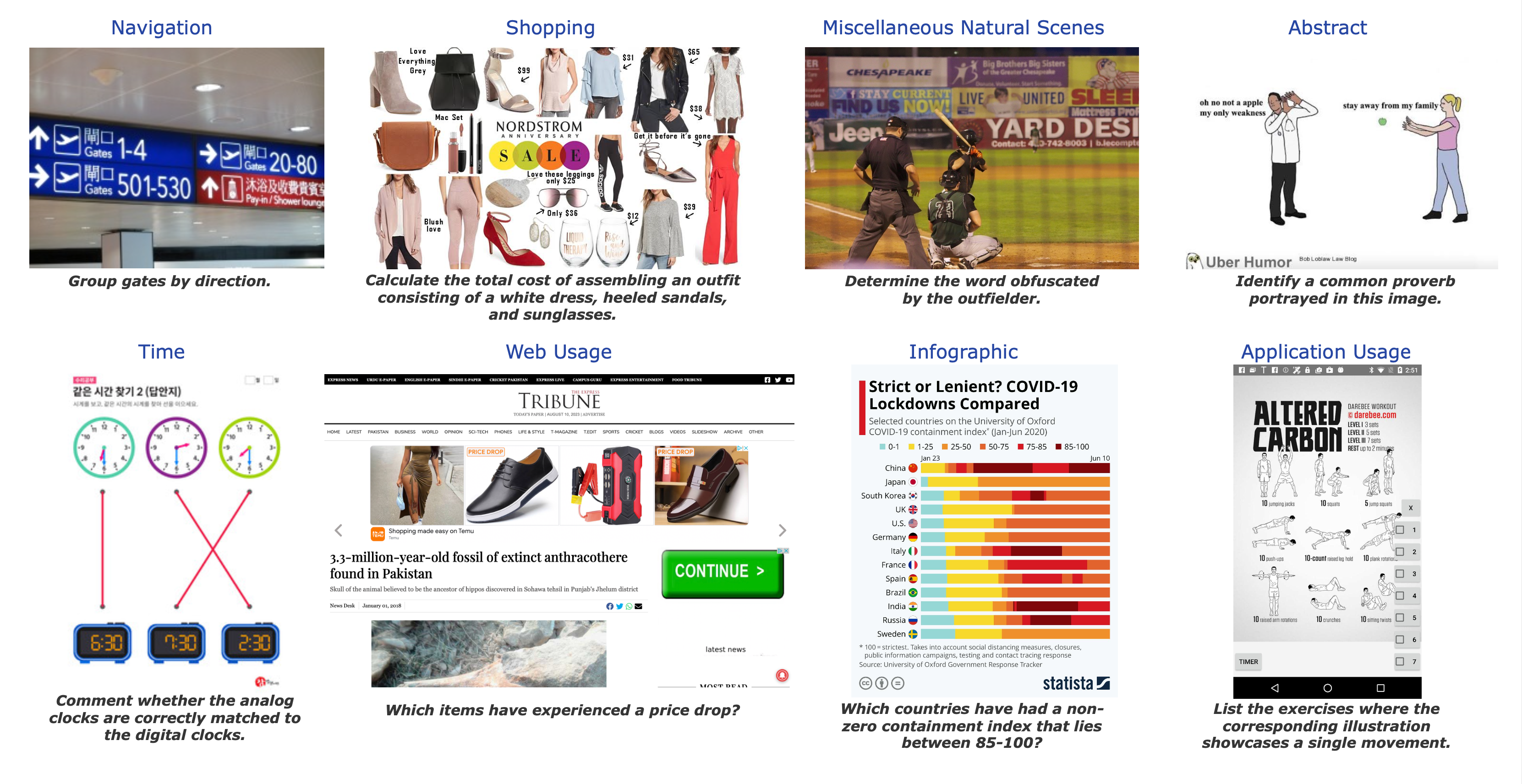

O ConTextual contém 506 instruções desafiadoras distribuídas em oito categorias do mundo real: Leitura de horários, Compras, Navegação, Cenas abstratas, Aplicativos móveis, Páginas web, Infográficos e Cenas naturais diversas. Cada exemplo inclui:

- Uma imagem rica em texto;

- Uma instrução humana (pergunta ou tarefa imperativa);

- Uma resposta de referência escrita por humanos.

O dataset é disponibilizado em duas versões: um conjunto de validação com 100 exemplos completos (imagens, instruções e respostas) e um conjunto de teste com 506 exemplos contendo apenas imagens e instruções. Para facilitar o desenvolvimento, há um sandbox de avaliação disponível no GitHub.

Modelos avaliados e metodologia

Na avaliação inicial, 13 modelos foram testados, divididos em três grupos:

- Abordagem LLM aumentada: GPT-4 combinado com informações visuais extraídas via OCR e legendas densas das imagens;

- Modelos fechados: GPT-4V(ision) e Gemini-Vision-Pro;

- Modelos open-source: LLaVA-v1.5-13B, ShareGPT4V-7B, Instruct-Blip-Vicuna-7B, mPlugOwl-v2-7B, Bliva-Vicuna-7B, Qwen-VL-7B e Idefics-9B.

A avaliação automática utiliza um método de "LLM como juiz", onde o GPT-4 recebe a instrução, a resposta de referência e a resposta prevista pelo modelo para decidir se esta é aceitável, aproveitando sua alta correlação com avaliações humanas.

Principais resultados e desafios identificados

Os testes mostraram que os modelos multimodais atuais ainda enfrentam dificuldades significativas para lidar com o raciocínio conjunto em imagens com textos complexos. Entre os pontos destacados:

- Modelos proprietários, mesmo os de ponta, têm desempenho inferior ao humano em tarefas que envolvem leitura de horários e interpretação de infográficos;

- GPT-4V foi o melhor modelo, superando humanos em raciocínio abstrato, possivelmente devido ao treinamento com memes e citações, mas apresentou fragilidades em tarefas temporais;

- Modelos open-source apresentaram bom desempenho apenas em domínios como cenas abstratas e naturais, mas ficaram atrás em áreas como navegação, compras e uso de aplicativos, sugerindo falta de diversidade nos dados de treinamento;

- A abordagem que combina LLMs com OCR e legendas textuais teve aprovação humana baixa (17,2%), indicando que é necessário um alinhamento mais fino entre visão e linguagem para resolver esses desafios.

Os pesquisadores recomendam avanços em codificadores de imagem, descrições visuais precisas e alinhamento detalhado entre visão e linguagem para melhorar o desempenho em raciocínio multimodal contextualizado.

Como participar do benchmark ConTextual

O ConTextual está aberto para submissões de resultados dos modelos tanto no conjunto de validação quanto no conjunto de teste. Para o conjunto de validação, há um código de autoavaliação baseado no GPT-4 disponível no repositório oficial (https://github.com/rohan598/ConTextual), que gera um arquivo JSON com os resultados esperados.

Formato esperado para submissão na validação:

{

"nome_do_modelo": {

"url_da_imagem": 1 // para sucesso, 0 para falha

}

}São esperadas 100 previsões, uma para cada URL do conjunto de validação.

Para submissão no conjunto de teste, o arquivo JSON deve conter as 506 previsões de respostas em texto para cada imagem e instrução, e deve ser enviado diretamente aos responsáveis (Rohan e Hritik) via e-mail, incluindo informações como nome do modelo, afiliação e, opcionalmente, link para repositório ou artigo.

Exemplos do benchmark

O blog oficial apresenta exemplos ilustrativos onde modelos como GPT-4V acertam ou erram em tarefas específicas, destacando a complexidade do raciocínio necessário. Por exemplo, em alguns casos GPT-4V falhou apesar de raciocínio lógico aparente, enquanto modelos open-source enfrentaram dificuldades em interpretar corretamente a interação entre texto e imagem.