DAIMON Robotics e o avanço do tato em robôs: o maior dataset para IA física multimodal

O desafio da sensibilidade tátil na robótica

Enquanto a visão domina hoje os modelos de inteligência artificial para robôs, a sensibilidade ao toque ainda é uma lacuna crítica para a manipulação precisa de objetos no mundo real. A manipulação robótica tradicionalmente depende do modelo Vision-Language-Action (VLA), que integra visão, linguagem e ação, mas carece da percepção tátil, essencial para tarefas delicadas como dobrar roupas ou manusear objetos frágeis.

DAIMON Robotics e o lançamento do Daimon-Infinity

Em abril de 2024, a empresa DAIMON Robotics, sediada em Hong Kong, lançou o Daimon-Infinity, o maior dataset omni-modal para IA física já criado. Este conjunto de dados reúne informações de alta resolução tátil, aliadas a dados visuais, de movimento e linguagem natural, abrangendo mais de 2.000 habilidades humanas em mais de 80 cenários reais, desde tarefas domésticas até linhas de montagem industriais.

O projeto conta com a colaboração de parceiros renomados, incluindo Google DeepMind, Universidade Northwestern e Universidade Nacional de Cingapura, o que reforça sua relevância acadêmica e tecnológica.

Tecnologia de ponta: sensor tátil monocromático baseado em visão

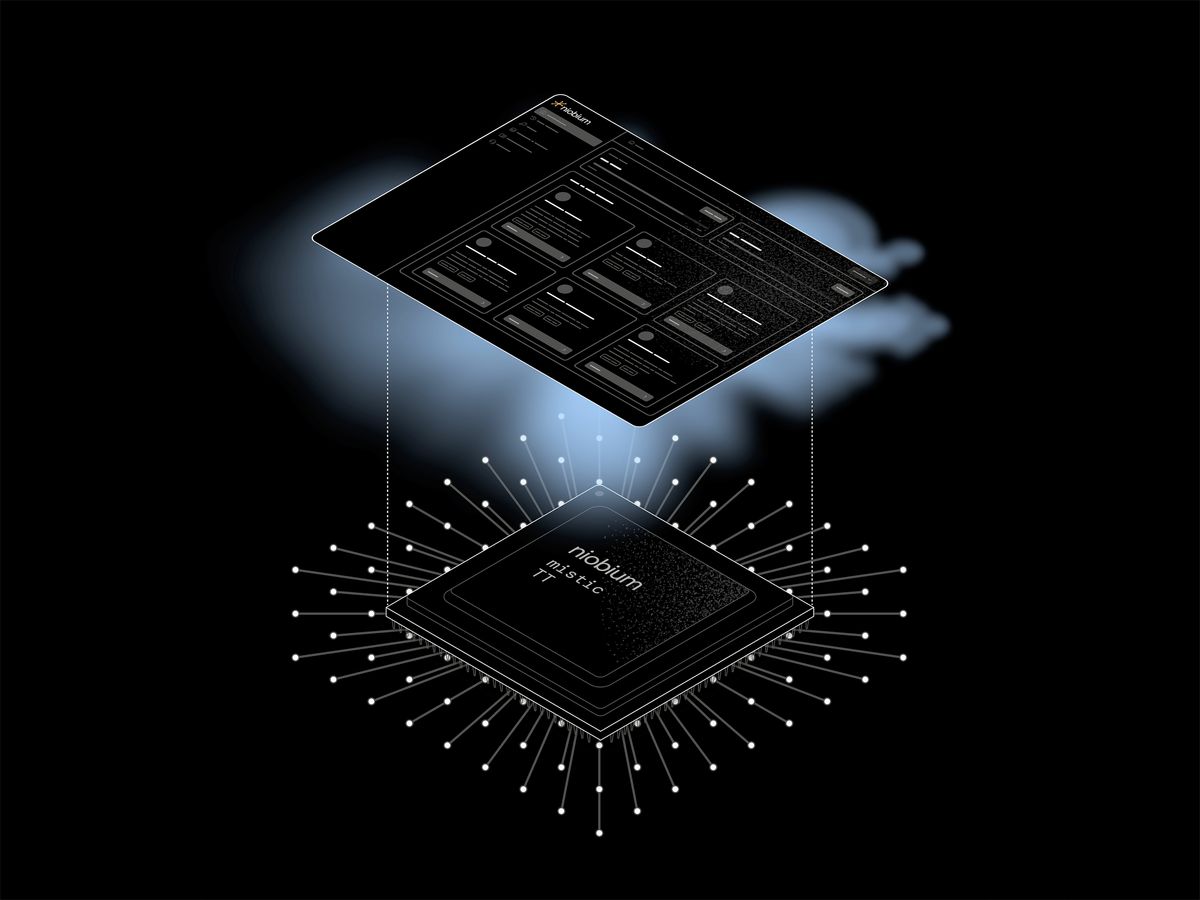

A base do trabalho da DAIMON é sua avançada tecnologia de sensores táteis monocromáticos baseados em visão. Esses sensores, do tamanho de uma ponta de dedo, possuem mais de 110.000 unidades sensoriais eficazes, capazes de captar deformações, deslizamentos, forças, propriedades materiais e texturas da superfície em alta frequência e resolução. Essa abordagem permite uma reconstrução detalhada das interações físicas entre a mão robótica e os objetos manipulados.

Da visão ao toque: o modelo VTLA

O professor Michael Yu Wang, cofundador e cientista-chefe da DAIMON Robotics, propôs a arquitetura Vision-Tactile-Language-Action (VTLA), que eleva o tato a uma modalidade tão importante quanto a visão. Essa integração permite que os robôs recebam feedback tátil em tempo real, fundamental para evitar erros comuns como a queda de objetos frágeis ou falhas em ambientes com baixa iluminação.

O sensor monocromático captura imagens sequenciais da deformação da superfície do sensor, codificando informações táteis que podem ser interpretadas por modelos de aprendizado de máquina, facilitando a incorporação da percepção tátil em arquiteturas já baseadas em visão.

Coleta de dados em escala e abertura para a comunidade

Para superar a escassez de dados físicos, a DAIMON construiu uma rede distribuída de coleta de dados fora do laboratório, capaz de gerar milhões de horas de dados anualmente em ambientes reais. Essa estratégia permite a captura de dados práticos e variados, essenciais para treinar modelos robustos para múltiplos contextos.

Além disso, a empresa liberou publicamente 10.000 horas de seu dataset, fomentando o avanço da comunidade de IA incorporada e a aceleração da implantação de modelos robóticos generalistas no mundo real.

Impactos práticos e setores beneficiados

O aprimoramento da percepção tátil tem potencial transformador em várias indústrias, como manufatura, robótica doméstica e varejo. Por exemplo, robôs equipados com sensores DAIMON podem operar em espaços apertados, como prateleiras densamente ocupadas de lojas de conveniência, manipulando objetos delicados com precisão e segurança.

Essa tecnologia também é vital para a manipulação hábil em linhas de montagem, onde o controle exato da força e o reconhecimento do contato são cruciais para evitar danos e aumentar a eficiência.