Data Poisoning: Uma Nova Forma de Desobediência Civil Contra a IA em Expansão

A rápida expansão da inteligência artificial (IA) generativa tem gerado tanto otimismo quanto preocupações em economias avançadas. Ao mesmo tempo em que promete ganhos de eficiência e produtividade, a tecnologia levanta questões sobre impactos sociais, ambientais e éticos, como o risco de desemprego em massa e a ameaça a setores criativos. Diante desse cenário, cresce o interesse por formas de resistência à IA, incluindo o data poisoning, ou envenenamento de dados, que pode ser visto como uma nova modalidade de desobediência civil.

O que é Data Poisoning e como ele funciona?

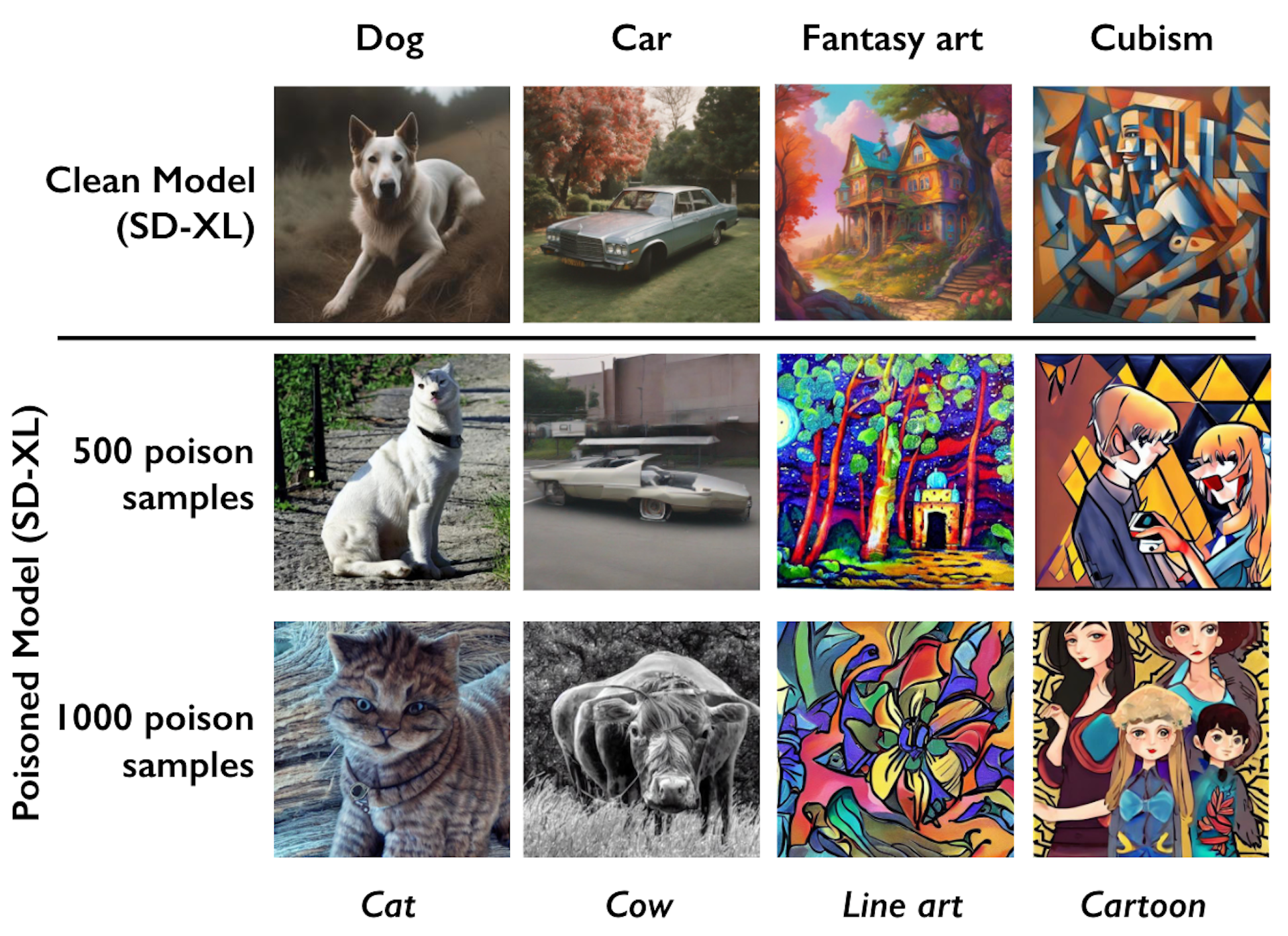

Data poisoning consiste em inserir, de forma intencional, dados enganosos, enviesados ou sem sentido nos conjuntos de dados usados para treinar modelos de IA. O objetivo é degradar a qualidade das respostas geradas pela inteligência artificial, comprometendo a confiabilidade dos sistemas. Estudos indicam que apenas 250 documentos contaminados em um conjunto de dados podem impactar negativamente modelos de qualquer tamanho.

As formas de realizar data poisoning variam em complexidade: algumas exigem conhecimentos técnicos avançados, enquanto outras são acessíveis a qualquer pessoa com acesso à internet, especialmente se seus textos ou imagens forem usados como dados de treinamento. Existem ferramentas desenvolvidas para facilitar essa prática, como:

- Glaze e Nightshade: permitem a criação de imagens visuais contaminadas que não podem ser usadas para treinamento;

- CoProtector: protege repositórios de código aberto contra exploração;

- Silverer: desenvolvido em parceria entre a Monash University e a Polícia Federal Australiana, possibilita que usuários editem imagens pessoais para evitar seu uso em deepfakes.

Além dessas ferramentas, ações simples como criar sites com informações falsas, fazer piadas em fóruns como Reddit, alimentar modelos com suas próprias respostas ou editar artigos da Wikipedia também podem contribuir para o envenenamento dos dados.

Data poisoning como forma de resistência social

Historicamente, a desobediência civil e o sabotagem têm sido estratégias para combater injustiças sociais. Um exemplo clássico é a recusa de Rosa Parks em ceder seu lugar no ônibus, que desencadeou um boicote histórico contra a segregação racial. Trabalhadores também já usaram táticas como pôr sal no açúcar ou quebrar máquinas para diminuir a eficiência e pressionar por direitos.

O data poisoning pode ser compreendido como uma versão moderna dessas ações, direcionada à resistência contra o avanço descontrolado da IA, que ameaça empregos, direitos autorais, privacidade, segurança e a integridade das democracias. No Reino Unido, por exemplo, a IA generativa foi classificada como um “roubo em escala industrial” que põe em risco um setor criativo avaliado em £124,6 bilhões e mais de 2,4 milhões de empregos.

Aspectos legais e éticos do data poisoning

Do ponto de vista jurídico, a responsabilidade pela prevenção e detecção do data poisoning recai principalmente sobre desenvolvedores e organizações, conforme previsto no EU Artificial Intelligence Act. Para usuários individuais, a situação é menos clara, mas leis contra fraude e uso indevido de computadores nos EUA e Reino Unido podem ser aplicadas. Além disso, o ato provavelmente viola os termos de serviço das plataformas de IA.

Entretanto, a discussão ética é mais complexa. Filósofos reconhecem a desobediência civil como uma prática justificável diante de leis ou sistemas que promovem injustiças graves. Se empresas de IA operam com aval estatal e afetam direitos fundamentais como privacidade, segurança no trabalho, educação e proteção social, o data poisoning pode ser interpretado como uma forma legítima de protesto ético.

Segundo o filósofo John Rawls, a desobediência civil é um “dispositivo estabilizador de sistemas constitucionais, embora ilegal por definição”. Se sua intenção for evitar desemprego em massa, preservar eleições e prevenir danos sociais como suicídio, abuso infantil, isolamento e degradação ambiental, o data poisoning pode estar alinhado aos princípios de justiça que sustentam a democracia.

Riscos e desafios práticos do data poisoning

Um problema significativo é que, mesmo que os modelos sejam comprometidos e produzam respostas inconsistentes ou enganosas, os usuários tendem a confiar excessivamente nos sistemas de IA. Isso pode amplificar os danos que o data poisoning pretende combater, pois a desinformação gerada pode se espalhar e influenciar negativamente decisões e opiniões.

Portanto, o data poisoning não é simplesmente um crime cibernético imoral, mas uma estratégia ética complexa para enfrentar injustiças sociais relacionadas à tecnologia. Para que a IA seja desenvolvida em benefício coletivo, é fundamental que seus processos e resultados estejam alinhados aos valores públicos e interesses sociais.