DeepInfra passa a integrar os Inference Providers da Hugging Face: mais opções e economia para desenvolvedores de IA

A Hugging Face anunciou recentemente a integração da DeepInfra como um novo Inference Provider em sua plataforma. Essa novidade amplia o ecossistema de serviços para inferência de modelos de inteligência artificial diretamente nas páginas do Hub, trazendo vantagens práticas para desenvolvedores que buscam soluções eficientes e econômicas.

O que é a DeepInfra e como ela funciona na Hugging Face

A DeepInfra é uma plataforma de inferência de IA serverless que oferece uma das estruturas de preços mais competitivas do mercado, cobrando por token processado. Com um catálogo de mais de 100 modelos, a DeepInfra suporta diversos tipos de modelos, incluindo grandes modelos de linguagem (LLMs), geração de texto para imagem, texto para vídeo, embeddings, entre outros.

Na integração inicial com a Hugging Face, a DeepInfra disponibiliza suporte para tarefas de conversação e geração de texto, permitindo o acesso a modelos de código aberto populares como DeepSeek V4, Kimi-K2.6 e GLM-5.1. Em breve, a plataforma deve ampliar esse suporte para outras tarefas, como geração de imagens e vídeos, além de embeddings.

Como usar a DeepInfra na Hugging Face

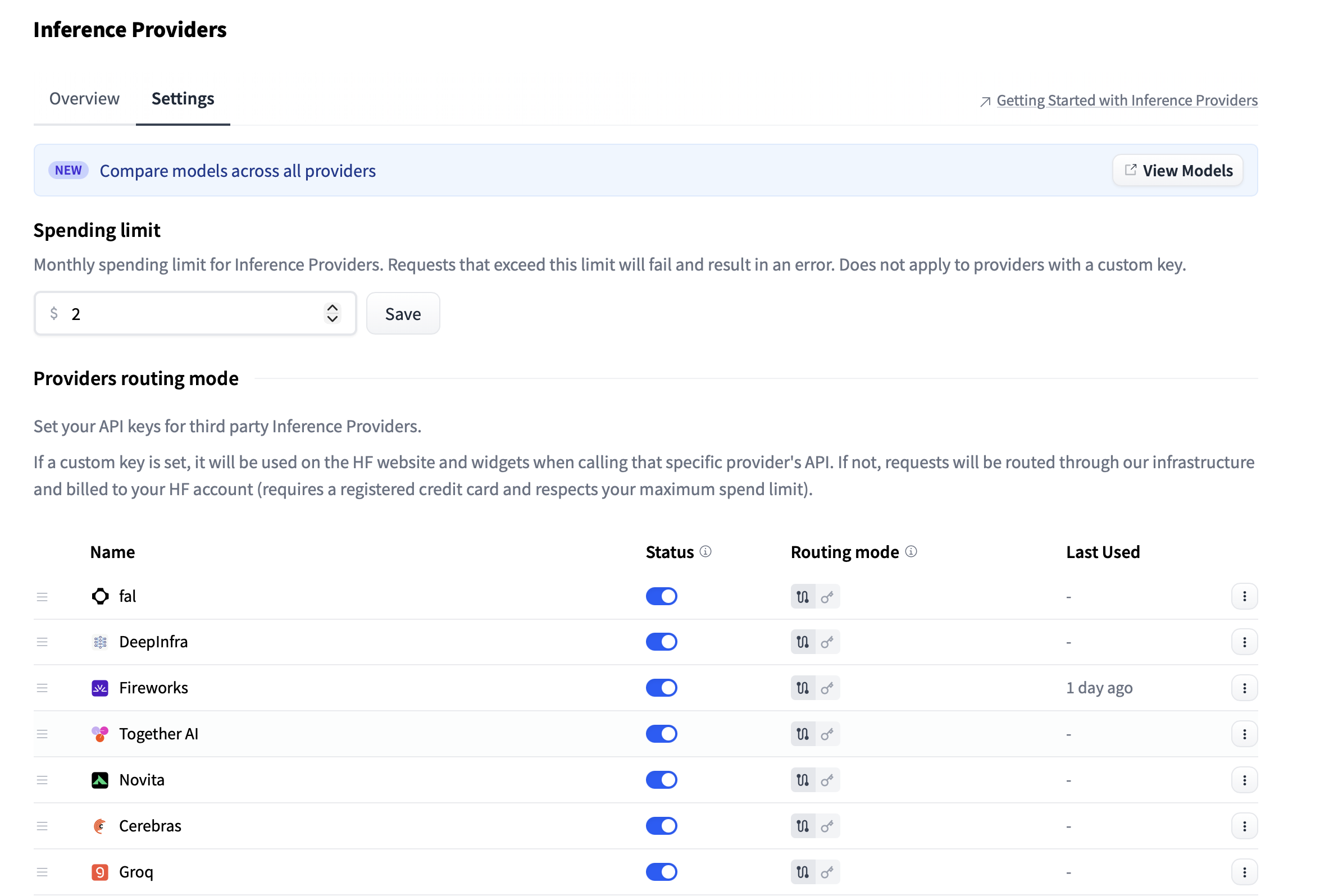

O uso da DeepInfra como provedor de inferência na Hugging Face pode ser feito de forma simples, tanto via interface web quanto por meio dos SDKs para Python e JavaScript disponibilizados pela Hugging Face. Algumas funcionalidades importantes disponíveis no painel de usuário incluem:

- Configurar suas próprias chaves de API dos provedores com os quais você se cadastrou.

- Definir a ordem de preferência dos provedores, o que afeta o widget e os trechos de código nas páginas dos modelos.

Existem dois modos para chamadas aos Inference Providers:

- Chave personalizada: as chamadas são feitas diretamente ao provedor de inferência usando sua própria chave de API.

- Roteado pela Hugging Face: nesse caso, não é necessária uma chave do provedor, e as cobranças são aplicadas diretamente na conta da Hugging Face.

Nas páginas dos modelos, os provedores de terceiros compatíveis são exibidos e ordenados conforme a preferência do usuário, facilitando a escolha do serviço desejado.

Exemplos de uso via SDKs

A DeepInfra pode ser acessada facilmente pelos SDKs da Hugging Face, como huggingface_hub para Python e @huggingface/inference para JavaScript. A seguir, exemplos de chamadas autenticadas que são automaticamente roteadas para a DeepInfra:

from openai import OpenAI

import os

client = OpenAI(

base_url="https://router.huggingface.co/v1",

api_key=os.environ["HF_TOKEN"],

)

completion = client.chat.completions.create(

model="deepseek-ai/DeepSeek-V4-Pro:deepinfra",

messages=[{"role": "user", "content": "Write a Python function that returns the nth Fibonacci number using memoization."}]

)

print(completion.choices[0].message)

import { OpenAI } from "openai";

const client = new OpenAI({

baseURL: "https://router.huggingface.co/v1",

apiKey: process.env.HF_TOKEN,

});

const chatCompletion = await client.chat.completions.create({

model: "deepseek-ai/DeepSeek-V4-Pro:deepinfra",

messages: [

{ role: "user", content: "Write a Python function that returns the nth Fibonacci number using memoization." },

],

});

console.log(chatCompletion.choices[0].message);

Aspectos de cobrança e planos

Ao utilizar uma chave de API direta do provedor, a cobrança é feita pela DeepInfra conforme seu próprio sistema. Já no modo roteado pela Hugging Face, os custos são repassados diretamente ao usuário pela Hugging Face, sem markup adicional. A plataforma também oferece um plano PRO, que inclui créditos mensais de US$ 2 para uso em diversos provedores, além de recursos como ZeroGPU, modo de desenvolvimento para Spaces, limites 20 vezes maiores e outras vantagens.

Usuários gratuitos recebem uma cota pequena de uso para inferência, mas o upgrade para o plano PRO é recomendado para quem precisa de maior capacidade e recursos estendidos.

Feedback e próximos passos

A Hugging Face convida a comunidade a enviar feedback sobre a integração da DeepInfra por meio do espaço de discussões oficial: https://huggingface.co/spaces/huggingface/HuggingDiscussions/discussions/49.