Desvendando Contextos Longos em Modelos de Linguagem com KVPress

Nos últimos anos, os modelos de linguagem de grande porte (LLMs) revolucionaram a forma como interagimos com a inteligência artificial, permitindo desde a geração de textos até a compreensão profunda de contextos complexos. Contudo, um dos maiores desafios ainda enfrentados por esses modelos é o gerenciamento eficiente de contextos longos, especialmente quando o volume de informações ultrapassa a capacidade padrão de processamento.

O desafio dos contextos extensos em LLMs

Modelos como GPT e BERT possuem um limite intrínseco no número de tokens que podem processar simultaneamente. Esse limite, conhecido como janela de contexto, restringe a quantidade de texto que o modelo pode analisar de uma só vez. Quando ultrapassamos esse limite, o modelo pode perder informações importantes, prejudicando a qualidade das respostas e a coerência do texto gerado.

Por que contextos longos são importantes?

- Documentos extensos: Muitas aplicações envolvem textos longos, como artigos científicos, livros e relatórios corporativos.

- Conversas prolongadas: Em assistentes virtuais, manter o histórico completo da interação é crucial para respostas contextuais precisas.

- Memória de longo prazo: Para que a IA aprenda e se adapte a informações previamente fornecidas, é necessário armazenar e recuperar dados de forma eficiente.

Introduzindo o KVPress: uma solução inovadora

Para superar essas limitações, pesquisadores da HuggingFace desenvolveram o KVPress, uma técnica que aprimora a capacidade dos LLMs de lidar com contextos extensos sem comprometer a performance ou a qualidade das respostas.

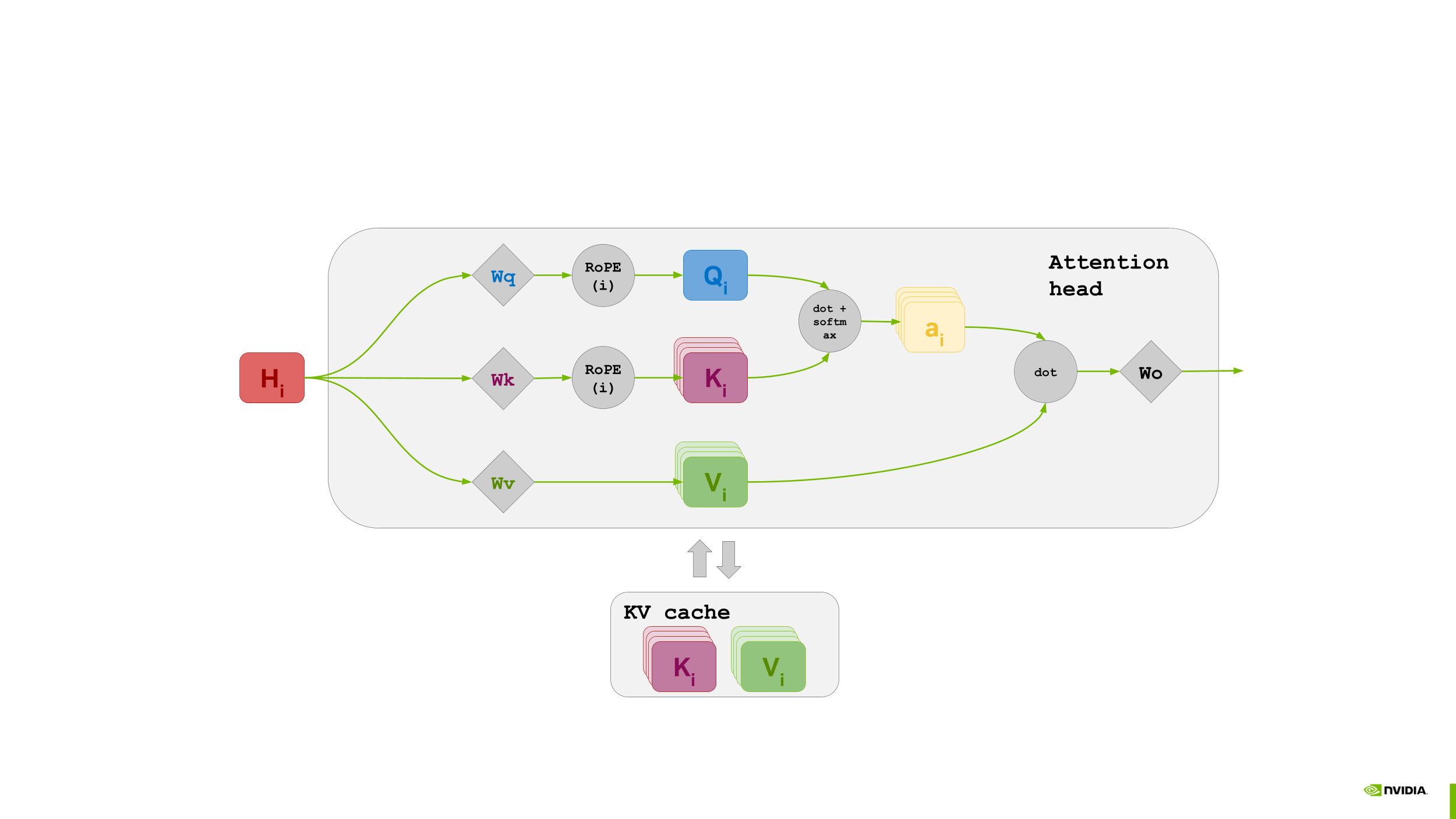

Como o KVPress funciona?

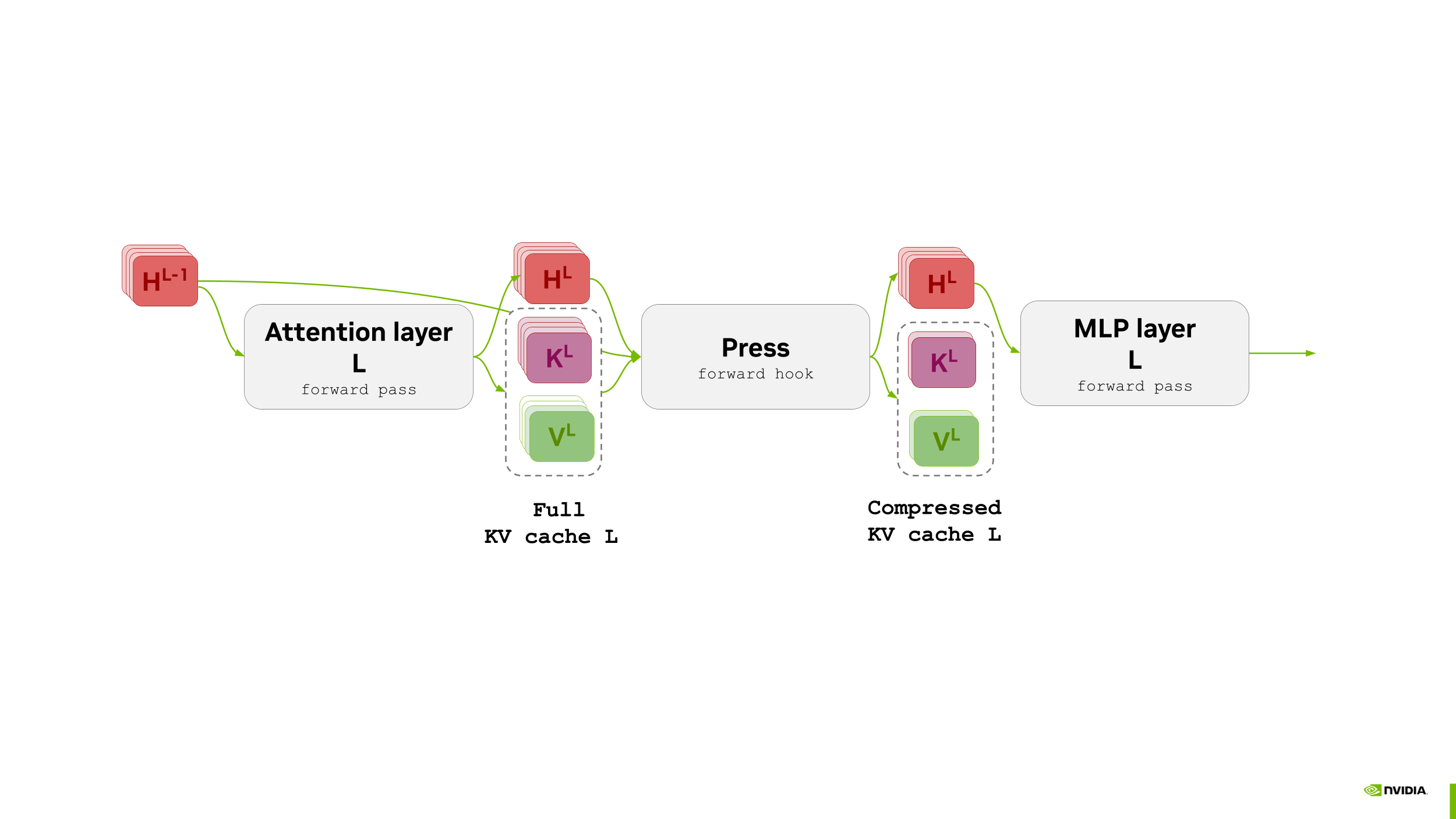

O KVPress atua na forma como as informações são armazenadas e acessadas durante a geração de texto. Em vez de processar todo o contexto de uma vez, ele utiliza uma estrutura de chave-valor (Key-Value) para comprimir e preservar os elementos essenciais do texto anterior. Isso permite que o modelo mantenha uma “memória” eficiente, focando apenas nos dados mais relevantes para a tarefa em questão.

- Compressão seletiva: O KVPress identifica quais partes do contexto são cruciais e as armazena em uma forma condensada.

- Recuperação dinâmica: Durante a geração, o modelo acessa essas informações comprimidas conforme necessário, mantendo a coerência.

- Redução de custo computacional: Ao evitar o processamento redundante de todo o texto, o KVPress melhora a eficiência sem perda de qualidade.

Benefícios práticos do KVPress para aplicações reais

Essa abordagem traz diversas vantagens para desenvolvedores e usuários finais:

- Melhor compreensão de textos longos: Ferramentas de análise de documentos podem processar relatórios extensos com maior precisão.

- Conversas mais naturais: Assistentes virtuais conseguem manter o contexto de diálogos longos, proporcionando interações mais humanas.

- Economia de recursos: A técnica reduz o custo computacional, tornando o uso de LLMs mais acessível para empresas de diferentes portes.

Desafios e perspectivas futuras

Apesar dos avanços, o KVPress ainda está em desenvolvimento e enfrenta desafios como a otimização da compressão sem perda de informações relevantes e a adaptação para diferentes tipos de modelos e tarefas. No entanto, seu potencial para transformar o uso de LLMs em contextos longos é promissor e abre caminho para novas pesquisas e aplicações.

O que esperar nos próximos anos?

- Integração do KVPress em plataformas comerciais e open source.

- Combinação com outras técnicas de memória e atenção para aprimorar ainda mais a performance.

- Aplicações em áreas como educação, saúde e atendimento ao cliente, onde o contexto extenso é fundamental.

Conclusão

O KVPress representa um avanço significativo na capacidade dos modelos de linguagem de grande porte de lidar com contextos longos, superando limitações técnicas que até então restringiam seu potencial. Com essa inovação, o futuro da inteligência artificial se mostra ainda mais promissor, possibilitando interações mais ricas, precisas e eficientes em diversas áreas.

Fique atento às novidades do IA em Foco para acompanhar as tendências e inovações que estão moldando o universo da inteligência artificial!