Estudo revela que a maioria das pessoas não percebe quando mensagens pessoais são escritas por IA e penaliza quem admite o uso

Uma pesquisa conduzida pela Universidade de Michigan revelou que a maior parte das pessoas não consegue identificar quando uma mensagem pessoal que recebem foi gerada por inteligência artificial (IA). Além disso, quando informadas sobre a autoria artificial do texto, tendem a julgar negativamente o remetente, associando a mensagem a características como preguiça e falta de sinceridade.

O problema investigado

Com o avanço das ferramentas de IA generativa, como o ChatGPT, cresce o uso de textos produzidos artificialmente na comunicação cotidiana. A pesquisa buscou entender como as pessoas percebem mensagens pessoais, especialmente em contextos delicados como pedidos de desculpas, quando sabem ou não que o texto foi escrito por uma IA.

Metodologia da pesquisa

Mais de 1.300 participantes dos Estados Unidos, com idades entre 18 e 84 anos, foram divididos em quatro grupos para avaliar mensagens geradas por IA:

- Grupo 1: recebeu as mensagens sem nenhuma informação sobre o autor;

- Grupo 2: informado de que a mensagem foi escrita por um humano;

- Grupo 3: informado de que a mensagem foi gerada por IA;

- Grupo 4: informado de que a mensagem poderia ter sido escrita tanto por humano quanto por IA.

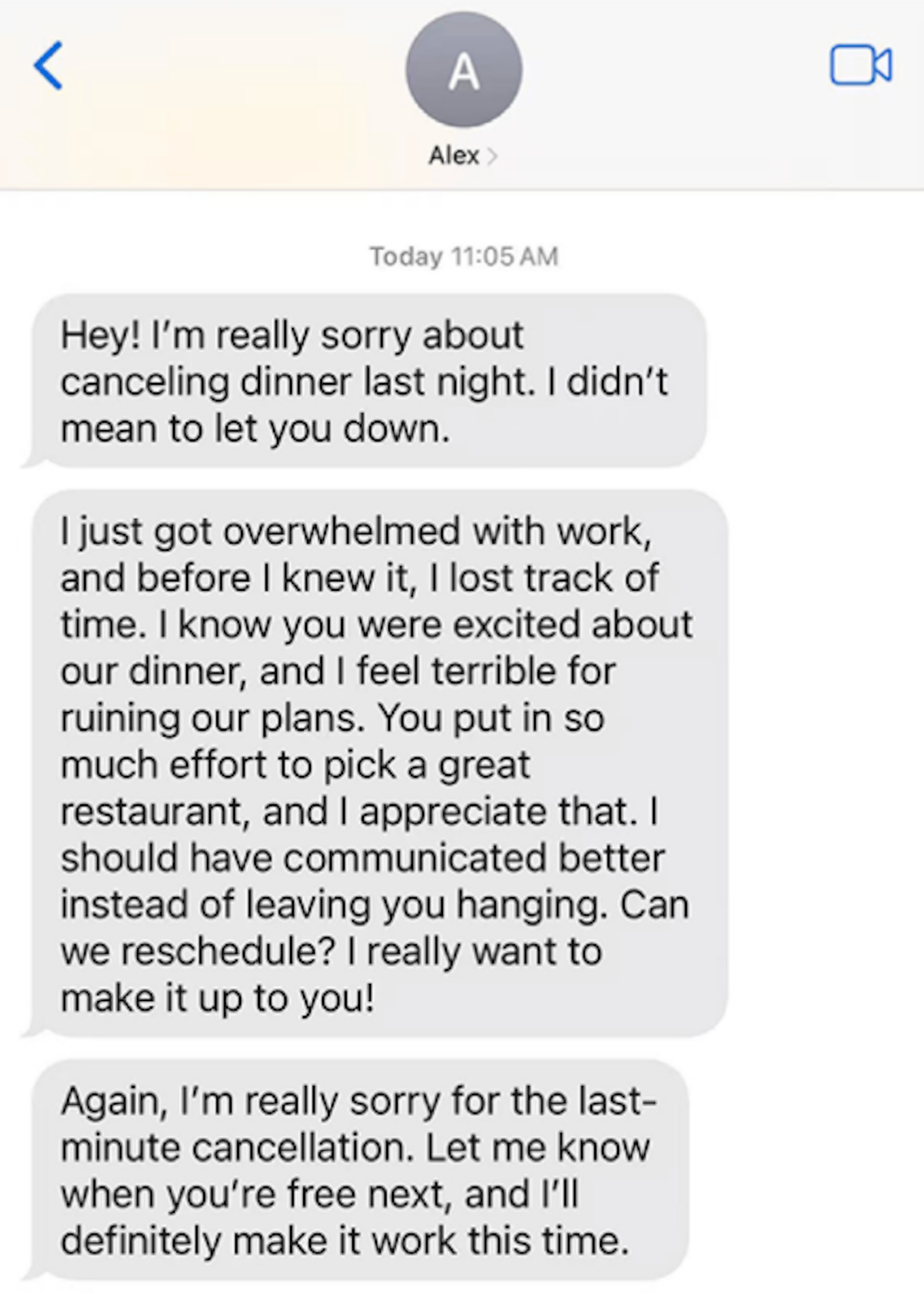

Os textos avaliados incluíam, por exemplo, um pedido de desculpas fictício enviado por mensagem de texto.

Principais resultados

- Falta de suspeita natural: quando não informados sobre a autoria, os participantes não demonstraram ceticismo e julgaram as mensagens tão positivamente quanto aqueles que acreditavam terem sido escritas por humanos.

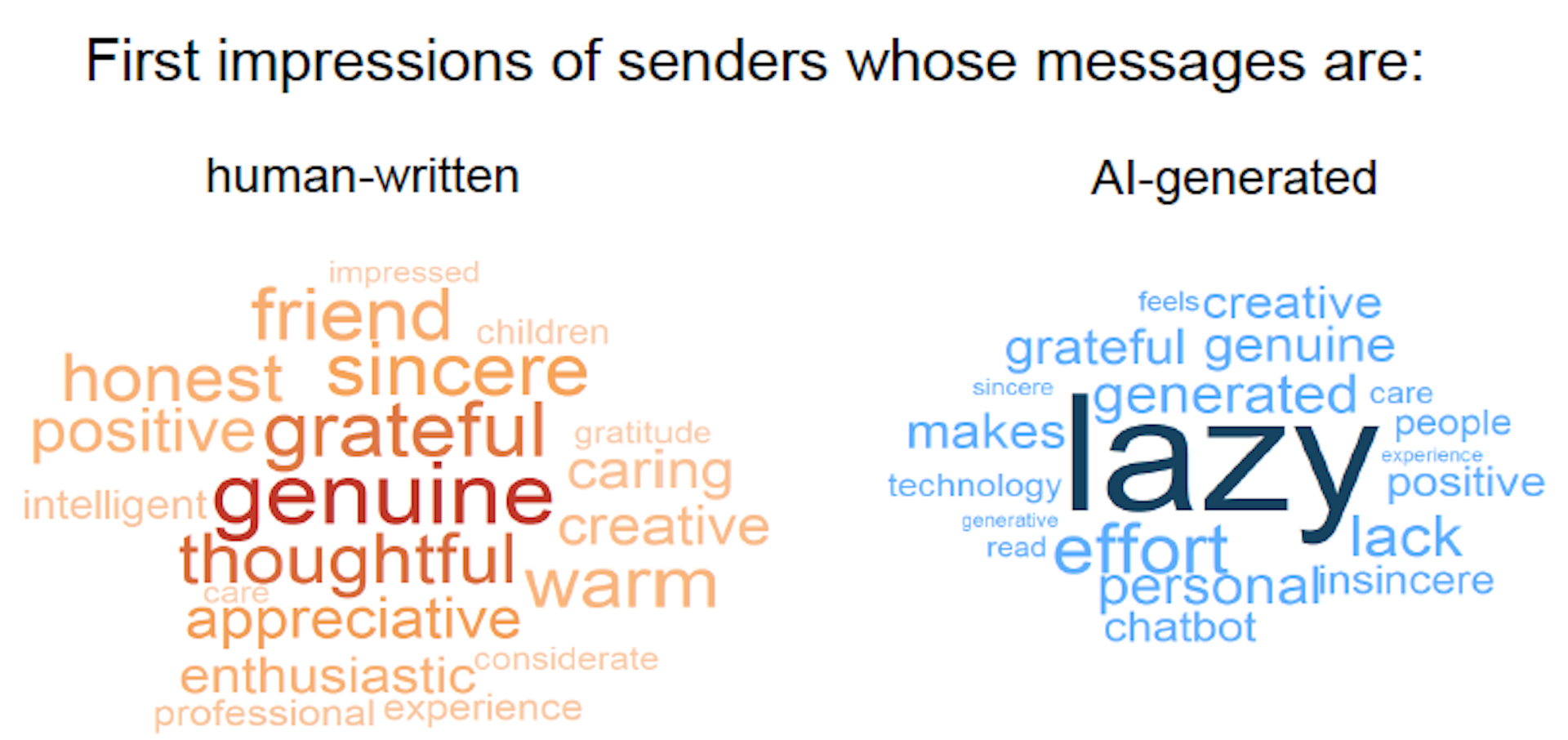

- Penalidade por divulgação da IA: ao saber que a mensagem era gerada por IA, os participantes avaliaram o remetente com termos negativos como "preguiçoso", "insincero" e "falta de esforço".

- Uso pessoal de IA pouco influencia: mesmo os participantes que usam IA frequentemente em suas vidas diárias não demonstraram maior suspeita sobre a autoria quando esta não era revelada, embora penalizassem um pouco menos a divulgação da IA.

Limitações e questões em aberto

Os pesquisadores destacam que a ausência de suspeita pode decorrer do desconhecimento do público sobre a capacidade atual das IAs em gerar textos detalhados e pessoais, ou da familiaridade limitada com o uso dessas ferramentas. Além disso, o estudo não abrange contextos específicos onde a vigilância contra o uso de IA pode ser maior, como na academia.

Implicações práticas e sociais

Esses resultados expõem um dilema moral contemporâneo: pessoas que utilizam IA para escrever mensagens pessoais em segredo podem se beneficiar do suporte da tecnologia sem sofrer prejuízo social, enquanto aquelas que admitem o uso enfrentam impacto negativo em sua reputação. Isso pode levar a uma mudança na forma como a escrita é valorizada nas relações interpessoais e profissionais, com uma possível diminuição da confiança na autenticidade dos textos escritos.

Por exemplo, empregadores já estão reduzindo a importância de cartas de apresentação, confiando mais em recomendações pessoais e networking presencial.

Pesquisas relacionadas e próximas etapas

Outros estudos indicam que a divulgação do uso de IA pode prejudicar a percepção de criatividade, autenticidade e competência de indivíduos, além de diminuir a confiança em mensagens e pedidos de desculpas corporativos. Mesmo com ferramentas de detecção, identificar textos gerados por IA permanece um desafio.

Os autores pretendem investigar em futuros estudos os contextos e gatilhos que levam as pessoas a suspeitar naturalmente do uso de IA, buscando compreender melhor a transição entre confiança e dúvida na comunicação mediada por texto.

Recomendações para comunicação pessoal

Enquanto a percepção pública sobre mensagens geradas por IA não se estabiliza, a pesquisa sugere que, para transmitir sinceridade em mensagens pessoais, as formas tradicionais de comunicação — como ligações telefônicas, mensagens de voz ou encontros presenciais — ainda são as mais eficazes.