Google Cloud lança nova geração de chips TPU para acelerar IA e competir com Nvidia

Google apresenta chips TPU de 8ª geração para treinamento e inferência de IA

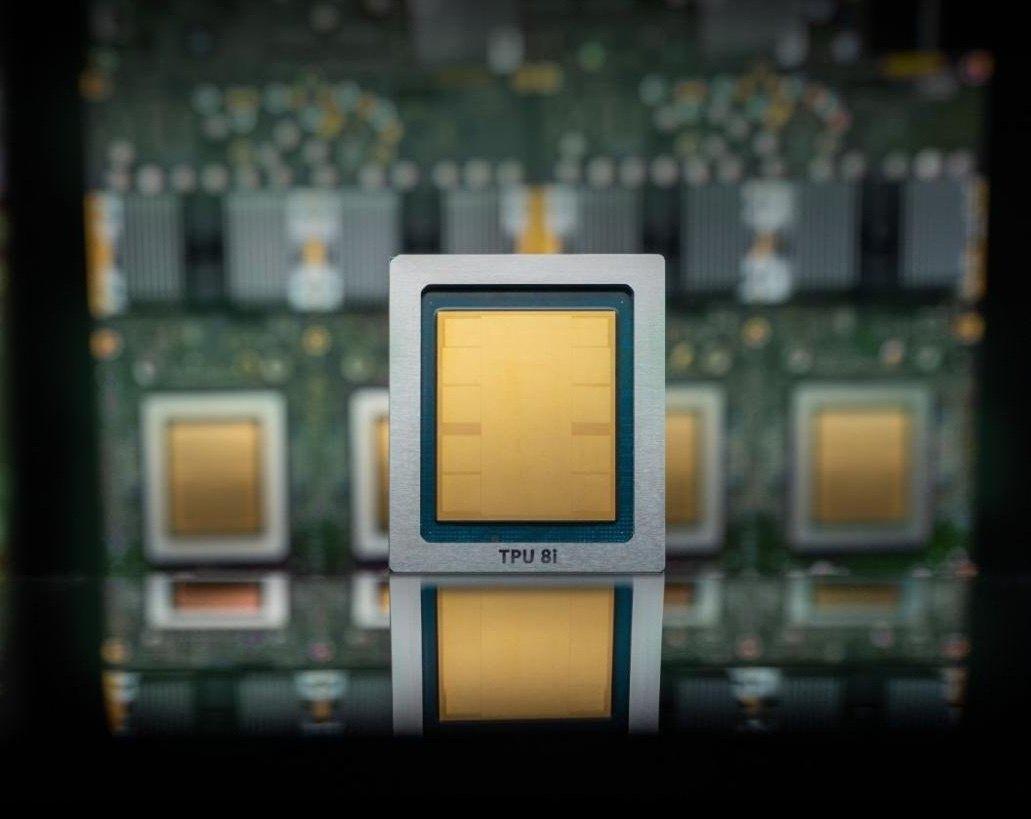

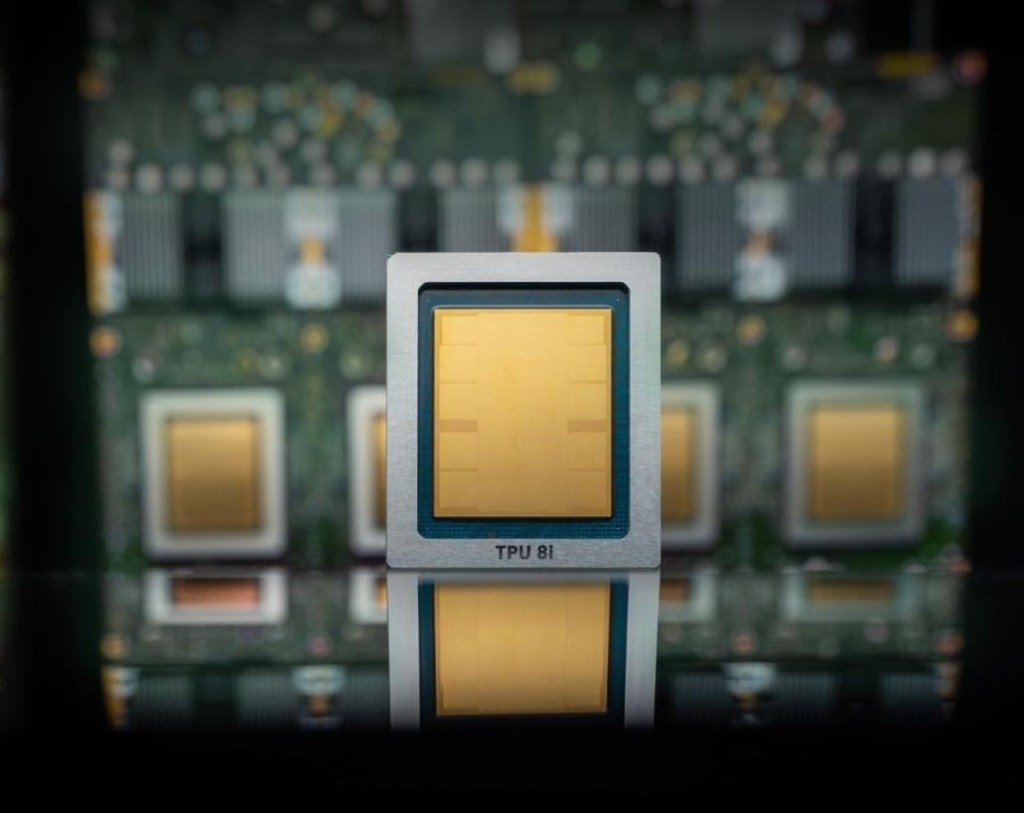

Durante o evento Google Cloud Next 2026, a Google anunciou o lançamento da oitava geração de seus chips personalizados para inteligência artificial, conhecidos como Tensor Processing Units (TPUs). A novidade é que esta geração será dividida em dois modelos distintos: o TPU 8t, focado no treinamento de modelos de IA, e o TPU 8i, voltado para a inferência, ou seja, a execução contínua dos modelos após o treinamento.

Desempenho aprimorado e custo reduzido

Segundo a Google, os novos chips oferecem avanços significativos em relação às versões anteriores. A empresa destaca que o treinamento de modelos de IA pode ser até 3 vezes mais rápido e o desempenho por dólar investido melhora em 80%. Outro destaque é a capacidade de escalar para clusters com mais de 1 milhão de TPUs trabalhando em conjunto, o que permite um aumento expressivo de poder computacional.

Esses ganhos se traduzem em maior eficiência energética e redução nos custos para os clientes que utilizam a infraestrutura da Google Cloud.

Quem pode usar e como acessar os novos TPUs

Os novos chips TPU 8t e TPU 8i estarão disponíveis para clientes da Google Cloud, especialmente empresas e desenvolvedores que demandam alta performance para aplicações de inteligência artificial, desde pesquisa e desenvolvimento até produção em larga escala.

Para acessar os novos TPUs, as organizações devem utilizar a plataforma Google Cloud, que continuará integrando também as soluções baseadas em GPUs da Nvidia, garantindo flexibilidade para diferentes tipos de workloads.

Google mantém parceria estratégica com Nvidia

Apesar do lançamento dos seus próprios chips, a Google não pretende substituir imediatamente a Nvidia em sua oferta de infraestrutura. A empresa confirmou que continuará disponibilizando os chips mais recentes da Nvidia, como o Vera Rubin, ainda em 2026.

Além disso, Google e Nvidia estão colaborando para aprimorar a tecnologia de rede baseada em software chamada Falcon, criada pela Google e open source desde 2023. Essa parceria visa melhorar a eficiência dos sistemas Nvidia dentro da nuvem Google, beneficiando clientes que utilizam ambas as tecnologias.

Impacto prático para o mercado de IA

Esse movimento da Google reforça a tendência dos grandes provedores de nuvem — Microsoft, Amazon e Google — em desenvolver chips personalizados para IA, buscando otimizar custos e desempenho para seus clientes empresariais.

Embora a competição com Nvidia seja clara, a gigante das buscas reconhece o papel estratégico do parceiro no mercado de hardware para IA, mantendo uma coexistência que beneficia o ecossistema de inteligência artificial na nuvem.