Groq e Hugging Face: Revolucionando a Inferência em IA com Alta Performance

Nos últimos anos, a inteligência artificial (IA) tem avançado rapidamente, impulsionando inovações em diversas áreas, desde processamento de linguagem natural até visão computacional. Para que esses modelos complexos funcionem de maneira eficiente, é fundamental contar com infraestruturas de inferência robustas e otimizadas. É nesse cenário que a parceria entre Groq e Hugging Face surge como uma solução inovadora, capaz de transformar a forma como executamos modelos de IA em produção.

Quem é a Groq e qual seu papel na inferência de IA?

A Groq é uma empresa que desenvolve hardware especializado para acelerar o processamento de inteligência artificial. Seu foco está em oferecer soluções de inferência ultra rápidas e de baixa latência, permitindo que modelos complexos sejam executados com máxima eficiência. Diferente de arquiteturas tradicionais, a Groq utiliza uma abordagem baseada em processadores tensoriais customizados, otimizados para cargas de trabalho de IA.

Por que a inferência é tão importante?

Enquanto o treinamento de modelos de IA requer grande poder computacional e é realizado com menos frequência, a inferência — ou seja, o uso do modelo treinado para fazer previsões — acontece em tempo real e em larga escala. Portanto, a velocidade e a eficiência da inferência impactam diretamente na experiência do usuário e nos custos operacionais das empresas.

Hugging Face: democratizando o acesso a modelos de IA

Hugging Face é uma plataforma líder no ecossistema de IA, conhecida por seu repositório de modelos pré-treinados e ferramentas que facilitam a implementação de soluções de linguagem natural e outras aplicações. Com sua infraestrutura de inferência, a Hugging Face permite que desenvolvedores e empresas acessem modelos avançados sem a necessidade de investir em hardware próprio.

O que a integração com Groq significa?

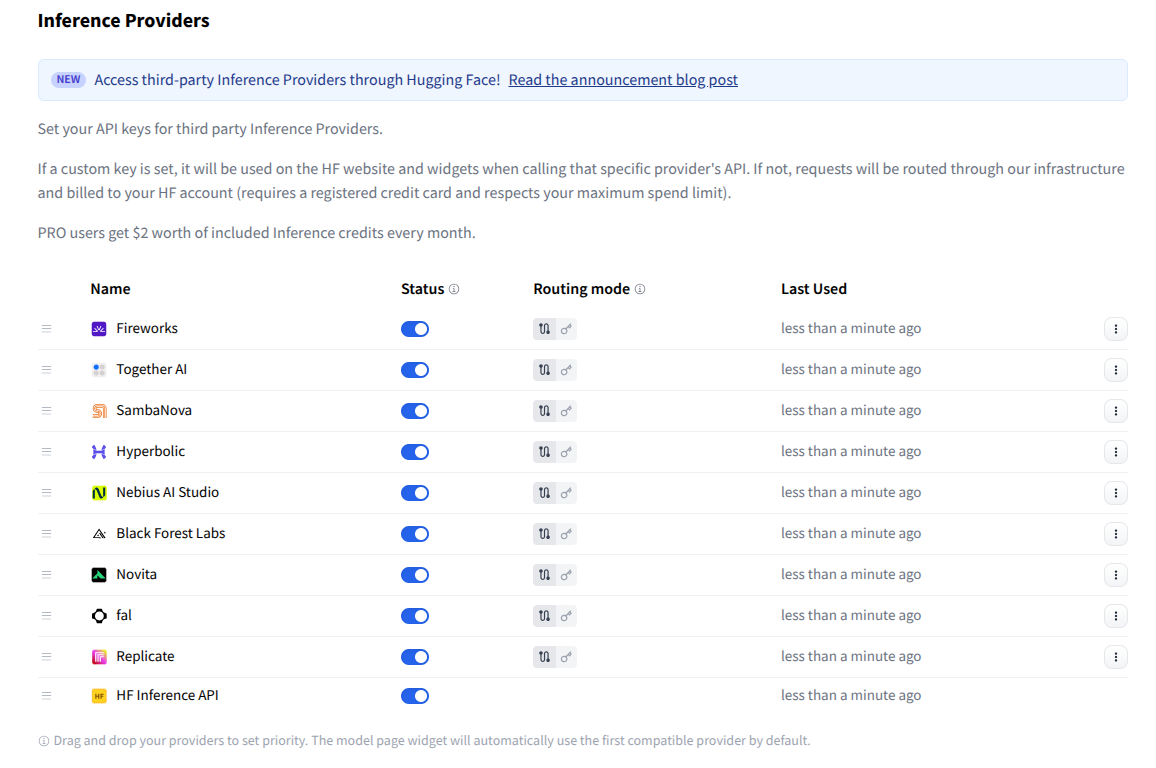

A recente integração da Groq como um dos provedores de inferência na Hugging Face representa um avanço significativo. Isso significa que os usuários da plataforma podem agora executar seus modelos em hardware Groq, aproveitando a alta performance e baixa latência oferecidas pela tecnologia. Essa parceria amplia as opções para desenvolvedores, que podem escolher a infraestrutura que melhor atende às suas necessidades.

Benefícios da parceria Groq-Hugging Face

- Velocidade de inferência: A arquitetura da Groq permite processar grandes volumes de dados rapidamente, acelerando a resposta dos modelos.

- Escalabilidade: Ideal para aplicações que demandam alta taxa de requisições simultâneas, como chatbots e sistemas de recomendação.

- Redução de custos: Com maior eficiência, é possível diminuir o consumo energético e o custo por inferência.

- Facilidade de uso: A integração direta na Hugging Face simplifica o acesso ao hardware Groq, sem necessidade de configurações complexas.

- Suporte a múltiplos modelos: Compatibilidade com diversos modelos populares, incluindo transformers e outras arquiteturas de ponta.

Casos de uso práticos

Imagine uma empresa que utiliza um assistente virtual para atendimento ao cliente. Com a combinação Groq-Hugging Face, esse assistente pode responder em tempo real, mesmo durante picos de acesso, garantindo uma experiência fluida e satisfatória. Outro exemplo é em sistemas de análise de imagens médicas, onde a rapidez na inferência pode acelerar diagnósticos e salvar vidas.

Como começar a usar Groq na Hugging Face?

Para desenvolvedores interessados, a Hugging Face oferece documentação detalhada e APIs que facilitam a escolha do provedor de inferência Groq. Basta selecionar essa opção ao configurar o endpoint de inferência, e o sistema cuidará do resto, garantindo que as requisições sejam processadas no hardware Groq.

Conclusão

A parceria entre Groq e Hugging Face representa um marco na evolução da infraestrutura de IA. Ao combinar o poder do hardware especializado da Groq com a acessibilidade e versatilidade da plataforma Hugging Face, desenvolvedores e empresas ganham uma ferramenta poderosa para acelerar suas aplicações de IA. Essa integração não só melhora a performance e reduz custos, mas também abre novas possibilidades para a inovação em inteligência artificial.

Se você busca levar seus projetos de IA para o próximo nível, explorar o provedor de inferência Groq na Hugging Face é um passo essencial para garantir alta performance e escalabilidade.