Hardware Inovador Transforma Zeros em Aliados para IA Mais Rápida e Eficiente

O desafio dos modelos de IA em larga escala

Os modelos de inteligência artificial (IA) têm crescido rapidamente em tamanho e complexidade. O recente lançamento do Llama 4 da Meta, com impressionantes 2 trilhões de parâmetros, exemplifica essa tendência. Embora o aumento no número de parâmetros potencialize as capacidades dos modelos, ele também eleva significativamente o consumo de energia e o tempo necessário para executar as inferências, ampliando a pegada de carbono dessas tecnologias.

Sparsidade: a oportunidade escondida nos zeros

Uma característica comum dos grandes modelos de IA é a presença de numerosos parâmetros — pesos e ativações — que são zero ou tão próximos disso que podem ser tratados como zero sem perda de precisão. Essa propriedade é conhecida como sparsidade. Aproveitar a sparsidade significa evitar cálculos desnecessários envolvendo zeros, reduzindo o tempo de processamento e o consumo energético, além de otimizar o armazenamento ao salvar apenas os valores não nulos.

Limitações do hardware atual para computação esparsa

Embora a sparsidade ofereça benefícios claros, o hardware popular atual, como CPUs multicore e GPUs, não está otimizado para explorá-la plenamente. CPUs são flexíveis, mas enfrentam gargalos com acessos indiretos e aleatórios à memória, enquanto GPUs só suportam eficientemente uma sparsidade estruturada específica, deixando de lado a sparsidade não estruturada, que é mais comum e vantajosa para muitos modelos. Além disso, o suporte de bibliotecas como cuSparse para sparsidade não é suficiente para maximizar o desempenho e a eficiência energética.

Onyx: um acelerador de hardware dedicado à sparsidade

Para superar essas limitações, pesquisadores da Universidade de Stanford desenvolveram o Onyx, o primeiro hardware programável capaz de acelerar eficientemente cargas de trabalho esparsas e densas. O Onyx é baseado em uma arquitetura de coarse-grained reconfigurable array (CGRA), que combina a flexibilidade dos FPGAs com a eficiência dos CPUs.

Esse acelerador foi projetado do zero, incluindo hardware, firmware de baixo nível e software, para aproveitar a sparsidade sem comprometer a capacidade de processamento. Em testes, o chip consumiu em média 1/70 da energia de uma CPU convencional e executou as operações em média oito vezes mais rápido, mostrando um potencial significativo para tornar a IA mais sustentável e acessível.

Como funciona a compressão e o cálculo esparso

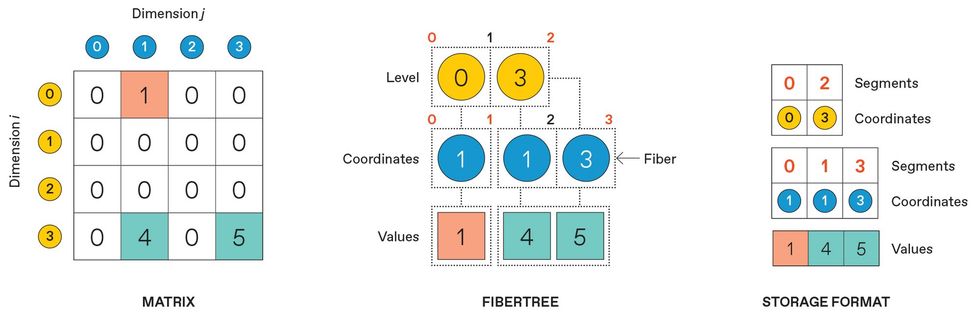

Modelos de IA representam dados e pesos em vetores, matrizes ou tensores. Quando mais de 50% dos elementos são zeros, é vantajoso usar representações esparsas, que armazenam apenas os valores não nulos e suas posições, reduzindo o uso de memória e o tráfego de dados.

Por exemplo, uma matriz 4x4 com três valores não nulos pode ser armazenada de forma compacta usando uma estrutura chamada fibertree, que mantém as coordenadas das linhas e colunas com valores relevantes. Nos cálculos, multiplicações ou somas envolvendo zero podem ser ignoradas, acelerando a execução e economizando energia.

Comparação com outras soluções e limitações atuais

Outras iniciativas, como o Wafer Scale Engine da Cerebras e o Training and Inference Accelerator (MTIA) da Meta, também exploram a sparsidade. Contudo, o Wafer Scale Engine suporta apenas sparsidade nos pesos, não nas ativações, enquanto o MTIA v2 divulga ganhos apenas para multiplicação de matrizes, deixando de lado operações com vetores e tensores essenciais para muitos modelos.

Já o Onyx se destaca por suportar tanto sparsidade estruturada quanto não estruturada e acelerar uma gama mais ampla de operações, evitando a necessidade de alternar entre formatos esparsos e densos, o que pode prejudicar a eficiência.

Impactos práticos e futuros da computação esparsa

A adoção de hardware como o Onyx pode revolucionar a forma como modelos de IA são treinados e executados, reduzindo custos energéticos e acelerando processos sem sacrificar a qualidade dos resultados. Isso é fundamental diante do crescimento exponencial dos modelos e da necessidade de sustentabilidade ambiental.

Além disso, a pesquisa incentiva um repensar completo das pilhas de design de hardware e software para IA, promovendo inovações que podem beneficiar desde data centers até aplicações em dispositivos de borda.