Holotron-12B: Novo modelo multimodal da H Company otimiza uso computacional com alta eficiência

A H Company lançou o Holotron-12B, um modelo multimodal voltado para agentes de uso computacional, que alia alta escalabilidade e desempenho em produção. Desenvolvido a partir do modelo aberto NVIDIA Nemotron-Nano-2 VL, o Holotron-12B foi pós-treinado com uma mistura proprietária de dados da H Company e está disponível na plataforma Hugging Face.

Objetivo e inovação do Holotron-12B

Diferentemente da maioria dos modelos multimodais atuais, que focam em visão estática ou em seguir instruções, o Holotron-12B tem como principal função atuar como modelo de política para agentes que precisam perceber, decidir e agir em ambientes interativos. A ideia é que ele lide eficientemente com contextos longos contendo múltiplas imagens e ainda mantenha alta performance em benchmarks para agentes.

Arquitetura híbrida SSM para alta eficiência de inferência

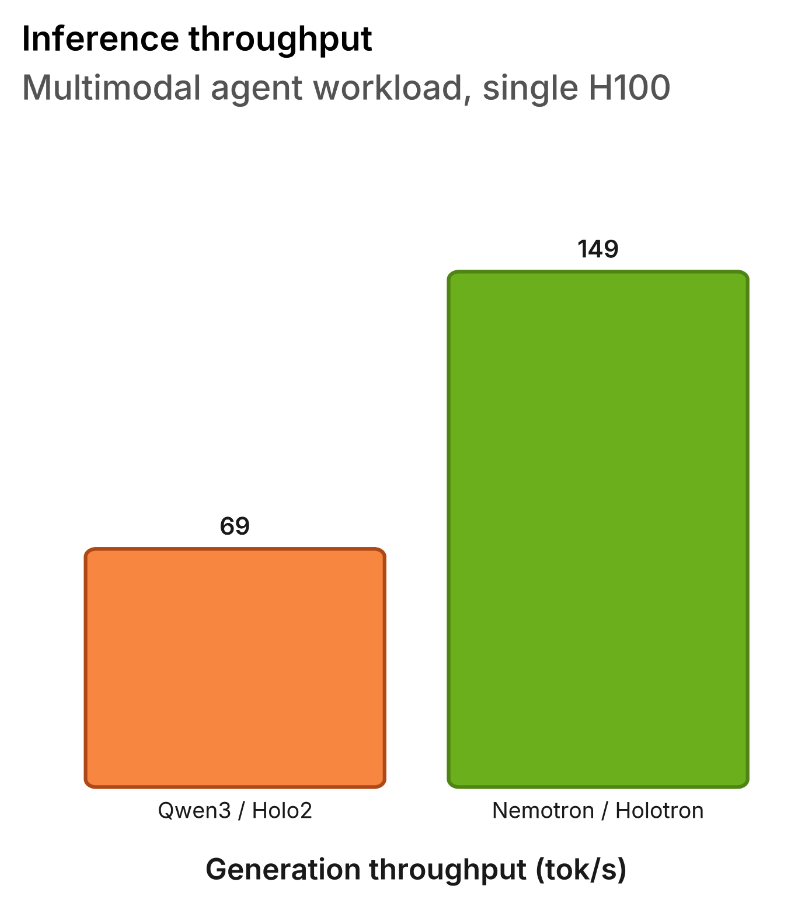

O avanço no throughput de inferência do Holotron-12B é resultado da arquitetura Nemotron, que combina um modelo de espaço de estado (State-Space Model - SSM) com mecanismos de atenção. Essa arquitetura híbrida supera os modelos baseados exclusivamente em transformers ao otimizar o uso de memória e processamento para contextos longos.

O SSM reduz significativamente o consumo de memória durante a inferência, armazenando apenas um estado constante por camada e sequência gerada, diferente do cache KV dos transformers que cresce com o número de tokens. Isso possibilita maior escalabilidade e eficiência, especialmente em cargas de trabalho multimodais com múltiplas imagens e históricos extensos.

Em testes com o benchmark WebVoyager, que simula um ambiente multimodal real com alta concorrência, o Holotron-12B alcançou um throughput mais que duas vezes superior ao modelo Holo2-8B, rodando em uma GPU H100 e utilizando a versão 0.14.1 do vLLM com otimizações SSM.

Além disso, o Holotron-12B manteve aumento constante do throughput conforme a concorrência subia até 100 workers, atingindo 8.900 tokens por segundo, enquanto o Holo2-8B estabilizou em 5.100 tokens por segundo. Isso demonstra melhor aproveitamento da VRAM e da memória, permitindo lotes maiores e maior eficiência computacional.

Processo de treinamento e avaliação

O treinamento do Holotron-12B ocorreu em duas fases. Partiu-se do modelo base multimodal Nemotron-Nano-12B-v2-VL-BF16 da NVIDIA, seguido de fine-tuning supervisionado com dados proprietários da H Company focados em localização, navegação, entendimento de telas, grounding e interações em nível de interface.

O checkpoint final foi treinado com cerca de 14 bilhões de tokens, garantindo robustez para tarefas de agentes computacionais.

Desempenho em benchmarks de agentes e localização

Nos benchmarks de uso computacional e navegação, o Holotron-12B superou o modelo base Nemotron, alcançando 80,5% de desempenho no WebVoyager, contra 35,1% do Nemotron original e superando o Holo2-8B. Isso evidencia sua efetividade em cenários que exigem percepção e ação integradas.

Também houve ganhos expressivos em benchmarks de localização e grounding, como OS-World-G, GroundUI e WebClick, reforçando sua capacidade de compreender e interagir com interfaces complexas.

Perspectivas e próximos passos

O Holotron-12B prova que a arquitetura Nemotron é uma base sólida para agentes multimodais reais, combinando desempenho e eficiência. A H Company planeja expandir essa linha com o Nemotron 3 Omni, que promete avanços em raciocínio e precisão multimodal, atendendo a demandas comerciais de alta escala para agentes autônomos.

Disponibilidade e acesso

O Holotron-12B está disponível para a comunidade na Hugging Face sob a NVIDIA Open Model License. Interessados podem acessar o modelo, checkpoints e documentação para explorar suas aplicações.