Modelos Compactos, Resultados Gigantes: Como a Decomposição Revoluciona a Extração de Intenções na IA

A inteligência artificial (IA) tem avançado rapidamente, especialmente no campo do processamento de linguagem natural (PLN). Um dos desafios mais complexos é a extração precisa de intenções a partir de comandos ou consultas feitas por usuários. Recentemente, pesquisadores do Google Research apresentaram uma abordagem inovadora que utiliza modelos pequenos aliados à técnica de decomposição para alcançar resultados superiores na extração de intenções. Neste artigo, vamos explorar essa metodologia, seus benefícios e o impacto que pode ter no futuro da IA.

Introdução à Extração de Intenções na IA

A extração de intenções é uma tarefa fundamental para sistemas de IA que interagem com humanos, como assistentes virtuais, chatbots e sistemas de busca. Trata-se de identificar o propósito ou objetivo por trás da mensagem do usuário, o que permite que a máquina responda de forma adequada e eficiente.

Tradicionalmente, modelos grandes e complexos, como grandes redes neurais, têm sido usados para essa tarefa, exigindo grande capacidade computacional e altos custos de treinamento e operação. Porém, o Google Research propõe que modelos menores, quando combinados com técnicas inteligentes, podem superar esses grandes modelos em desempenho.

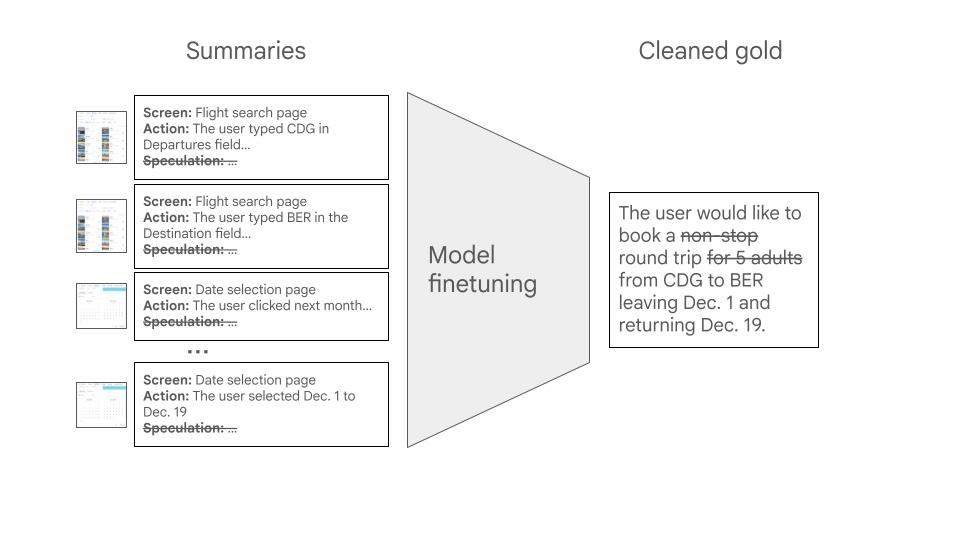

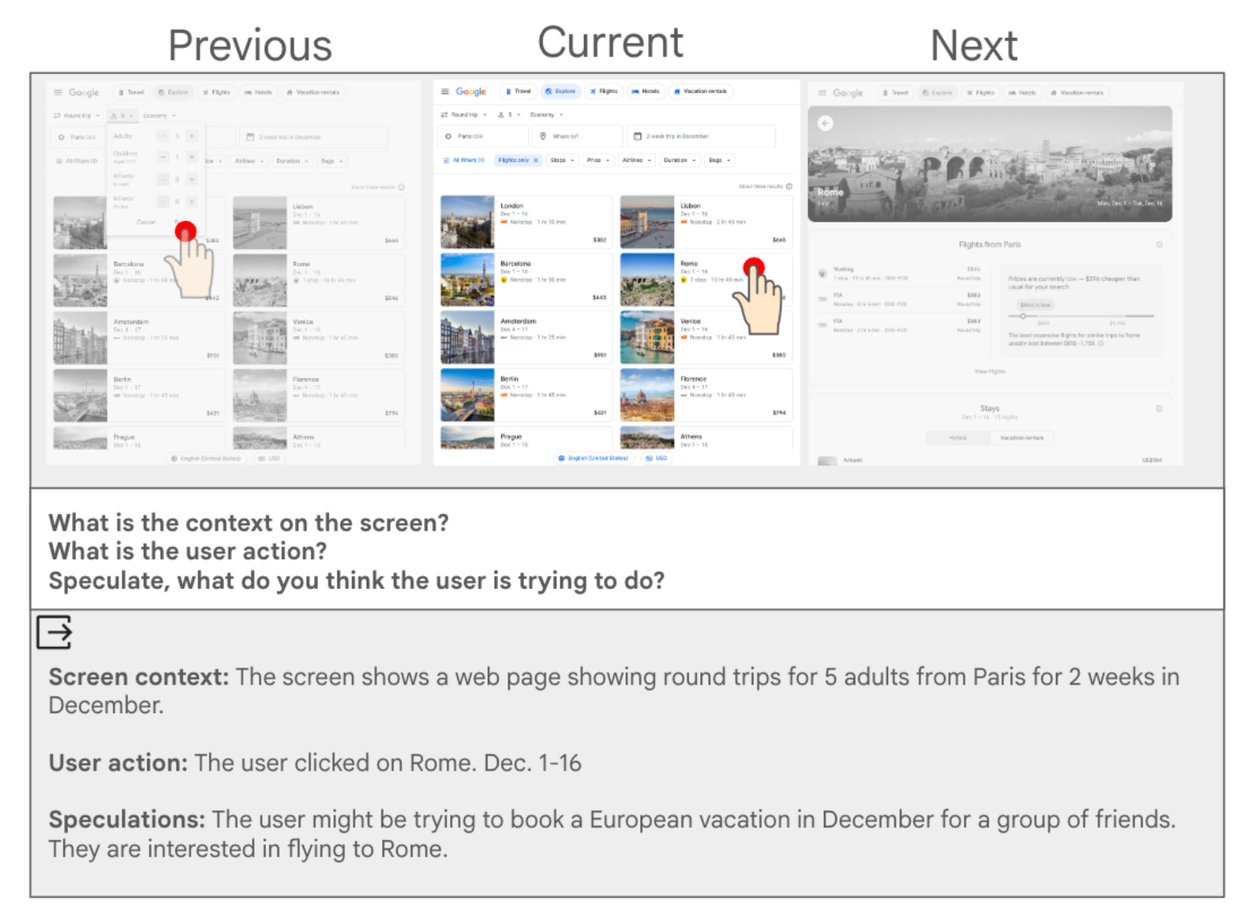

O Que é Decomposição na Extração de Intenções?

A decomposição consiste em dividir uma tarefa complexa em partes menores e mais gerenciáveis. No contexto da extração de intenções, isso significa quebrar a análise da mensagem do usuário em sub-tarefas específicas, como:

- Identificação de entidades relevantes;

- Classificação do tipo de intenção;

- Reconhecimento de contextos e nuances;

- Validação e refinamento dos resultados parciais.

Ao tratar cada componente separadamente, o sistema pode focar em aspectos específicos da mensagem, melhorando a precisão e a eficiência do processo.

Vantagens dos Modelos Pequenos com Decomposição

O estudo do Google Research destaca várias vantagens dessa abordagem:

- Eficiência Computacional: Modelos menores demandam menos recursos, permitindo que sejam executados em dispositivos móveis e sistemas embarcados sem perda significativa de desempenho.

- Melhor Generalização: A decomposição ajuda a evitar o overfitting, pois o modelo aprende padrões específicos para cada sub-tarefa, tornando-se mais robusto a variações nos dados.

- Facilidade de Manutenção: Atualizar ou melhorar uma parte do sistema é mais simples, já que as sub-tarefas são independentes e podem ser ajustadas isoladamente.

- Resultados Superiores: A combinação de modelos pequenos com decomposição alcança resultados melhores do que modelos grandes e monolíticos em benchmarks de extração de intenções.

Aplicações Práticas e Impacto no Mercado

Essa abordagem tem potencial para transformar diversas áreas onde a IA é aplicada:

- Assistentes Virtuais: Melhor compreensão das solicitações dos usuários, tornando as respostas mais precisas e contextuais.

- Atendimento ao Cliente: Chatbots mais eficientes que entendem rapidamente a intenção do cliente e oferecem soluções adequadas.

- Dispositivos Móveis: Execução de IA localmente, garantindo privacidade e menor latência.

- Automação de Processos: Sistemas que interpretam comandos complexos para executar tarefas específicas de forma autônoma.

Desafios e Próximos Passos

Apesar dos avanços, ainda existem desafios a serem superados:

- Integração entre sub-tarefas: Garantir que a decomposição não gere perda de contexto entre as etapas.

- Escalabilidade: Adaptar a abordagem para diferentes idiomas e domínios de aplicação.

- Treinamento eficiente: Desenvolver métodos para treinar modelos pequenos com menos dados, mantendo a qualidade.

Os pesquisadores continuam explorando essas questões, com a expectativa de que a decomposição se torne uma prática padrão para o desenvolvimento de IA mais leve e eficaz.

Conclusão

A pesquisa do Google Research demonstra que o tamanho do modelo não é o único fator determinante para o sucesso na extração de intenções. A decomposição inteligente de tarefas, aliada a modelos pequenos, pode entregar resultados superiores, com ganhos significativos em eficiência e aplicabilidade. Essa abordagem abre caminho para uma nova geração de sistemas de IA que são mais acessíveis, rápidos e precisos, ampliando o alcance da tecnologia para diversos setores e dispositivos.

Para quem atua no desenvolvimento de soluções em IA, acompanhar e implementar essas técnicas pode ser decisivo para criar produtos inovadores e competitivos no mercado.