Panorama da Inteligência Artificial Open Source na Hugging Face em 2026: Crescimento, Competição e Novos Horizontes

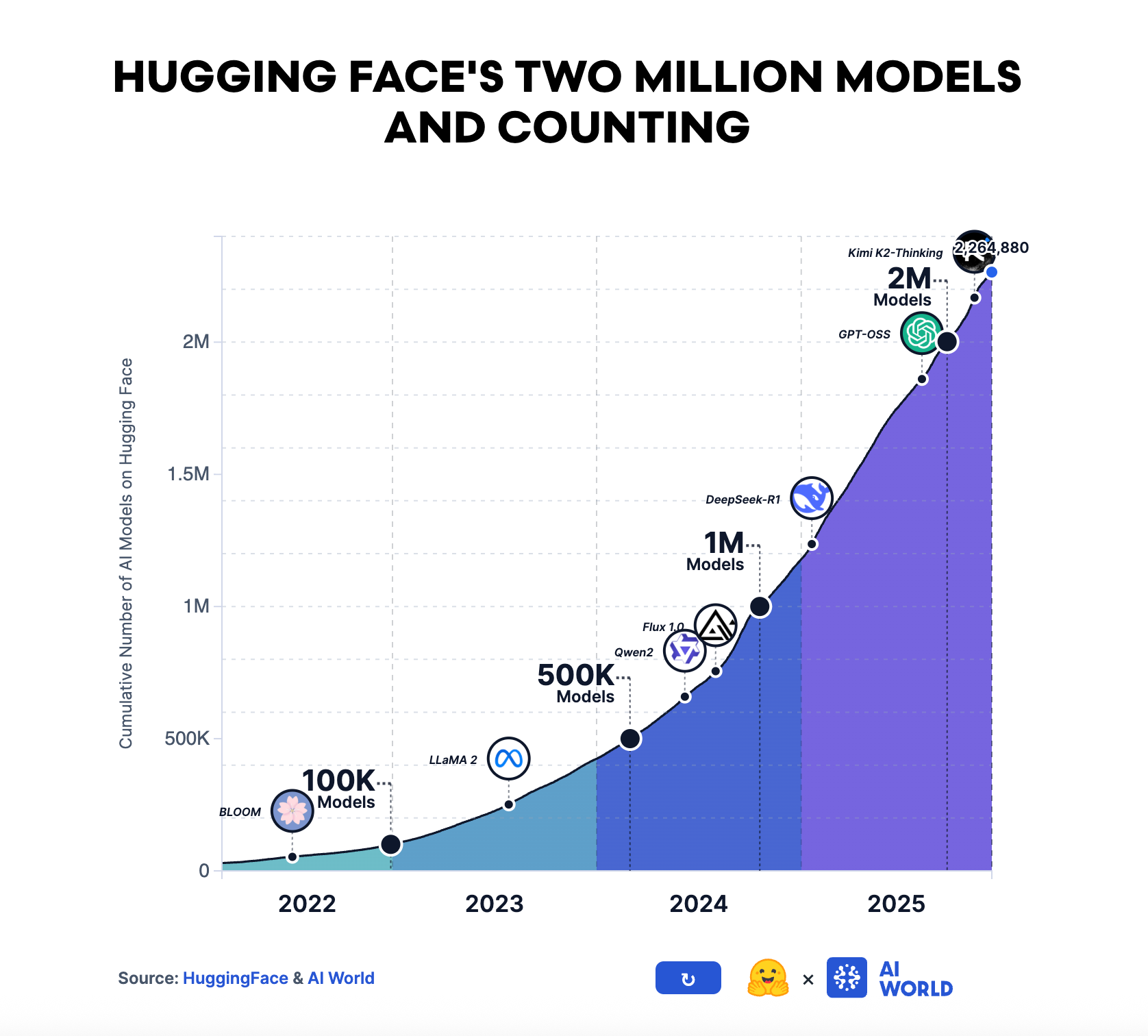

O ecossistema open source de inteligência artificial (IA) continua sua rápida expansão e transformação, conforme revela o relatório State of Open Source on Hugging Face: Spring 2026. A plataforma Hugging Face, referência mundial em compartilhamento de modelos, datasets e ferramentas para IA, atingiu marcos impressionantes em 2025, com 13 milhões de usuários, mais de 2 milhões de modelos públicos e mais de 500 mil conjuntos de dados disponíveis. Este crescimento não apenas demonstra o interesse crescente, mas também a intensificação da participação ativa da comunidade na criação de artefatos derivados, como modelos fine-tuned, benchmarks e aplicações.

Competição e Adoção Corporativa do Open Source

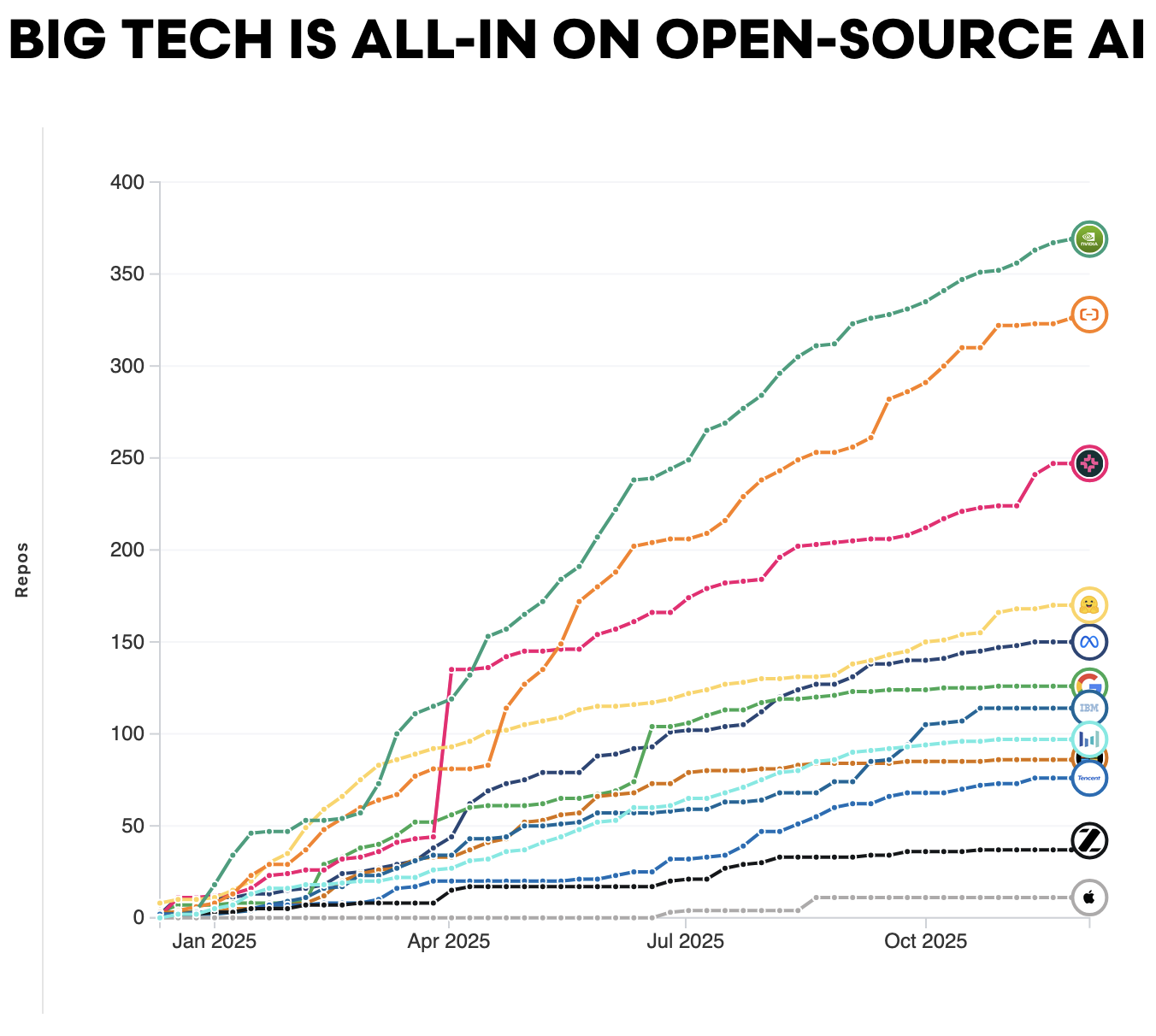

Mais empresas, de startups a gigantes da Fortune 500, estão integrando o open source em suas estratégias. Hoje, mais de 30% das empresas da Fortune 500 mantêm contas verificadas na Hugging Face. Startups como a Thinking Machines desenvolvem modelos inteiramente baseados em pesos abertos, enquanto ambientes de desenvolvimento como VSCode e Cursor suportam modelos abertos e proprietários. Além disso, empresas tradicionais americanas, como Airbnb, ampliaram seu envolvimento no ecossistema open source em 2025.

Entre as grandes empresas de tecnologia, a NVIDIA se destaca como a maior contribuidora em termos de repositórios no Hugging Face, evidenciando o investimento crescente no setor. A pesquisa indica que o valor gerado por artefatos abertos supera os custos de sua produção, já que modelos open source são amplamente reutilizados e adaptados, proporcionando maior flexibilidade e menor custo em comparação com sistemas fechados.

Geografia do Open Source: A Ascensão da China e o Papel dos Desenvolvedores Independentes

A distribuição geográfica do uso e desenvolvimento de IA open source mudou significativamente. Dados recentes apontam que a China ultrapassou os Estados Unidos em downloads mensais e totais na Hugging Face, respondendo por 41% das baixas em 2025. Enquanto isso, a participação da indústria caiu de cerca de 70% antes de 2022 para 37% em 2025, com desenvolvedores independentes e coletivos pequenos aumentando sua fatia para 39%, chegando a superar 50% em alguns períodos.

Essa diversificação geográfica também reflete diferentes formas de contribuição: Estados Unidos e Europa Ocidental dominam por meio de grandes laboratórios industriais (Google, Meta, OpenAI, Stability AI), enquanto a China lidera em lançamentos e adoção. Países como França, Alemanha e Reino Unido mantêm forte presença via instituições de pesquisa e iniciativas nacionais.

Modelos e Pesquisas em Destaque

Os modelos mais populares na Hugging Face evoluíram de predominância americana para um cenário internacional, com o modelo DeepSeek-R1 da China liderando em "likes". Em termos científicos, as publicações mais valorizadas pela comunidade vêm majoritariamente de grandes organizações chinesas e americanas, com destaque para a ByteDance, que compartilha um volume considerável de artigos de alto impacto.

Quanto aos modelos derivados, a Alibaba se destaca com mais de 113 mil modelos derivados da família Qwen, superando Google e Meta juntos. Essa dinâmica de fine-tuning e adaptação mostra como a comunidade está ativa na personalização e especialização dos modelos base.

Acessibilidade e Uso Prático: Modelos Pequenos e Frequência de Atualizações

O desenvolvimento de modelos está cada vez mais focado na acessibilidade e no equilíbrio entre escala e desempenho. Modelos menores, com até 9 bilhões de parâmetros, são baixados e usados com muito mais frequência do que os modelos muito grandes, devido a restrições práticas como custo, latência e disponibilidade de hardware. A média do tamanho dos modelos baixados aumentou, mas a mediana teve crescimento modesto, indicando que o uso de modelos compactos permanece dominante.

Além disso, a vida útil média dos modelos em termos de engajamento é de cerca de seis semanas, o que reforça a importância de atualizações contínuas e melhorias para manter a relevância. Modelos como os da DeepSeek exemplificam esse ciclo com sucessivas versões que mantêm a competitividade.

Hardware, Computação e Sustentabilidade do Open Source

O desenvolvimento de IA open source está fortemente conectado às tendências de hardware. A maioria dos modelos é otimizada para GPUs NVIDIA, mas o suporte a hardware AMD tem crescido, com iniciativas da Stability AI e o lançamento do Kernel Hub pela Hugging Face para facilitar a execução em diferentes plataformas. Na China, empresas como Alibaba investem em chips próprios para rodar modelos localmente, reduzindo dependência de fornecedores estrangeiros.

Apesar dos avanços, o acesso a infraestrutura computacional ainda é um desafio, especialmente para a comunidade open source. Discussões sobre financiamento público para data centers dedicados a modelos abertos ganham força na Europa e Reino Unido, buscando reduzir a assimetria entre recursos disponíveis para grandes empresas e a comunidade.

Comunidades Emergentes: Robótica e IA para Ciência

A robótica desponta como um dos sub-ecossistemas de crescimento mais acelerado na Hugging Face. De 2024 para 2025, o número de datasets de robótica saltou de 1.145 para 26.991, tornando-se a maior categoria de datasets na plataforma. Esses conjuntos abrangem tarefas desde manipulação doméstica até direção autônoma, revelando um interesse crescente em aplicações práticas e multimodais.