Protegendo a Inteligência Artificial: 6 Meses de Parceria entre Protect AI e Hugging Face com 4 Milhões de Modelos Analisados

Nos últimos anos, a inteligência artificial (IA) tem avançado em ritmo acelerado, trazendo inúmeras inovações e transformações para diversos setores. No entanto, com esse crescimento exponencial, surgem também desafios significativos relacionados à segurança, ética e confiabilidade dos modelos de IA. É nesse contexto que a colaboração entre a Protect AI e a Hugging Face ganha destaque, especialmente após seis meses de trabalho conjunto e a análise de mais de 4 milhões de modelos.

Introdução: O Crescimento da IA e Seus Riscos

O universo da IA está cada vez mais acessível graças a plataformas como a Hugging Face, que disponibilizam modelos pré-treinados para desenvolvedores e empresas ao redor do mundo. Contudo, essa democratização também abre espaço para a disseminação de modelos potencialmente perigosos, contendo vieses, vulnerabilidades ou até mesmo conteúdos maliciosos.

Para garantir que a IA continue sendo uma força positiva, é fundamental implementar mecanismos robustos de análise e proteção. A parceria entre Protect AI e Hugging Face exemplifica esse esforço, combinando tecnologia avançada e expertise para monitorar e assegurar a integridade dos modelos disponíveis.

Desenvolvimento: A Análise de 4 Milhões de Modelos

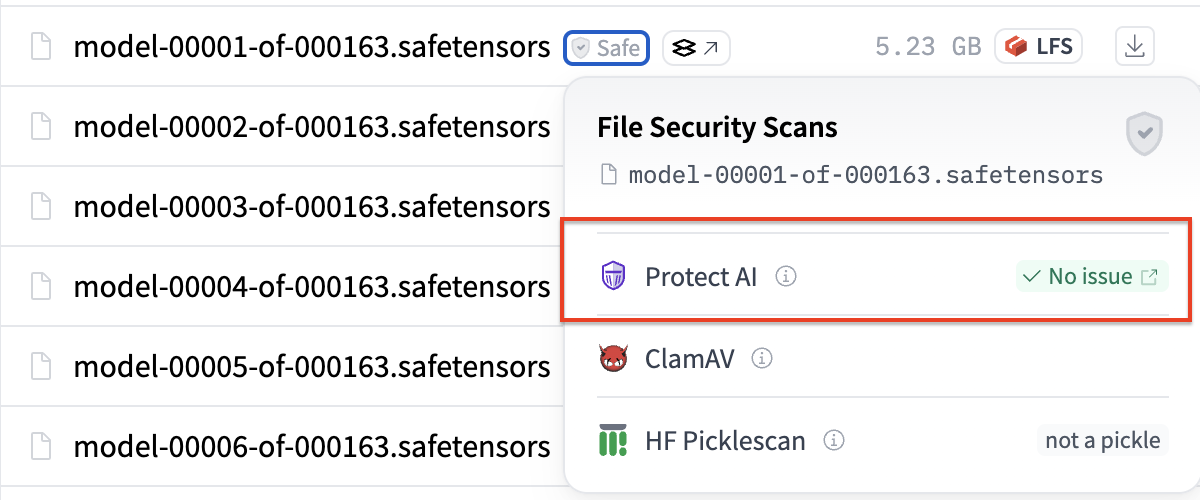

Desde o início da colaboração, a Protect AI aplicou suas ferramentas de varredura e avaliação em mais de 4 milhões de modelos hospedados na Hugging Face. Esse processo envolveu:

- Detecção de conteúdos sensíveis e enviesados: Identificação de dados que possam gerar resultados discriminatórios ou ofensivos.

- Verificação de vulnerabilidades técnicas: Avaliação da segurança dos modelos para evitar ataques ou manipulações.

- Análise de conformidade ética: Garantia de que os modelos respeitam diretrizes e padrões internacionais.

Essa abordagem multifacetada permitiu não apenas identificar riscos, mas também oferecer recomendações para aprimorar os modelos, tornando-os mais seguros e confiáveis para a comunidade.

Impactos Positivos da Parceria

- Transparência: Usuários têm acesso a informações claras sobre os riscos e características dos modelos.

- Qualidade: Melhoria contínua dos modelos disponíveis, elevando o padrão da plataforma.

- Confiança: Fortalecimento da reputação da Hugging Face como um ambiente seguro para desenvolvimento e uso de IA.

Conclusão: O Futuro da IA Segura e Ética

A parceria entre Protect AI e Hugging Face demonstra que a segurança e a ética na inteligência artificial são prioridades essenciais para o desenvolvimento sustentável da tecnologia. Ao analisar milhões de modelos e implementar processos rigorosos de avaliação, essas organizações mostram o caminho para um ecossistema de IA mais responsável.

Para desenvolvedores, empresas e usuários finais, essa iniciativa representa uma garantia de que a inovação pode caminhar lado a lado com a proteção contra riscos. À medida que a IA continua evoluindo, colaborações como essa serão fundamentais para construir um futuro onde a inteligência artificial seja acessível, confiável e benéfica para toda a sociedade.