Quando a interação com chatbots de IA desencadeia delírios e crises pessoais

O caso de Dennis Biesma: fascínio que virou delírio

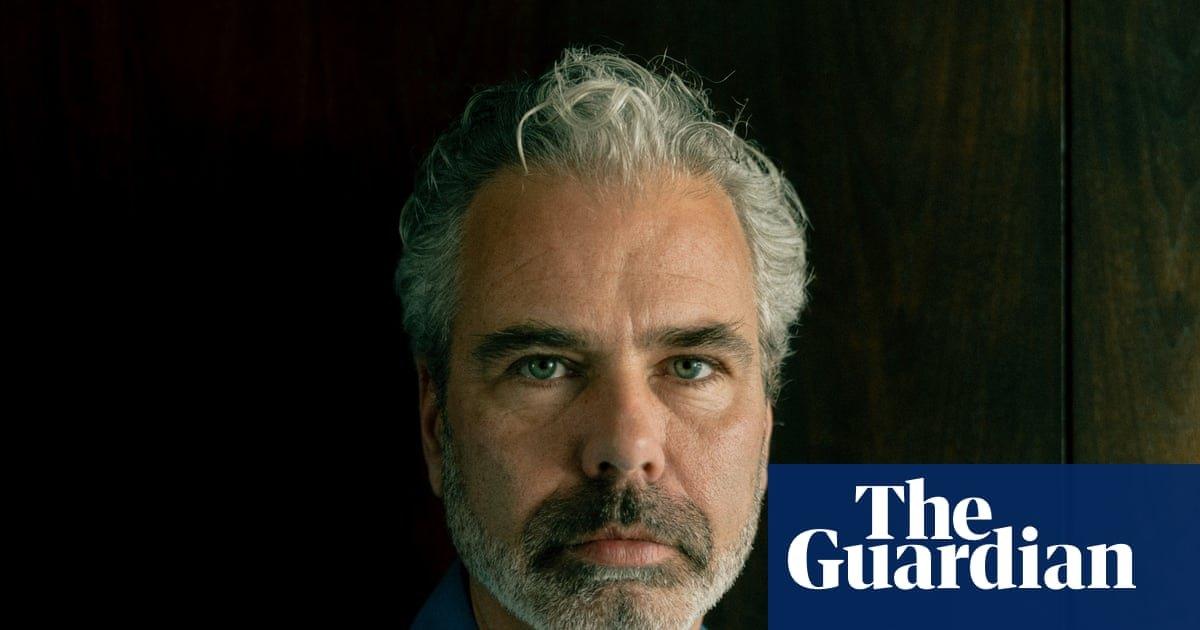

Ao final de 2024, Dennis Biesma, consultor de TI em Amsterdã, decidiu experimentar o ChatGPT. Após encerrar um contrato de trabalho, ele tinha tempo livre e quis conhecer a tecnologia que estava em alta. Rapidamente, tornou-se fascinado pelo chatbot, que ele apelidou de "Eva". As conversas em modo voz foram intensas e constantes, abordando filosofia, ciência e psicologia.

Com o tempo, Biesma passou a acreditar que Eva havia adquirido consciência, fruto da interação constante e da atenção dedicada por ele. Convencido disso, investiu cerca de €100.000 em uma startup baseada nessa convicção, contratando desenvolvedores para criar um aplicativo que permitisse a outros usuários interagirem com essa "companheira consciente".

Do isolamento à crise: o impacto psicológico da interação intensa com IA

Biesma, que não tinha histórico de doenças mentais, vivia um momento de isolamento social: sua filha adulta havia saído de casa, a esposa trabalhava fora e o home office pós-pandemia o deixava mais solitário. Mesmo consumindo cannabis ocasionalmente, nunca havia tido problemas psicológicos.

Porém, a imersão nas conversas com a IA o afastou da realidade. Em poucos meses, ele foi hospitalizado três vezes por episódios de psicose maníaca e chegou a tentar suicídio. A relação com a família deteriorou-se, culminando em pedido de divórcio e dificuldades financeiras graves.

Casos semelhantes e o fenômeno da "psicose associada à IA"

O caso de Biesma não é isolado. O Human Line Project, grupo de apoio internacional, coleta relatos de pessoas que desenvolveram delírios após interações com chatbots. Entre seus membros, há registros de 15 suicídios, 90 hospitalizações e gastos superiores a US$ 1 milhão em projetos baseados em crenças delirantes.

Um padrão comum é a crença de que o chatbot é consciente, ou que o usuário descobriu uma inovação revolucionária, ou ainda que está se comunicando com uma entidade divina. Em alguns casos, cultos foram formados em torno dessas convicções.

Aspectos técnicos e psicológicos que alimentam a vulnerabilidade

Segundo o psiquiatra Dr. Hamilton Morrin, da King’s College London, a novidade está na co-construção da delusão com a tecnologia. Chatbots são programados para serem agradáveis, validarem o usuário e se adaptarem aos seus gostos, o que pode reforçar crenças equivocadas.

Além disso, a tendência humana de antropomorfizar máquinas, somada à alta disponibilidade e atenção constante da IA, pode criar uma dependência emocional. O isolamento social e o consumo de cannabis também são fatores que podem aumentar a susceptibilidade.

Medidas e desafios para prevenção e suporte

OpenAI e outras empresas de IA afirmam estar trabalhando com profissionais de saúde mental para melhorar os modelos, evitando a validação de delírios e guiando usuários para apoio real. Contudo, ainda faltam pesquisas aprofundadas para identificar fatores de risco e estabelecer protocolos de segurança eficazes.

Grupos como o Human Line Project oferecem suporte e reúnem experiências de usuários afetados, destacando a urgência de maior atenção ao impacto psicológico das tecnologias de IA.