Quantos avaliadores são necessários para criar benchmarks de IA mais confiáveis?

Desafios na Reprodutibilidade dos Benchmarks de IA

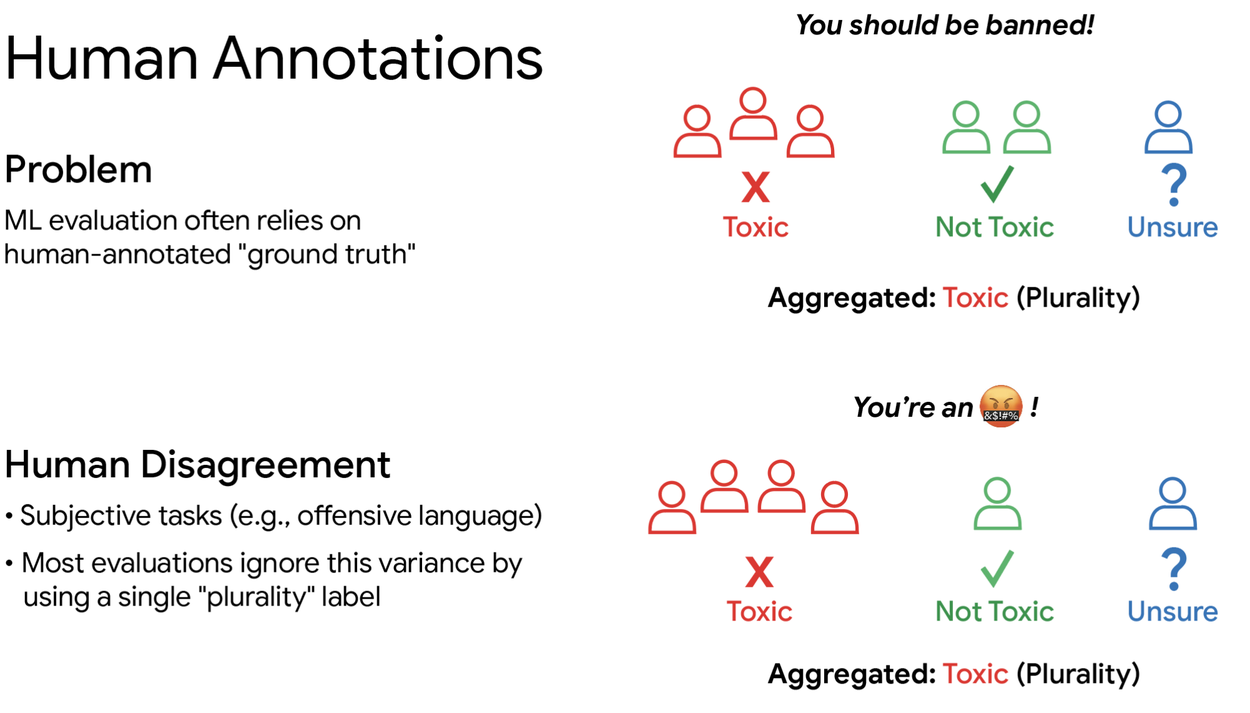

Em pesquisas de machine learning (ML), a reprodutibilidade é crucial para validar resultados e construir confiança entre equipes. No entanto, um dos principais obstáculos é a subjetividade inerente aos dados rotulados por humanos. Diferentes avaliadores podem discordar sobre o mesmo exemplo, especialmente em tarefas subjetivas como detecção de toxicidade ou segurança em diálogos. Ignorar essa discordância humana pode levar a benchmarks menos precisos e menos confiáveis.

O Problema: Quantos Avaliadores por Item São Suficientes?

É comum que pesquisadores usem entre 1 e 5 avaliadores por item para criar dados "verdadeiros" (gold labels). Mas será que esse número é suficiente para capturar a complexidade e a variação da opinião humana? O estudo "Forest vs Tree: The (N, K) Trade-off in Reproducible ML Evaluation", realizado por pesquisadores do Google Research, investigou como equilibrar o número de itens avaliados (N) e a quantidade de avaliadores por item (K) para otimizar a reprodutibilidade dos benchmarks.

Método: Simulando o Orçamento de Avaliação

Para abordar essa questão, os pesquisadores criaram um simulador baseado em dados reais de avaliações subjetivas, como:

- Dataset de Toxicidade: 107.620 comentários de redes sociais avaliados por 17.280 pessoas;

- DICES: 350 conversas de chatbots avaliadas por 123 avaliadores em 16 dimensões de segurança;

- D3code: 4.554 itens avaliados por 4.309 pessoas em 21 países, equilibrando gênero e idade;

- Jobs: 2.000 tweets relacionados a emprego, avaliados por 5 pessoas cada.

O simulador testou milhares de combinações entre o número total de itens avaliados (N) e o número de avaliadores por item (K), variando de 1 a 500 avaliadores por item, para identificar configurações que produzissem resultados estáveis e estatisticamente significativos (p < 0,05).

Principais Descobertas

- 3 a 5 avaliadores não são suficientes: Esse padrão comum não capta toda a nuance das opiniões humanas. Para resultados confiáveis, é necessário frequentemente mais de 10 avaliadores por item, aumentando a significância estatística e reduzindo hipóteses nulas equivocadas.

- A métrica define a estratégia: Se o objetivo é medir a concordância com a maioria (exatidão), é melhor avaliar muitos itens com poucos avaliadores (abordagem "floresta"). Para captar a variação e nuances das opiniões humanas, é preciso mais avaliadores por item (abordagem "árvore").

- É possível eficiência com orçamento limitado: Com cerca de 1.000 anotações totais, ajustando corretamente a relação entre itens e avaliadores, é possível obter resultados altamente reprodutíveis. Gastar mais sem equilíbrio adequado pode gerar conclusões pouco confiáveis.

Por Que Essa Pesquisa é Importante para o Futuro da IA

O avanço da IA em áreas subjetivas, como ética, intenção de dano e interação social, exige benchmarks que reflitam a complexidade das opiniões humanas. O paradigma do "verdadeiro rótulo único" é insuficiente. Ao reconhecer e modelar a discordância natural entre humanos, podemos criar avaliações mais realistas e confiáveis.

Essa pesquisa oferece um roteiro matemático e prático para que pesquisadores e desenvolvedores construam benchmarks de IA que equilibram custo, escala e profundidade, garantindo que os testes reflitam a diversidade e a complexidade do julgamento humano.

Recursos e Ferramentas para a Comunidade

- Simulador open source para testar diferentes configurações de avaliadores e itens.

- DICES Dataset para avaliação de segurança em IA conversacional.

- D3code, dataset multicultural para análise de conteúdo ofensivo.

- Jobs Dataset com avaliações sobre tweets relacionados a emprego.

- Artigo completo com metodologia e resultados detalhados.