Skill da HuggingFace automatiza portabilidade de modelos Transformers para MLX com qualidade humana

A revolução dos agentes de código e seus desafios no open source

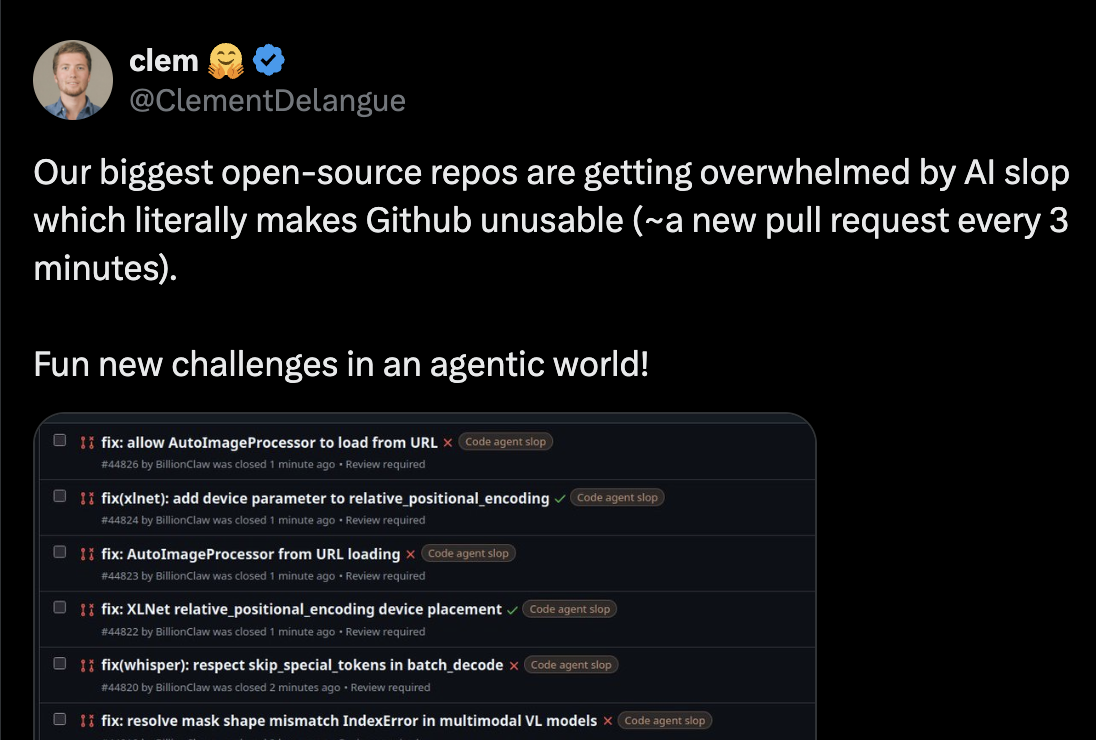

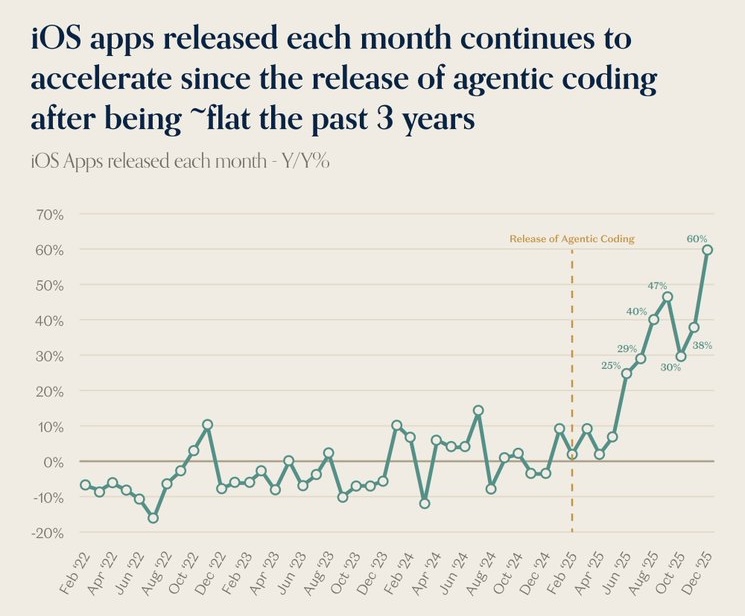

Em 2026, agentes de código avançados passaram a entregar soluções completas a partir de especificações breves, ampliando exponencialmente a capacidade de desenvolvimento de software. Essa nova realidade, conforme destacado pela HuggingFace, multiplicou o número de programadores ativos no mundo, mas trouxe um desafio crítico para projetos open source robustos como a biblioteca transformers.

Com milhares de colaboradores e mais de um bilhão de downloads, transformers é uma base de código construída para comunicação clara entre humanos, com hierarquias planas e arquivos legíveis de cima a baixo. Agentes automatizados, no entanto, tendem a sugerir alterações baseadas em melhores práticas genéricas, sem compreender os contratos implícitos do projeto, resultando em refatorações excessivas, bugs sutis e perda de desempenho.

Por que MLX se beneficia dessa inovação?

A biblioteca mlx-lm, que frequentemente porta modelos da transformers, enfrenta pressão semelhante devido ao aumento de contribuições automatizadas. Seus mantenedores valorizam profundamente a qualidade do código e revisam cada Pull Request (PR) com rigor. A HuggingFace identificou que agentes poderiam ajudar a acelerar a portabilidade de modelos, desde que guiados para respeitar as nuances do projeto e auxiliar revisores no processo.

O que é a Skill transformers-to-mlx?

Trata-se de uma ferramenta criada para facilitar a conversão de modelos da biblioteca transformers para mlx-lm. A Skill automatiza a criação de PRs quase instantaneamente após um modelo ser adicionado ao transformers, respeitando as convenções do MLX e gerando artefatos que aumentam a transparência e a confiabilidade da conversão.

Funcionalidades para contribuidores

- Configuração automática do ambiente virtual.

- Download e identificação dos modelos relevantes no HuggingFace Hub.

- Leitura do código-fonte em transformers e geração da implementação correspondente em mlx-lm.

- Execução de testes detalhados, incluindo comparações por camada e verificação de tipos de dados.

- Iteração automática para corrigir divergências até alcançar resultados satisfatórios.

Suporte para revisores

A Skill produz PRs que aparentam ter sido escritos por humanos experientes, com código idiomático, sem comentários desnecessários ou abstrações especulativas. Cada PR inclui um relatório detalhado com:

- Sumário das variantes e diferenças arquiteturais.

- Exemplos de geração e comparações numéricas.

- Verificação de tipos de dados e comparações por camada contra a base transformers.

- Transparência total ao informar que a PR foi assistida por agente.

Test harness: garantia de qualidade e reprodutibilidade

Além dos testes automatizados pela Skill, foi desenvolvido um test harness independente, não baseado em agentes, que executa avaliações sistemáticas para:

- Eliminar incertezas sobre possíveis alucinações do modelo de linguagem.

- Garantir que qualquer pessoa possa reproduzir os testes baixando o repositório.

- Documentar resultados em múltiplos níveis, incluindo relatórios sumarizados, detalhes por modelo e arquivos JSON com entradas e saídas brutas.

Embora o test harness não seja um filtro automático para aprovação de PRs, ele oferece suporte crucial para julgamentos qualitativos feitos por humanos.

Como usar a Skill transformers-to-mlx

A Skill destina-se a colaboradores que já participam ou desejam participar do processo de abertura de PRs para mlx-lm. Seu uso requer envolvimento ativo no ciclo de revisão, pois a ferramenta não substitui a interação humana necessária para aprimorar o código. O fluxo típico é:

- O colaborador utiliza a Skill para gerar a PR inicial.

- Revisores apontam melhorias e discutem detalhes.

- Iterações são feitas até o código atingir o padrão esperado.

Para instalar e usar a Skill com o agente Claude Code, execute:

uv run https://raw.githubusercontent.com/huggingface/transformers-to-mlx/main/install_skill.py

uvx hf skills add --claude

O uso com outros agentes como Codex é possível, mas não testado oficialmente.

Próximos passos e limitações atuais

Embora a Skill funcione bem para modelos de linguagem em mlx-lm, há desafios a superar:

- mlx-vlm: modelos de visão e linguagem vivem em repositório separado e exigem pré-processadores específicos para imagens.

- llama.cpp: adaptação para C++ e diferenças numéricas demandam abordagens específicas.

- Utilitários compartilhados: Skill favorece arquivos autônomos e ainda precisa lidar melhor com código reutilizável.

- Uploads de modelos quantizados: Skill testa quantização, mas ainda não faz upload automático ao Hub durante revisão.

- Testes específicos para "thinking": ainda não foram desenvolvidos.

O maior gargalo no desenvolvimento open source não é a velocidade de digitação, mas o entendimento profundo da base de código para realizar mudanças seguras. A Skill transformers-to-mlx mostra que agentes, quando bem orientados, podem acelerar conversões complexas sem comprometer a qualidade, beneficiando colaboradores e mantenedores.