Tokenização em Transformers v5: Mais Simples, Clara e Modular para o Futuro da IA

Introdução

A tokenização é uma etapa fundamental no processamento de linguagem natural (PLN) e, consequentemente, para o funcionamento dos modelos Transformers. Com o lançamento da versão 5 da biblioteca Transformers da HuggingFace, essa etapa foi repensada para se tornar mais simples, clara e modular, facilitando a vida dos desenvolvedores e pesquisadores que trabalham com Inteligência Artificial.

O que é Tokenização e por que ela importa?

Tokenização é o processo de dividir um texto em unidades menores chamadas tokens, que podem ser palavras, subpalavras ou até caracteres. Esses tokens são a base para que os modelos de linguagem entendam e processem o texto.

Uma tokenização eficiente impacta diretamente na qualidade do modelo, na velocidade de processamento e na capacidade de generalização. Por isso, a HuggingFace investiu em melhorias significativas para a versão 5 da sua biblioteca Transformers.

Principais mudanças na Tokenização do Transformers v5

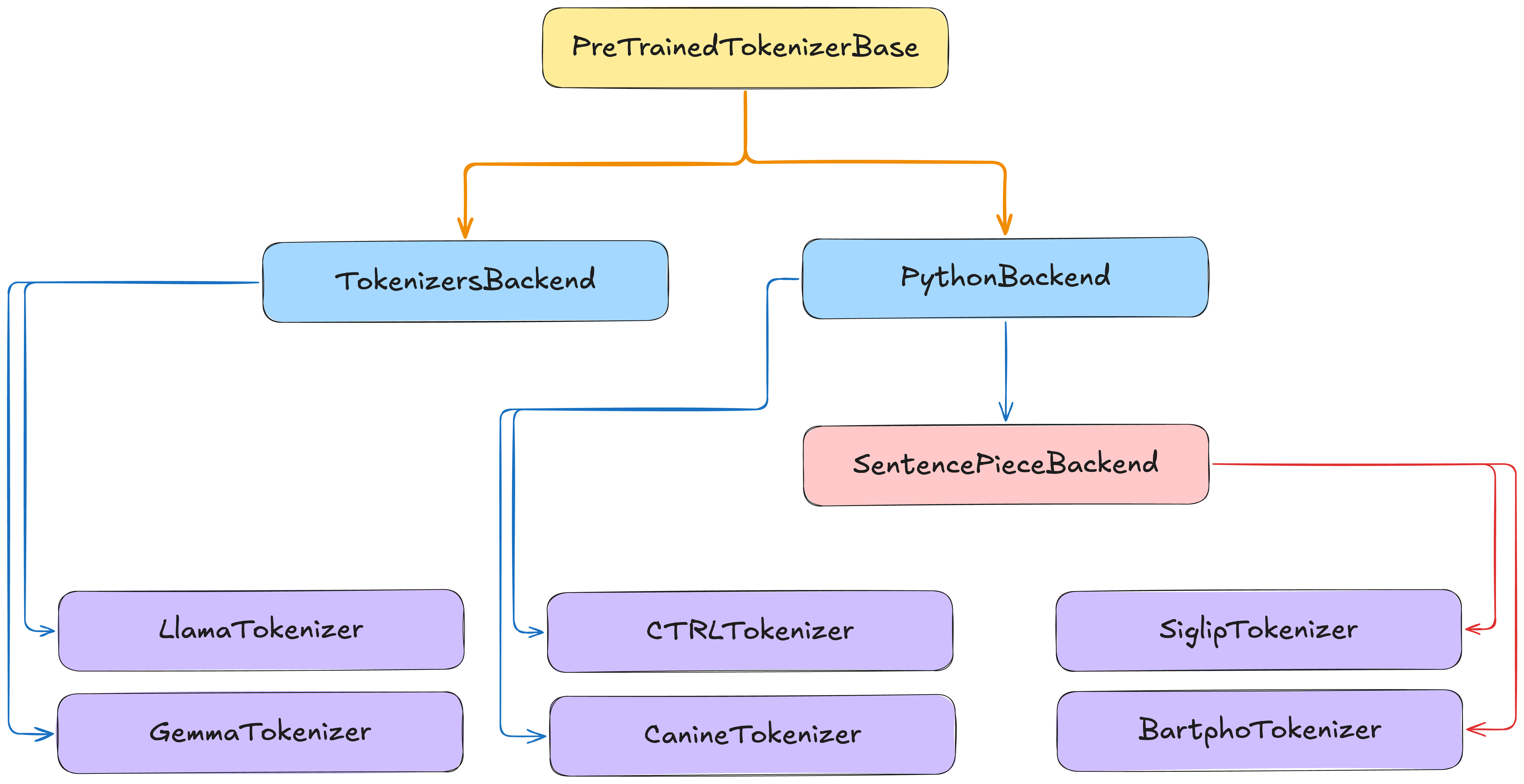

A atualização da tokenização no Transformers v5 traz três pilares principais:

- Simplicidade: A API foi redesenhada para ser mais intuitiva, reduzindo a curva de aprendizado e facilitando a integração com diferentes fluxos de trabalho.

- Clareza: O código e a documentação foram aprimorados para tornar o funcionamento interno da tokenização mais transparente, permitindo que os usuários entendam melhor o que acontece por trás dos bastidores.

- Modularidade: Agora, os componentes da tokenização são mais desacoplados e reutilizáveis, permitindo customizações mais fáceis e adaptáveis a diferentes necessidades.

Simplicidade na prática

Antes, lidar com tokenizadores exigia conhecimento mais aprofundado da estrutura interna da biblioteca. Com o novo design, os métodos são mais diretos e as funções de tokenização podem ser chamadas com menos parâmetros, mantendo a flexibilidade.

Clareza para desenvolvedores

O código aberto da HuggingFace foi reorganizado para que cada etapa da tokenização seja compreensível. Isso é especialmente útil para quem deseja modificar ou estender o tokenizador para casos específicos, como idiomas menos comuns ou domínios técnicos.

Modularidade para customização

Com a modularização, é possível combinar diferentes estratégias de tokenização, como divisão por espaços, subpalavras (BPE, WordPiece) e até técnicas híbridas. Isso abre portas para experimentos e para a criação de tokenizadores especializados sem reescrever tudo do zero.

Benefícios para a comunidade de IA

Essas melhorias impactam positivamente toda a comunidade que utiliza Transformers, desde pesquisadores acadêmicos até engenheiros de produção:

- Facilidade de uso: Novatos podem começar a trabalhar com tokenização sem se perder em detalhes técnicos.

- Maior transparência: Entender o processo ajuda a diagnosticar problemas e otimizar modelos.

- Flexibilidade: Permite adaptar tokenizadores para diferentes idiomas, domínios e tarefas específicas.

- Colaboração: Código mais organizado facilita contribuições da comunidade open source.

Como começar a usar a tokenização no Transformers v5?

Para quem já está familiarizado com a biblioteca, a atualização é simples. Basta atualizar para a versão 5 e explorar a nova API de tokenização. A HuggingFace oferece documentação detalhada e exemplos práticos para auxiliar na transição.

Além disso, a modularidade permite que você crie tokenizadores personalizados combinando componentes existentes, o que é ideal para projetos avançados.

Conclusão

A tokenização é uma peça-chave no desenvolvimento de modelos baseados em Transformers. Com a versão 5 da biblioteca Transformers da HuggingFace, essa etapa ficou mais acessível, transparente e adaptável. Essas melhorias não só facilitam o trabalho dos desenvolvedores, como também abrem caminho para inovações e aplicações mais robustas em Inteligência Artificial.

Se você trabalha com PLN ou deseja se aprofundar no universo dos Transformers, vale a pena explorar as novidades da tokenização no Transformers v5 e aproveitar todo o potencial que essa evolução oferece.