Transformers: Como a Biblioteca da HuggingFace Revolucionou a Padronização de Modelos de IA

Nos últimos anos, a inteligência artificial (IA) avançou de forma impressionante, especialmente no campo do processamento de linguagem natural (PLN). Um dos grandes responsáveis por essa evolução é a arquitetura Transformer, que se tornou a base para modelos poderosos como BERT, GPT e muitos outros. No centro dessa revolução está a biblioteca Transformers, desenvolvida pela HuggingFace, que padronizou a forma como esses modelos são definidos e utilizados, facilitando o acesso e a aplicação da IA em diversos setores.

O que é a Biblioteca Transformers?

A biblioteca Transformers da HuggingFace é um conjunto de ferramentas open source que permite o uso, treinamento e implementação de modelos baseados em Transformers de maneira simples e eficiente. Ela oferece uma interface unificada para centenas de modelos pré-treinados, cobrindo tarefas como tradução, geração de texto, análise de sentimentos, reconhecimento de entidades nomeadas, entre outras.

Padronização e Flexibilidade

Antes da popularização da biblioteca, desenvolvedores e pesquisadores enfrentavam desafios significativos para integrar diferentes modelos de IA em seus projetos. Cada modelo possuía sua própria estrutura, formatos de entrada e saída, e requisitos específicos, o que dificultava a interoperabilidade e a experimentação.

A biblioteca Transformers resolveu esse problema ao criar uma padronização robusta para a definição de modelos. Isso significa que, independentemente do modelo escolhido, o usuário interage com uma API consistente, simplificando o processo de desenvolvimento e reduzindo a curva de aprendizado.

Principais Características da Biblioteca

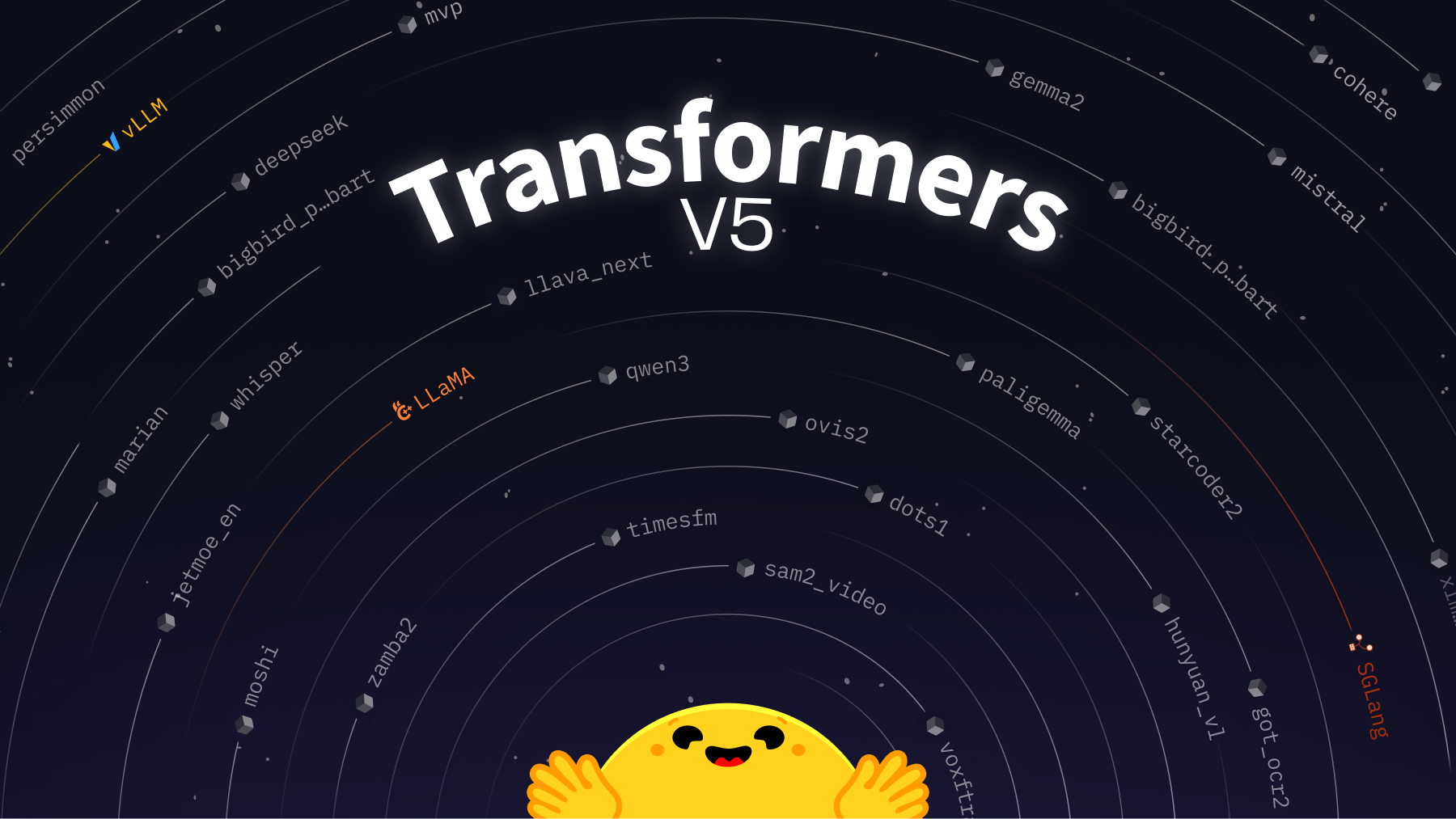

- Suporte a múltiplas arquiteturas: Inclui modelos baseados em BERT, GPT, RoBERTa, T5, DistilBERT, entre outros.

- Modelos pré-treinados: Disponibiliza centenas de modelos já treinados em grandes corpora, prontos para uso imediato.

- Integração com frameworks populares: Compatível com PyTorch, TensorFlow e JAX, permitindo flexibilidade na escolha da plataforma.

- Pipeline simplificada: Funções prontas para executar tarefas comuns com poucas linhas de código.

- Comunidade ativa: Contínuo desenvolvimento e atualização, com suporte de uma comunidade global.

Impacto na Pesquisa e na Indústria

Ao padronizar a definição e o uso de modelos Transformer, a biblioteca da HuggingFace democratizou o acesso a tecnologias avançadas de IA. Pesquisadores podem experimentar novas arquiteturas e técnicas com facilidade, enquanto empresas conseguem integrar soluções inteligentes em seus produtos com rapidez e eficiência.

Além disso, a biblioteca promove a reutilização de modelos e a colaboração entre equipes, acelerando o desenvolvimento de aplicações inovadoras em áreas como atendimento ao cliente, análise de dados, saúde, educação e muito mais.

Como Começar a Usar a Biblioteca Transformers?

Para quem deseja explorar o poder dos Transformers, a biblioteca oferece uma documentação completa e exemplos práticos. A instalação é simples, via pip:

pip install transformersDepois, é possível carregar um modelo pré-treinado e realizar tarefas como geração de texto com apenas algumas linhas de código:

from transformers import pipeline

gerador = pipeline('text-generation', model='gpt2')

resultado = gerador('A inteligência artificial é', max_length=50)

print(resultado)Conclusão

A biblioteca Transformers da HuggingFace representa um marco na evolução da inteligência artificial, ao padronizar a definição e o uso de modelos baseados em Transformers. Essa padronização não só facilita o trabalho de desenvolvedores e pesquisadores, mas também impulsiona a inovação e a adoção da IA em diversos setores.

Com uma comunidade vibrante e constante evolução, a biblioteca continua a expandir suas capacidades, tornando-se uma ferramenta indispensável para quem deseja explorar o futuro da inteligência artificial.