Uber amplia uso de chips de IA da Amazon e desafia Google e Oracle no mercado de nuvem

Na última terça-feira, a Amazon anunciou a expansão do contrato de serviços em nuvem da Uber com a AWS, que agora utilizará mais intensamente os chips de inteligência artificial desenvolvidos pela própria Amazon para rodar funcionalidades do seu serviço de transporte por aplicativo.

Novidades no uso dos chips AWS pela Uber

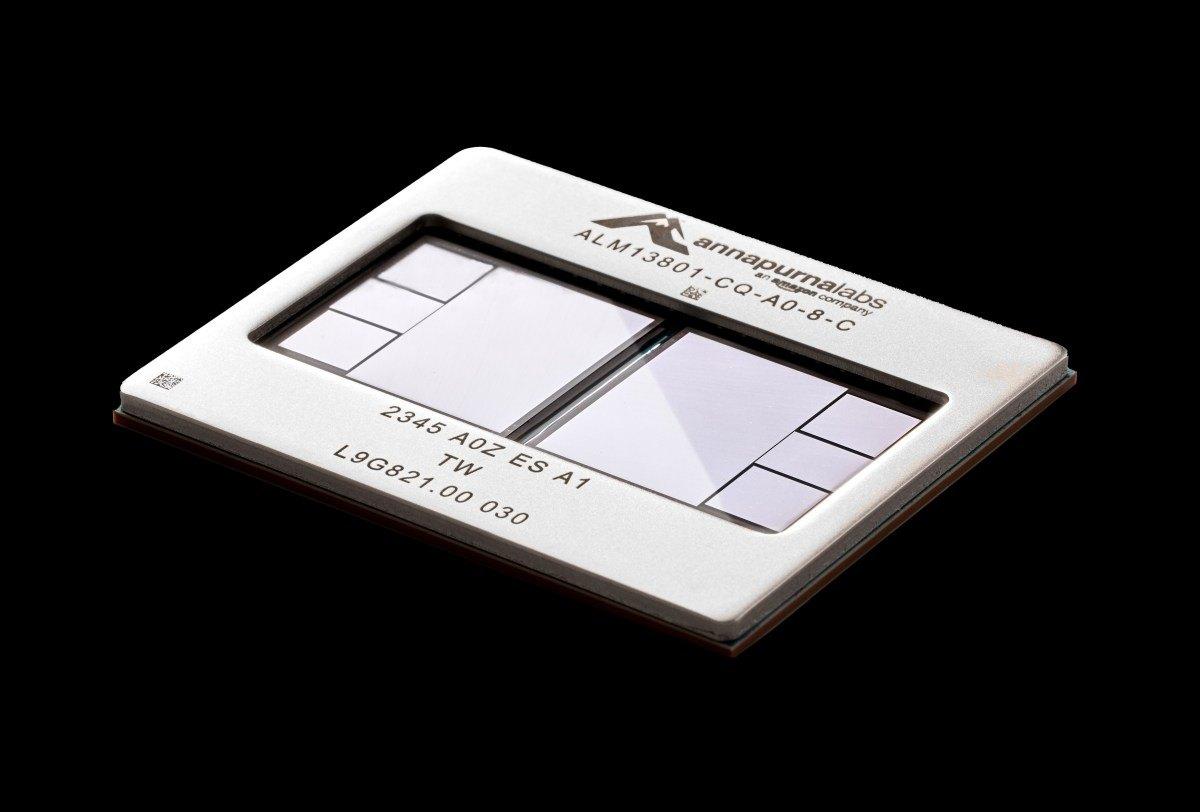

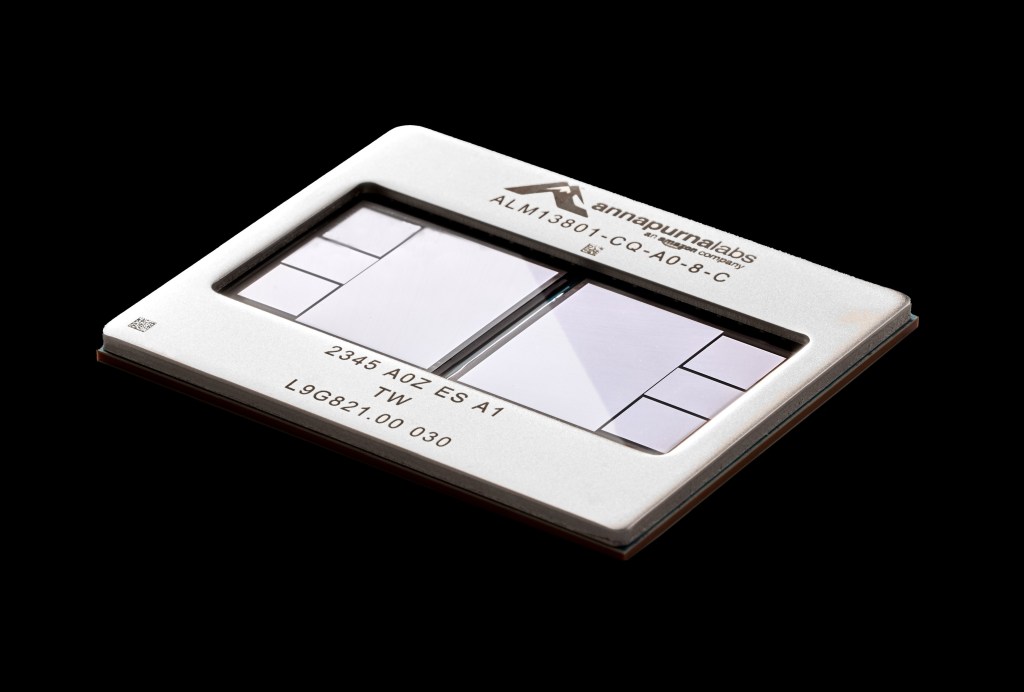

Além de ampliar o uso dos processadores Graviton, baseados em arquitetura ARM e conhecidos por seu baixo consumo energético, a Uber iniciou um novo teste com o Trainium3, chip de IA da AWS desenvolvido para competir diretamente com soluções da Nvidia. Essa movimentação representa não apenas uma estratégia técnica, mas um posicionamento de mercado contra os principais concorrentes da AWS, como Google Cloud e Oracle.

Contexto da parceria e o impacto para o mercado

Historicamente, a Uber mantinha seus próprios data centers, mas em 2023 firmou contratos plurianuais expressivos com Oracle e Google para migrar a maior parte de sua infraestrutura para a nuvem. A decisão de ampliar o uso da AWS e seus chips representa uma reviravolta nessa estratégia, indicando uma preferência crescente pelos recursos da Amazon, especialmente em termos de desempenho e eficiência energética proporcionados pelos chips proprietários.

Em um post de dezembro de 2025, a Uber destacou sua transição para a nuvem utilizando instâncias ARM no Oracle Cloud Infrastructure (OCI) e Google Cloud Platform, ressaltando a importância do uso desses processadores para otimizar cargas de trabalho antes dominadas por arquiteturas x86.

Por que a escolha pelos chips da Amazon é estratégica?

A história por trás da Ampere, fabricante dos chips ARM utilizados pela Oracle, é marcada por conexões complexas no Vale do Silício, envolvendo investimentos e decisões estratégicas de executivos que influenciaram o mercado de tecnologia. A venda da Ampere para a Softbank e a saída da Oracle como acionista refletem uma mudança no cenário competitivo dos chips para data centers.

Enquanto Oracle investe em parcerias com Nvidia para seu data center, a AWS aposta pesado em seus chips Trainium, que já são um negócio bilionário, segundo o CEO Andy Jassy. Ao conquistar um cliente importante como a Uber, a Amazon reforça sua posição frente aos concorrentes, mostrando que o desenvolvimento interno de chips pode ser um diferencial competitivo decisivo.

Quem já utiliza os chips Trainium da AWS?

Além da Uber, empresas de grande porte como Anthropic, OpenAI e Apple também aumentaram sua utilização dos chips de IA da AWS, evidenciando a confiança do mercado nas soluções da Amazon para inteligência artificial e computação em nuvem.

Disponibilidade e acesso

Os chips Trainium3 e Graviton estão disponíveis para clientes da AWS, que podem contratar os serviços de computação em nuvem com esses processadores para otimizar cargas de trabalho de IA e outras aplicações. A Amazon não divulgou detalhes específicos sobre preços diferenciados para essas instâncias, mas o uso crescente indica que elas estão acessíveis para grandes empresas que buscam desempenho e eficiência.

Impacto prático para o leitor

Para empresas e desenvolvedores que utilizam ou pretendem migrar para a nuvem, a expansão do uso dos chips AWS pela Uber sinaliza uma tendência de adoção de processadores ARM otimizados para IA, que podem oferecer melhor custo-benefício e performance. Isso pode estimular mais opções no mercado e maior competitividade entre os provedores de nuvem.